Множественная регрессия и корреляция

Тестовые задания

Парная регрессия и корреляция

1. Наиболее наглядным видом выбора уравнения парной регрессии является:

2. Рассчитывать параметры парной линейной регрессии можно, если у нас есть:

б) не менее 7 наблюдений;

3. Суть метода наименьших квадратов состоит в:

б) минимизации дисперсии результативного признака;

4. Коэффициент линейного парного уравнения регрессии:

а) показывает среднее изменение результата с изменением фактора на одну единицу;

5. На основании наблюдений за 50 семьями построено уравнение регрессии

6. Суть коэффициента детерминации

б) характеризует долю дисперсии результативного признака

7. Качество модели из относительных отклонений по каждому наблюдению оценивает:

а) коэффициент детерминации

8. Значимость уравнения регрессии в целом оценивает:

а)

9. Классический метод к оцениванию параметров регрессии основан на:

в) шаговом регрессионном анализе.

10. Остаточная сумма квадратов равна нулю:

11. Объясненная (факторная) сумма квадратов отклонений в линейной парной модели имеет число степеней свободы, равное:

б)

12. Остаточная сумма квадратов отклонений в линейной парной модели имеет число степеней свободы, равное:

в)

13. Общая сумма квадратов отклонений в линейной парной модели имеет число степеней свободы, равное:

а)

14. Для оценки значимости коэффициентов регрессии рассчитывают:

в) коэффициент детерминации

15. Какое уравнение регрессии нельзя свести к линейному виду:

в)

16. Какое из уравнений является степенным:

б)

17. Параметр

б) коэффициентом эластичности;

18. Коэффициент корреляции

19. Для функции

б)

20. Какое из следующих уравнений нелинейно по оцениваемым параметрам:

в)

Множественная регрессия и корреляция

1. Добавление в уравнение множественной регрессии новой объясняющей переменной:

б) увеличивает значение коэффициента детерминации;

2. Скорректированный коэффициент детерминации:

в) меньше или равен обычному коэффициенту детерминации;

3. С увеличением числа объясняющих переменных скорректированный коэффициент детерминации:

4. Число степеней свободы для остаточной суммы квадратов в линейной модели множественной регрессии равно:

б)

5. Число степеней свободы для общей суммы квадратов в линейной модели множественной регрессии равно:

а)

6. Число степеней свободы для факторной суммы квадратов в линейной модели множественной регрессии равно:

в)

7. Множественный коэффициент корреляции

8. Для построения модели линейной множественной регрессии вида

9. Стандартизованные коэффициенты регрессии

а) позволяют ранжировать факторы по силе их влияния на результат;

10. Частные коэффициенты корреляции:

в) характеризуют тесноту связи между результатом и соответствующим фактором при элиминировании других факторов, включенных в уравнение регрессии.

11. Частный

б) служит мерой для оценки включения фактора в модель;

12. Несмещенность оценки параметра регрессии, полученной по МНК, означает:

б) что математическое ожидание остатков равно нулю;

13. Эффективность оценки параметра регрессии, полученной по МНК, означает:

а) что она характеризуется наименьшей дисперсией;

14. Состоятельность оценки параметра регрессии, полученной по МНК, означает:

в) увеличение ее точности с увеличением объема выборки.

15. Укажите истинное утверждение:

в) при наличии гетероскедастичности оценки параметров регрессии становятся смещенными.

16. При наличии гетероскедастичности следует применять:

17. Фиктивные переменные – это:

а) атрибутивные признаки (например, как профессия, пол, образование), которым придали цифровые метки;

18. Если качественный фактор имеет три градации, то необходимое число фиктивных переменных:

R — значит регрессия

Статистика в последнее время получила мощную PR поддержку со стороны более новых и шумных дисциплин — Машинного Обучения и Больших Данных. Тем, кто стремится оседлать эту волну необходимо подружится с уравнениями регрессии. Желательно при этом не только усвоить 2-3 приемчика и сдать экзамен, а уметь решать проблемы из повседневной жизни: найти зависимость между переменными, а в идеале — уметь отличить сигнал от шума.

Для этой цели мы будем использовать язык программирования и среду разработки R, который как нельзя лучше приспособлен к таким задачам. Заодно, проверим от чего зависят рейтинг Хабрапоста на статистике собственных статей.

Введение в регрессионный анализ

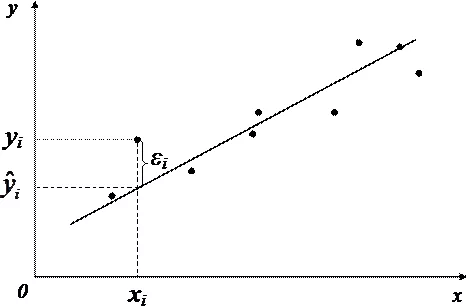

Если имеется корреляционная зависимость между переменными y и x , возникает необходимость определить функциональную связь между двумя величинами. Зависимость среднего значения

называется регрессией y по x .

Основу регрессионного анализа составляет метод наименьших квадратов (МНК), в соответствии с которым в качестве уравнения регресии берется функция такая, что сумма квадратов разностей

минимальна.

Карл Гаусс открыл, или точнее воссоздал, МНК в возрасте 18 лет, однако впервые результаты были опубликованы Лежандром в 1805 г. По непроверенным данным метод был известен еще в древнем Китае, откуда он перекочевал в Японию и только затем попал в Европу. Европейцы не стали делать из этого секрета и успешно запустили в производство, обнаружив с его помощью траекторию карликовой планеты Церес в 1801 г.

Вид функции , как правило, определен заранее, а с помощью МНК подбираются оптимальные значения неизвестных параметров. Метрикой рассеяния значений

вокруг регрессии

является дисперсия.

- k — число коэффициентов в системе уравнений регрессии.

Чаще всего используется модель линейной регрессии, а все нелинейные зависимости приводят к линейному виду с помощью алгебраических ухищрений, различных преобразования переменных y и x .

Линейная регрессия

Уравнения линейной регрессии можно записать в виде

В матричном виде это выгладит

- y — зависимая переменная;

- x — независимая переменная;

- β — коэффициенты, которые необходимо найти с помощью МНК;

- ε — погрешность, необъяснимая ошибка и отклонение от линейной зависимости;

Случайная величина может быть интерпретирована как сумма из двух слагаемых:

— полная дисперсия (TSS).

— объясненная часть дисперсии (ESS).

— остаточная часть дисперсии (RSS).

Еще одно ключевое понятие — коэффициент корреляции R 2 .

Ограничения линейной регрессии

Для того, чтобы использовать модель линейной регрессии необходимы некоторые допущения относительно распределения и свойств переменных.

- Линейность, собственно. Увеличение, или уменьшение вектора независимых переменных в k раз, приводит к изменению зависимой переменной также в k раз.

- Матрица коэффициентов обладает полным рангом, то есть векторы независимых переменных линейно независимы.

- Экзогенность независимых переменных —

. Это требование означает, что математическое ожидание погрешности никоим образом нельзя объяснить с помощью независимых переменных.

- Однородность дисперсии и отсутствие автокорреляции. Каждая εi обладает одинаковой и конечной дисперсией σ 2 и не коррелирует с другой εi. Это ощутимо ограничивает применимость модели линейной регрессии, необходимо удостовериться в том, что условия соблюдены, иначе обнаруженная взаимосвязь переменных будет неверно интерпретирована.

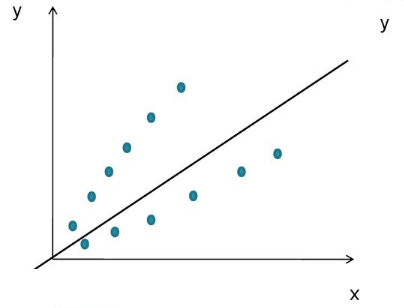

Как обнаружить, что перечисленные выше условия не соблюдены? Ну, во первых довольно часто это видно невооруженным глазом на графике.

Неоднородность дисперсии

При возрастании дисперсии с ростом независимой переменной имеем график в форме воронки.

Нелинейную регрессии в некоторых случая также модно увидеть на графике довольно наглядно.

Тем не менее есть и вполне строгие формальные способы определить соблюдены ли условия линейной регрессии, или нарушены.

- Автокорреляция проверяется статистикой Дарбина-Уотсона (0 ≤ d ≤ 4). Если автокорреляции нет, то значения критерия d≈2, при позитивной автокорреляции d≈0, при отрицательной — d≈4.

- Неоднородность дисперсии — Тест Уайта,

, при

\chi<^2>_<\alpha;m-1>$» data-tex=»inline»/> нулевая гипотеза отвергается и констатируется наличие неоднородной дисперсии. Используя ту же

можно еще применить тест Бройша-Пагана.

- Мультиколлинеарность — нарушения условия об отсутствии взаимной линейной зависимости между независимыми переменными. Для проверки часто используют VIF-ы (Variance Inflation Factor).

В этой формуле — коэффициент взаимной детерминации между

и остальными факторами. Если хотя бы один из VIF-ов > 10, вполне резонно предположить наличие мультиколлинеарности.

Почему нам так важно соблюдение всех выше перечисленных условий? Все дело в Теореме Гаусса-Маркова, согласно которой оценка МНК является точной и эффективной лишь при соблюдении этих ограничений.

Как преодолеть эти ограничения

Нарушения одной или нескольких ограничений еще не приговор.

- Нелинейность регрессии может быть преодолена преобразованием переменных, например через функцию натурального логарифма ln .

- Таким же способом возможно решить проблему неоднородной дисперсии, с помощью ln , или sqrt преобразований зависимой переменной, либо же используя взвешенный МНК.

- Для устранения проблемы мультиколлинеарности применяется метод исключения переменных. Суть его в том, что высоко коррелированные объясняющие переменные устраняются из регрессии, и она заново оценивается. Критерием отбора переменных, подлежащих исключению, является коэффициент корреляции. Есть еще один способ решения данной проблемы, который заключается в замене переменных, которым присуща мультиколлинеарность, их линейной комбинацией. Этим весь список не исчерпывается, есть еще пошаговая регрессия и другие методы.

К сожалению, не все нарушения условий и дефекты линейной регрессии можно устранить с помощью натурального логарифма. Если имеет место автокорреляция возмущений к примеру, то лучше отступить на шаг назад и построить новую и лучшую модель.

Линейная регрессия плюсов на Хабре

Итак, довольно теоретического багажа и можно строить саму модель.

Мне давно было любопытно от чего зависит та самая зелененькая цифра, что указывает на рейтинг поста на Хабре. Собрав всю доступную статистику собственных постов, я решил прогнать ее через модель линейно регрессии.

Загружает данные из tsv файла.

- points — Рейтинг статьи

- reads — Число просмотров.

- comm — Число комментариев.

- faves — Добавлено в закладки.

- fb — Поделились в социальных сетях (fb + vk).

- bytes — Длина в байтах.

Вопреки моим ожиданиям наибольшая отдача не от количества просмотров статьи, а от комментариев и публикаций в социальных сетях. Я также полагал, что число просмотров и комментариев будет иметь более сильную корреляцию, однако зависимость вполне умеренная — нет надобности исключать ни одну из независимых переменных.

Теперь собственно сама модель, используем функцию lm .

В первой строке мы задаем параметры линейной регрессии. Строка points

. определяет зависимую переменную points и все остальные переменные в качестве регрессоров. Можно определить одну единственную независимую переменную через points

reads , набор переменных — points

Перейдем теперь к расшифровке полученных результатов.

- Intercept — Если у нас модель представлена в виде

, то тогда

— точка пересечения прямой с осью координат, или intercept .

- R-squared — Коэффициент детерминации указывает насколько тесной является связь между факторами регрессии и зависимой переменной, это соотношение объясненных сумм квадратов возмущений, к необъясненным. Чем ближе к 1, тем ярче выражена зависимость.

- Adjusted R-squared — Проблема с

в том, что он по любому растет с числом факторов, поэтому высокое значение данного коэффициента может быть обманчивым, когда в модели присутствует множество факторов. Для того, чтобы изъять из коэффициента корреляции данное свойство был придуман скорректированный коэффициент детерминации .

- F-statistic — Используется для оценки значимости модели регрессии в целом, является соотношением объяснимой дисперсии, к необъяснимой. Если модель линейной регрессии построена удачно, то она объясняет значительную часть дисперсии, оставляя в знаменателе малую часть. Чем больше значение параметра — тем лучше.

- t value — Критерий, основанный на t распределении Стьюдента . Значение параметра в линейной регрессии указывает на значимость фактора, принято считать, что при t > 2 фактор является значимым для модели.

- p value — Это вероятность истинности нуль гипотезы, которая гласит, что независимые переменные не объясняют динамику зависимой переменной. Если значение p value ниже порогового уровня (.05 или .01 для самых взыскательных), то нуль гипотеза ложная. Чем ниже — тем лучше.

Можно попытаться несколько улучшить модель, сглаживая нелинейные факторы: комментарии и посты в социальных сетях. Заменим значения переменных fb и comm их степенями.

Проверим значения параметров линейной регрессии.

Как видим в целом отзывчивость модели возросла, параметры подтянулись и стали более шелковистыми , F-статистика выросла, так же как и скорректированный коэффициент детерминации .

Проверим, соблюдены ли условия применимости модели линейной регрессии? Тест Дарбина-Уотсона проверяет наличие автокорреляции возмущений.

И напоследок проверка неоднородности дисперсии с помощью теста Бройша-Пагана.

В заключение

Конечно наша модель линейной регрессии рейтинга Хабра-топиков получилось не самой удачной. Нам удалось объяснить не более, чем половину вариативности данных. Факторы надо чинить, чтобы избавляться от неоднородной дисперсии, с автокорреляцией тоже непонятно. Вообще данных маловато для сколь-нибудь серьезной оценки.

Но с другой стороны, это и хорошо. Иначе любой наспех написанный тролль-пост на Хабре автоматически набирал бы высокий рейтинг, а это к счастью не так.

Множественная регрессия и корреляция

Решение Тестовых заданий

Парная регрессия и корреляция

1. Наиболее наглядным видом выбора уравнения парной регрессии является:

в) экспериментальный (табличный).

Ответ: б) графический.

В парной регрессии выбор вида математической функции

2) аналитическим, т.е. исходя из теории изучаемой взаимосвязи;

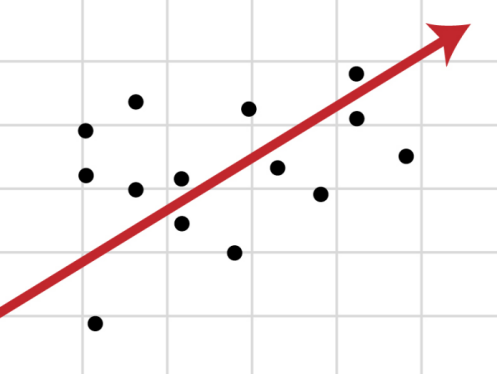

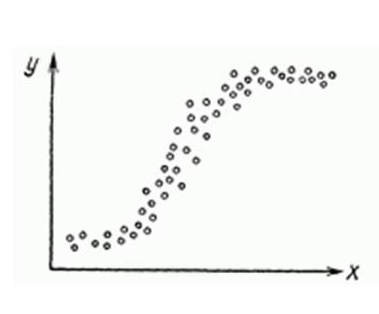

При изучении зависимости между двумя признаками графический метод подбора вида уравнения регрессии достаточно нагляден. Он основан на поле корреляции.

2. Рассчитывать параметры парной линейной регрессии можно, если у нас есть:

а) не менее 5 наблюдений;

б) не менее 7 наблюдений;

в) не менее 10 наблюдений.

Отчет: б) не менее 7 наблюдений

Считается, что число наблюдений должно в 7-8 раз превышать число рассчитываемых параметров при переменной

3. Суть метода наименьших квадратов состоит в:

а) минимизации суммы остаточных величин;

б) минимизации дисперсии результативного признака;

в) минимизации суммы квадратов остаточных величин.

Ответ: б) минимизации дисперсии результативного признака

Классический подход к оцениванию параметров линейной модели множественной регрессии основан на методе наименьших квадратов (МНК). МНК позволяет получить такие оценки параметров, при которых сумма квадратов отклонений фактических значений результативного признака

4. Коэффициент линейного парного уравнения регрессии:

а) показывает среднее изменение результата с изменением фактора на одну единицу;

б) оценивает статистическую значимость уравнения регрессии;

в) показывает, на сколько процентов изменится в среднем результат, если фактор изменится на 1%.

Ответ: а) показывает среднее изменение результата с изменением фактора на одну единицу

Параметр

Возможность четкой экономической интерпретации коэффициента регрессии сделала линейное уравнение регрессии достаточно распространенным в эконометрических исследованиях.

На основании наблюдений за 50 семьями построено уравнение регрессии , где – потребление, – доход. Соответствуют ли знаки и значения коэффициентов регрессии теоретическим представлениям?

в) ничего определенного сказать нельзя.

Ответ: а) да (пример рассматривали на паре с доходами и расходами)

6. Суть коэффициента детерминации

а) оценивает качество модели из относительных отклонений по каждому наблюдению;

б) характеризует долю дисперсии результативного признака

в) характеризует долю дисперсии

Ответ: б) характеризует долю дисперсии результативного признака у, объясняемую регрессией, в общей дисперсии результативного признака

Квадрат индекса корреляции носит название индекса детерминации и характеризует долю дисперсии результативного признака

т.е. имеет тот же смысл, что и в линейной регрессии;

7. Качество модели из относительных отклонений по каждому наблюдению оценивает:

а) коэффициент детерминации

б)

в) средняя ошибка аппроксимации

Ответ: а) коэффициент детерминации

Для оценки качества подбора линейной функции рассчитывается квадрат линейного коэффициента корреляции

где

8. Значимость уравнения регрессии в целом оценивает:

а)

б)

в) коэффициент детерминации

Ответ: а) F-критерий Фишера

Оценка значимости уравнения регрессии в целом производится на основе

9. Классический метод к оцениванию параметров регрессии основан на:

а) методе наименьших квадратов:

б) методе максимального правдоподобия:

в) шаговом регрессионном анализе.

Ответ: в) шаговом регрессионном анализе

Отбор факторов, включаемых в регрессию, является одним из важнейших этапов практического использования методов регрессии. Подходы к отбору факторов на основе показателей корреляции могут быть разные. Они приводят построение уравнения множественной регрессии соответственно к разным методикам. В зависимости от того, какая методика построения уравнения регрессии принята, меняется алгоритм ее решения на ЭВМ.

Наиболее широкое применение получили следующие методы построения уравнения множественной регрессии:

1. Метод исключения – отсев факторов из полного его набора.

2. Метод включения – дополнительное введение фактора.

3. Шаговый регрессионный анализ – исключение ранее введенного фактора.

При отборе факторов также рекомендуется пользоваться следующим правилом: число включаемых факторов обычно в 6–7 раз меньше объема совокупности, по которой строится регрессия. Если это соотношение нарушено, то число степеней свободы остаточной дисперсии очень мало. Это приводит к тому, что параметры уравнения регрессии оказываются статистически незначимыми, а

10. Остаточная сумма квадратов равна нулю:

а) когда правильно подобрана регрессионная модель;

б) когда между признаками существует точная функциональная связь;

Ответ: в) никогда

Согласно основной идее дисперсионного анализа, общая сумма квадратов отклонений переменной

где

11. Объясненная (факторная) сумма квадратов отклонений в линейной парной модели имеет число степеней свободы, равное:

а)

б)

в)

Ответ: б)

Фактическое значение

Для парной линейной регрессии

12. Остаточная сумма квадратов отклонений в линейной парной модели имеет число степеней свободы, равное:

а)

б)

в)

Ответ: в)

Величина стандартной ошибки совместно с

Для оценки существенности коэффициента регрессии его величина сравнивается с его стандартной ошибкой, т.е. определяется фактическое значение

13. Общая сумма квадратов отклонений в линейной парной модели имеет число степеней свободы, равное:

а)

б)

в)

Ответ: а)

| Общая |  |  |  |

14. Для оценки значимости коэффициентов регрессии рассчитывают:

а)

б)

в) коэффициент детерминации

Ответ: в) коэффициент детерминации

Индекс детерминации

где

Соответственно величина

15. Какое уравнение регрессии нельзя свести к линейному виду:

а)

б)

в)

Ответ: в)

К внутренне нелинейным моделям можно отнести следующие модели:

16. Какое из уравнений является степенным:

а)

б)

в)

Ответ: б)

Существуют регрессии, нелинейные по оцениваемым параметрам, например

– степенная –

17. Параметр

а) коэффициентом детерминации;

б) коэффициентом эластичности;

в) коэффициентом корреляции.

Ответ: б) коэффициентом эластичности;

Широкое использование степенной функции связано с тем, что параметр

Так как для остальных функций коэффициент эластичности не является постоянной величиной, а зависит от соответствующего значения фактора

18. Коэффициент корреляции

Ответ: а) от –1 до 1

Линейный коэффициент корреляции находится в пределах:

19. Для функции

а)

б)

в)

Ответ: б)

Вид функции,  | Первая производная,  | Средний коэффициент эластичности,  |

|  |  |

20. Какое из следующих уравнений нелинейно по оцениваемым параметрам:

а)

б)

в)

Ответ: в)

Среди нелинейных моделей наиболее часто используется степенная функция

где

а затем потенцированием находим искомое уравнение.

Множественная регрессия и корреляция

1. Добавление в уравнение множественной регрессии новой объясняющей переменной:

а) уменьшает значение коэффициента детерминации;

б) увеличивает значение коэффициента детерминации;

в) не оказывает никакого влияние на коэффициент детерминации.

Ответ: б) увеличивает значение коэффициента детерминации

При дополнительном включении в регрессию

2. Скорректированный коэффициент детерминации:

а) меньше обычного коэффициента детерминации;

б) больше обычного коэффициента детерминации;

в) меньше или равен обычному коэффициенту детерминации;

Ответ: в) меньше или равен обычному коэффициенту детерминации

Скорректированный коэффициент множественной детерминации определяет тесноту связи с учетом степеней свободы общей и остаточной дисперсий. Он дает такую оценку тесноты связи, которая не зависит от числа факторов и поэтому может сравниваться по разным моделям с разным числом факторов.

В рассмотренных показателях множественной корреляции (индекс и коэффициент) используется остаточная дисперсия, которая имеет систематическую ошибку в сторону преуменьшения, тем более значительную, чем больше параметров определяется в уравнении регрессии при заданном объеме наблюдений

Скорректированный индекс множественной корреляции содержит поправку на число степеней свободы, а именно остаточная сумма квадратов

Формула скорректированного индекса множественной детерминации имеет вид:

3. С увеличением числа объясняющих переменных скорректированный коэффициент детерминации:

в) не изменяется.

Ответ: б) уменьшается

Поскольку

Чем больше величина

4. Число степеней свободы для остаточной суммы квадратов в линейной модели множественной регрессии равно:

а)

б)

в)

Ответ: в)

| Компоненты дисперсии | Сумма квадратов | Число степеней свободы | Дисперсия на одну степень свободы |

| Остаточная |  |  |  |

5. Число степеней свободы для общей суммы квадратов в линейной модели множественной регрессии равно:

а)

б)

в)

Ответ: а)

| Компоненты дисперсии | Сумма квадратов | Число степеней свободы | Дисперсия на одну степень свободы |

| Общая |  |  |  |

6. Число степеней свободы для факторной суммы квадратов в линейной модели множественной регрессии равно:

а)

б)

в)

| Компоненты дисперсии | Сумма квадратов | Число степеней свободы | Дисперсия на одну степень свободы |

| Факторная |  |  |  |

7. Множественный коэффициент корреляции

Процентное выражение дисперсии зависимой переменной y вычисляется:

8. Для построения модели линейной множественной регрессии вида

В линейной множественной регрессии

9. Стандартизованные коэффициенты регрессии

а) позволяют ранжировать факторы по силе их влияния на результат;

б) оценивают статистическую значимость факторов;

в) являются коэффициентами эластичности.

Ответ: а) позволяют ранжировать факторы по силе их влияния на результат

Ранжирование факторов, участвующих во множественной линейной регрессии, может быть проведено через стандартизованные коэффициенты регрессии (

10. Частные коэффициенты корреляции:

а) характеризуют тесноту связи рассматриваемого набора факторов с исследуемым признаком;

б) содержат поправку на число степеней свободы и не допускают преувеличения тесноты связи;

в) характеризуют тесноту связи между результатом и соответствующим фактором при элиминировании других факторов, включенных в уравнение регрессии.

Ответ: в) характеризуют тесноту связи между результатом и соответствующим фактором при элиминировании других факторов, включенных в уравнение регрессии.

Частные коэффициенты корреляции характеризуют тесноту связи между результатом и соответствующим фактором при элиминировании (устранении влияния) других факторов, включенных в уравнение регрессии.

11. Частный

а) оценивает значимость уравнения регрессии в целом;

б) служит мерой для оценки включения фактора в модель;

в) ранжирует факторы по силе их влияния на результат.

Ответ: б) служит мерой для оценки включения фактора в модель

Оценка значимости уравнения регрессии в целом производится на основе

12. Несмещенность оценки параметра регрессии, полученной по МНК, означает:

а) что она характеризуется наименьшей дисперсией;

б) что математическое ожидание остатков равно нулю;

в) увеличение ее точности с увеличением объема выборки.

Ответ: б) что математическое ожидание остатков равно нулю

Несмещенность оценки означает, что математическое ожидание остатков равно нулю. Если оценки обладают свойством несмещенности, то их можно сравнивать по разным исследованиям.

13. Эффективность оценки параметра регрессии, полученной по МНК, означает:

а) что она характеризуется наименьшей дисперсией;

б) что математическое ожидание остатков равно нулю;

в) увеличение ее точности с увеличением объема выборки.

Ответ: а) что она характеризуется наименьшей дисперсией

Оценки считаются эффективными, если они характеризуются наименьшей дисперсией. В практических исследованиях это означает возможность перехода от точечного оценивания к интервальному.

14. Состоятельность оценки параметра регрессии, полученной по МНК, означает:

а) что она характеризуется наименьшей дисперсией;

б) что математическое ожидание остатков равно нулю;

в) увеличение ее точности с увеличением объема выборки.

Ответ: в) увеличение ее точности с увеличением объема выборки

Состоятельность оценок характеризует увеличение их точности с увеличением объема выборки

15. Укажите истинное утверждение:

а) скорректированный и обычный коэффициенты множественной детерминации совпадают только в тех случаях, когда обычный коэффициент множественной детерминации равен нулю;

б) стандартные ошибки коэффициентов регрессии определяются значениями всех параметров регрессии;

в) при наличии гетероскедастичности оценки параметров регрессии становятся смещенными.

Ответ: в) при наличии гетероскедастичности оценки параметров регрессии становятся смещенными.

16. При наличии гетероскедастичности следует применять:

б) обобщенный МНК;

в) метод максимального правдоподобия.

Ответ: а) обычный МНК

При использовании обобщенного МНК с целью корректировки гетероскедастичности коэффициент регрессии

17. Фиктивные переменные – это:

а) атрибутивные признаки (например, как профессия, пол, образование), которым придали цифровые метки;

б) экономические переменные, принимающие количественные значения в некотором интервале;

в) значения зависимой переменной за предшествующий период времени.

Ответ: а) атрибутивные признаки (например, как профессия, пол, образование), которым придали цифровые метки;

Чтобы ввести такие переменные в регрессионную модель, им должны быть присвоены те или иные цифровые метки, т.е. качественные переменные преобразованы в количественные. Такого вида сконструированные переменные в эконометрике принято называть фиктивными переменными.

18. Если качественный фактор имеет три градации, то необходимое число фиктивных переменных:

Предполагая при параметре

В рассматриваемой матрице существует линейная зависимость между первым, вторым и третьим столбцами: первый равен сумме второго и третьего столбцов. Поэтому матрица исходных факторов вырождена. Выходом из создавшегося затруднения может явиться переход к уравнениям

т.е. каждое уравнение включает только одну фиктивную переменную

http://habr.com/ru/post/350668/

http://lektsii.org/14-43321.html