Индекс корреляции

Пример . Найдем степенное уравнение регрессии y = ax b .

Приводим к линейной системе уравнений:

ln(y) = ln(a) + bln(x)

Система нормальных уравнений.

a•n + b∑x = ∑y

a∑x + b∑x 2 = ∑y•x

Для наших данных система уравнений имеет вид

28a + 314 b = 231

314 a + 3601.3 b = 2651

Из первого уравнения выражаем а и подставим во второе уравнение:

Получаем эмпирические коэффициенты регрессии: b = 0.77, a = 0.37

Уравнение регрессии (эмпирическое уравнение регрессии):

y = e 0.37 x 0.77 = 0,68x 0.77

Эмпирические коэффициенты регрессии a и b являются лишь оценками теоретических коэффициентов βi, а само уравнение отражает лишь общую тенденцию в поведении рассматриваемых переменных.

Коэффициент эластичности находится по формуле:

Парная регрессия и корреляция

1. Парная регрессия и корреляция

1.1. Понятие регрессии

Парной регрессией называется уравнение связи двух переменных у и х

где у – зависимая переменная (результативный признак); х – независимая, объясняющая переменная (признак-фактор).

Различают линейные и нелинейные регрессии.

Линейная регрессия описывается уравнением: y = a + b × x +e .

Нелинейные регрессии делятся на два класса: регрессии, нелинейные относительно включенных в анализ объясняющих переменных, но линейные по оцениваемым параметрам, и регрессии, нелинейные по оцениваемым параметрам.

Примеры регрессий, нелинейных по объясняющим переменным, но ли-

нейных по оцениваемым параметрам:

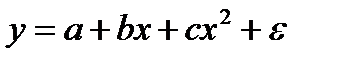

· полиномы разных степеней

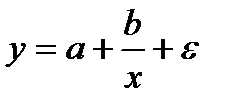

· равносторонняя гипербола:

Примеры регрессий, нелинейных по оцениваемым параметрам:

· степенная

· показательная

· экспоненциальная

Наиболее часто применяются следующие модели регрессий:

– прямой

– гиперболы

– параболы

– показательной функции

– степенная функция

1.2. Построение уравнения регрессии

Постановка задачи. По имеющимся данным n наблюдений за совместным

изменением двух параметров x и y <(xi,yi), i=1,2. n> необходимо определить

аналитическую зависимость ŷ=f(x), наилучшим образом описывающую данные наблюдений.

Построение уравнения регрессии осуществляется в два этапа (предполагает решение двух задач):

– спецификация модели (определение вида аналитической зависимости

– оценка параметров выбранной модели.

1.2.1. Спецификация модели

Парная регрессия применяется, если имеется доминирующий фактор, который и используется в качестве объясняющей переменной.

Применяется три основных метода выбора вида аналитической зависимости:

– графический (на основе анализа поля корреляций);

– аналитический, т. е. исходя из теории изучаемой взаимосвязи;

– экспериментальный, т. е. путем сравнения величины остаточной дисперсии Dост или средней ошибки аппроксимации , рассчитанных для различных

моделей регрессии (метод перебора).

1.2.2. Оценка параметров модели

Для оценки параметров регрессий, линейных по этим параметрам, используется метод наименьших квадратов (МНК). МНК позволяет получить такие оценки параметров, при которых сумма квадратов отклонений фактических значений результативного признака у от теоретических значений ŷx при тех же значениях фактора x минимальна, т. е.

В случае линейной регрессии параметры а и b находятся из следующей

системы нормальных уравнений метода МНК:

Можно воспользоваться готовыми формулами, которые вытекают из этой

Для нелинейных уравнений регрессии, приводимых к линейным с помощью преобразования (x, y) → (x’, y’), система нормальных уравнений имеет

вид (1.1) в преобразованных переменных x’, y’.

Коэффициент b при факторной переменной x имеет следующую интерпретацию: он показывает, на сколько изменится в среднем величина y при изменении фактора x на 1 единицу измерения.

Линеаризующее преобразование: x’ = 1/x; y’ = y.

Уравнения (1.1) и формулы (1.2) принимают вид

Линеаризующее преобразование: x’ = x; y’ = lny.

Модифицированная экспонента:

Степенная функция:

Линеаризующее преобразование: x’ = ln x; y’ = ln y.

Показательная функция:

Линеаризующее преобразование: x’ = x; y’ = lny.

Линеаризующее преобразование: x’ = ln x; y’ = y.

Парабола второго порядка:

Парабола второго порядка имеет 3 параметра a0, a1, a2, которые определяются из системы трех уравнений

1.3. Оценка тесноты связи

Тесноту связи изучаемых явлений оценивает линейный коэффициент

парной корреляции rxy для линейной регрессии (–1 ≤ r xy ≤ 1)

и индекс корреляции ρxy для нелинейной регрессии

Долю дисперсии, объясняемую регрессией, в общей дисперсии результативного признака у характеризует коэффициент детерминации r2xy (для линейной регрессии) или индекс детерминации (для нелинейной регрессии).

Коэффициент детерминации – квадрат коэффициента или индекса корреляции.

Для оценки качества построенной модели регрессии можно использовать

показатель (коэффициент, индекс) детерминации R2 либо среднюю ошибку аппроксимации.

Чем выше показатель детерминации или чем ниже средняя ошибка аппроксимации, тем лучше модель описывает исходные данные.

Средняя ошибка аппроксимации – среднее относительное отклонение

расчетных значений от фактических

Построенное уравнение регрессии считается удовлетворительным, если

значение не превышает 10–12 %.

1.4. Оценка значимости уравнения регрессии, его коэффициентов,

Оценка значимости всего уравнения регрессии в целом осуществляется с

помощью F-критерия Фишера.

F-критерий Фишера заключается в проверке гипотезы Но о статистической незначимости уравнения регрессии. Для этого выполняется сравнение

фактического Fфакт и критического (табличного) Fтабл значений F-критерия

Fфакт определяется из соотношения значений факторной и остаточной

дисперсий, рассчитанных на одну степень свободы

где n – число единиц совокупности; m – число параметров при переменных.

Для линейной регрессии m = 1 .

Для нелинейной регрессии вместо r 2 xy используется R2.

Fтабл – максимально возможное значение критерия под влиянием случайных факторов при степенях свободы k1 = m, k2 = n – m – 1 (для линейной регрессии m = 1) и уровне значимости α.

Уровень значимости α – вероятность отвергнуть правильную гипотезу

при условии, что она верна. Обычно величина α принимается равной 0,05 или

Если Fтабл Fфакт, то гипотеза Но не отклоняется и признается статистическая незначимость, ненадежность уравнения регрессии.

Для оценки статистической значимости коэффициентов линейной регрессии и линейного коэффициента парной корреляции применяется

t-критерий Стьюдента и рассчитываются доверительные интервалы каждого

Согласно t-критерию выдвигается гипотеза Н0 о случайной природе показателей, т. е. о незначимом их отличии от нуля. Далее рассчитываются фактические значения критерия tфакт для оцениваемых коэффициентов регрессии и коэффициента корреляции путем сопоставления их значений с величиной стандартной ошибки

Стандартные ошибки параметров линейной регрессии и коэффициента

корреляции определяются по формулам

tтабл и tфакт принимают или отвергают гипотезу Но.

tтабл – максимально возможное значение критерия под влиянием случайных факторов при данной степени свободы k = n–2 и уровне значимости α.

Связь между F-критерием Фишера (при k1 = 1; m =1) и t-критерием Стьюдента выражается равенством

Если tтабл tфакт, то гипотеза Но не отклоняется и признается случайная природа формирования а, b или

Значимость коэффициента детерминации R2 (индекса корреляции) определяется с помощью F-критерия Фишера. Фактическое значение критерия Fфакт определяется по формуле

Fтабл определяется из таблицы при степенях свободы k1 = 1, k2 = n–2 и при

заданном уровне значимости α. Если Fтабл

Частные уравнения множественной регрессии. Индексы множественной и частной корреляции и их расчет

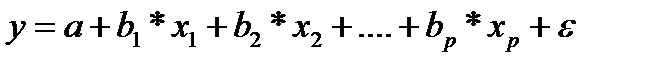

На основе линейного уравнения множественной регрессии

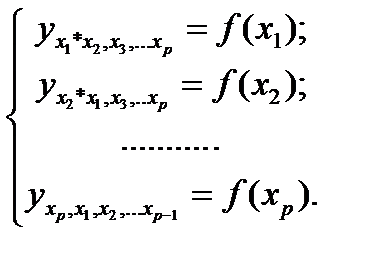

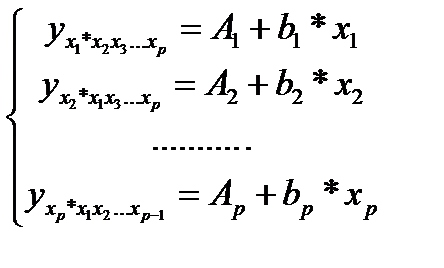

могут быть найдены частные уравнения регрессии:

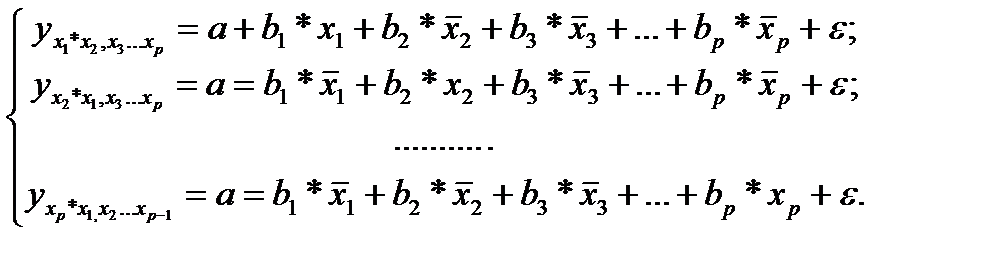

т.е. уравнения регрессии, которые связывают результативный признак с соответствующими факторами хi при закреплении других учитываемых во множественной регрессии факторов на среднем уровне. В случае линейной регрессии частные уравнения имеют следующий вид:

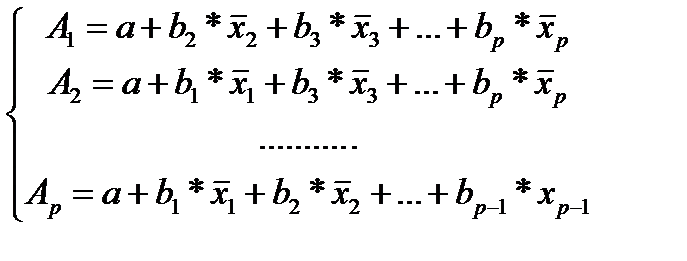

Подставляя в эти уравнения средние значения соответствующих факторов получаем систему уравнений линейной регрессии, т.е. имеем:

где

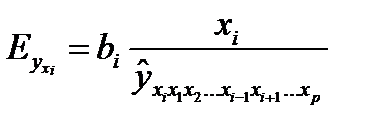

Частные уравнения регрессии характеризуют изолированное влияние фактора на результат, ибо другие факторы закреплены на низменном уровне. Эффекты влияния других факторов присоединены в них к свободному члену уравнения множественной регрессии (Аi).Это позволяет на основе частных уравнений регрессии определять частные коэффициенты эластичности

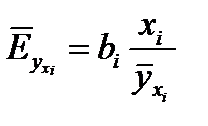

На основании данной информации могут быть найдены средние по совокупности показатели эластичности:

Практическая значимость уравнения множественной регрессии оценивается с помощью показателя множественной корреляции и его квадрата – коэффициента детерминации. Показатель множественной корреляции характеризует тесноту совместного влияния факторов на результат.

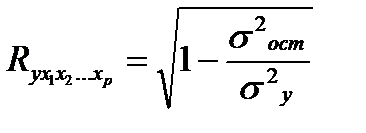

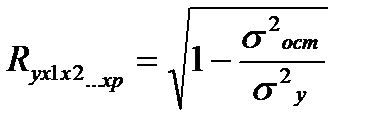

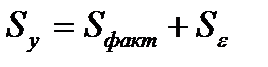

Независимо от вида уравнения индекс множественной корреляции рассчитывается по формуле:

где σ 2 y — общая дисперсия результативного признака,

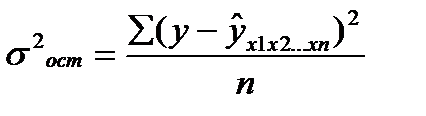

σ 2 ост — остаточная дисперсия .

Чем ближе его значение к 1, тем теснее связь результативного признака со всем набором исследуемых факторов.

Сравнивая индексы множественной регрессии и парной корреляции, можно сделать вывод о целесообразности включения в уравнение регрессии того или иного фактора. В частности, если дополнительно включенные в уравнение множественной регрессии факторы третьестепенны, то индекс множественной корреляции практически совпадает с индексом парной корреляции.

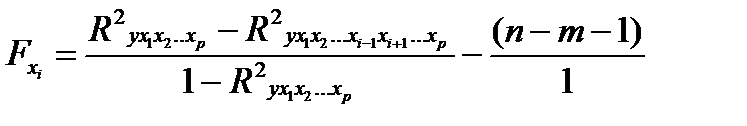

Если оценивается значимость влияния фактора хi в уравнении регрессии, то определяется частный F- критерий:

Значимость коэффициентов чистой регрессии производится по t — критерию Стьюдента.

24. Построение частных коэффициентов корреляции для модели множественной регрессии через показатель остаточной дисперсии

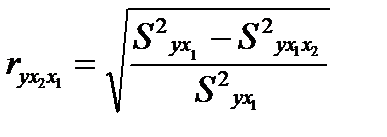

Частные коэффициенты (или индексы) корреляции характеризуют тесноту связи между результатом и соответствующим фактором при устранении влияния других факторов, включенных в уравнение регрессии.

Чем больше доля полученной разности в остаточной вариации, тем теснее связь между у и x2 , при неизменности действия фактора x1

Величина, рассчитываемая формулой:

называется индексом частной корреляции для фактора х2:

Аналогично определяется индекс частной корреляции для фактора x1.

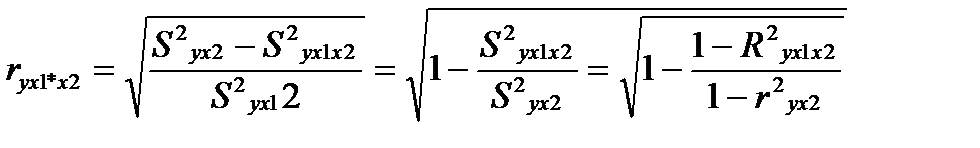

Выражая остаточную дисперсию через показатель детерминации

S 2 ост = σ 2 у (1-r 2 ), имеем формулу частной корреляции:

25. Коэффициент множественной корреляции

Практическая значимость уравнения множественной регрессии оценивается показателем множественной корреляции

Показатель множественной корреляции характеризует тесноту связи рассматриваемого набора факторов с исследуемым при знаком, или оценивает тесноту совместного влияния факторов на результат.

Независимо от формы связи показатель множественной корреляции можёт быть найден как индекс множественной корреляции:

σ 2 ост – остаточная дисперсия для уравнения у=f(x1,x2,… xр)

σ 2 у – общая дисперсия результативного признака

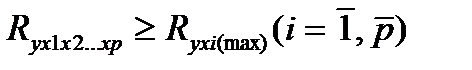

Методика построения индекса множественной корреляции аналогична построению индекса корреляции для парной зависимости. Его пределы от 0 до 1. Чем ближе его значение к 1, тем теснее связь результативного признака со всем I бором исследуемых факторов. Величина индекса множественно корреляции должна быть больше или равна максимальному парному индексу корреляции: —

Обоснованность включения факторов в регрессионный анализ приведет к существенному отличию показателя от индекса корреляции парной зависимости. При включении модель маловажных факторов происходит уравнение индекса множественной корреляции с индексом парной корреляции. Сравнивая индексы множественной и парной корреляции делают заключение о возможности включения в уравнение регрессии того или иного фактора.

Расчет индекса множественной Корреляции предполагает определение уравнения множественной регрессии и на его основе остаточной дисперсии:

Возможна и такая интерпретация формулы индекса множественной корреляции

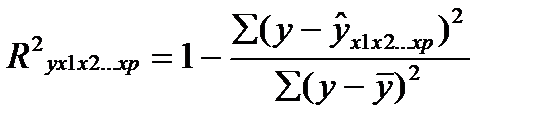

26. Коэффициент множественной детерминации

Коэффициент детерминации –это квадрат показателем множественной корреляции.

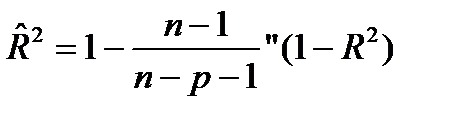

Множественный коэффициент детерминации можно рассматривать как меру качества уравнения регрессии, характеристику прогностической силы анализируемой регрессионной модели: чем ближе R 2 к единице, тем лучше регрессия описывает зависимость между объясняющими и зависимой переменными. Недостаток R 2 состоит в том, что его значение не убывает с ростом числа объясняющих переменных. В эконометрическом анализе чаще применяют скорректированный коэффициент детерминации R^ 2 определяемый по формуле

который может уменьшаться при введении в регрессионную модель переменных, не оказывающих существенного влияния на зависимую переменную.

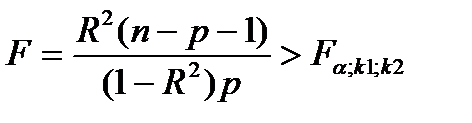

Если известен коэффициент детерминации R 2 то критерий значимости уравнения регрессии может быть записан в виде:

где ‚ к1= р, к2 = n — р — 1, ибо в уравнении множественной регрессии вместе со свободным членом оценивается m = р + 1 параметров.

27. Проверка гипотезы о значимости частного и множественного коэффициентов корреляции

Проверка гипотез используется, когда необходим обоснованный вывод о значимости частного и множественного коэффициентов корреляции. При этом гипотезой называется любое предположение о виде или параметрах неизвестного закона распределения.

Множественный коэффициент корреляции заключен в пре делах 0 до1. Он не меньше, чем абсолютная величина любого парного или частного коэффициента корреляции с таким же первичным индексом.

С помощью множественного коэффициента корреляции (по мере приближения к 1 делается вывод о тесноте взаимосвязи, но не о ее направлении.

Частный коэффициент корреляции. Если переменные коррелируют друг с другом, то на величине парного коэффициента корреляции частично сказывается влияние других переменных. В связи с этим часто возникает необходимость исследовать частную корреляцию между переменными при устранении влияния одной/нескольких переменных

28. Проверка гипотезы о значимости коэффициентов регрессии и модели множественной регрессии в целом

Основной предпосылкой регрессионного анализа является то, что только результативный признак (У) подчиняется нормальному закону распределения, а факторные признаки х 1 . Х 2 . х n могут иметь произвольный закон распределения. В анализе динамических рядов в качестве факторного признака выступает время t При этом в регрессионном анализе заранее подразумевается наличие причинно-следственных связей между результативным (У) и факторными х 1 . Х 2 . х n признаками. В тех случаях, когда из природы процессов в модели или из данных наблюдений над ней следует вывод о нормальном законе распределения двух СВ — Y и X , из которых одна является независимой, т. е. Y является функцией X , то возникает соблазн определить такую зависимость “формульно”, аналитически.Уравнение регрессии, или статистическая модель связи социально-экономических явлений, выражаемая функцией Y=f( х 1 . Х 2 . х n ) является достаточно адекватным реальному моделируемому явлению или процессу в случае соблюдения следующих требований их построения. 1) Совокупность исследуемых исходных данных должна быть однородной и математически описываться непрерывными функциями. 2) Возможность описания моделируемого явления одним или несколькими уравнениями причинно-следственных связей. 3) Все факторные признаки должны иметь количественное (цифровое) выражение. 4) Наличие достаточно большого объема исследуемой выборочной совокупности. 5) Причинно-следственные связи между явлениями и процессами следует описывать линейной или приводимой к линейной формой зависимости. 6) Отсутствие количественных ограничений на параметры модели связи. 7) Постоянство территориальной и временной структуры изучаемойсовокупности. Соблюдение данных требований позволяет исследователю построить статистическую модель связи, наилучшим образом аппроксимирующую моделируемые социально-экономические явления и процессы. В случае успеха нам будет намного проще вести моделирование. Конечно, наиболее заманчивой является перспектива линейной зависимости типа Y = a + b · X . Подобная задача носит название задачи регрессионного анализа и предполагает следующий способ решения. Выдвигается следующая гипотеза H 0 : случайная величина Y при фиксированном значении величины X распределена нормально с математическим ожиданием М y = a + b · X и дисперсией D y , не зависящей от X . При наличии результатов наблюдений над парами X i и Y i предварительно вычисляются средние значения M y и M x , а затем производится оценка коэффициента b в виде b = = R xy что следует из определениякоэффициента корреляции. После этого вычисляется оценка для a в виде <2 - 16>и производится проверка значимости полученных результатов. Таким образом, регрессионный анализ является мощным, хотя и далеко не всегда допустимым расширением корреляционного анализа, решая всё ту же задачу оценки связей в сложной системе.

29. Определение мультиколлинеарности. Последствия мулыиколлицеарности. Методы обнаружения мультиколлинеарности

Мультиколлинеарность -это процесс, при котором между факторами происходит совокупное воздействие друг на друга

Наличие мультиколлинеарности факторов может означать, что некоторые факторы действуют синхронно. В итоге вариация в исходных данных зависима и невозможно оценить воздействие каждого фактора в отдельности. Чем сильнее мультиколлинеарность факторов, тем менее надежна оценка распределения суммы объясненной вариации по отдельным факторам с помощью метода наименьших квадратов.

Если рассматривается регрессия у = а + b * х + с * z + d * v + ε то для расчета параметров с применением МНК предполагается равенство:

где

Если же факторы интеркоррелированы, то данное равенство нарушается.

Включение в модель мультиколлинеарных факторов нежелательно по причинам:

• затрудняется интерпретация параметров множественной регрессии как характеристик действия факторов в чистом виде, т.к. факторы коррелированны. При этом параметры линейной регрессии утрачивают экономический смысл;

• оценки параметров ненадежны, появляются стандартные ошибки, которые меняются с изменением объема наблюдений (по величине и знаку), Модель нельзя анализировать и строить на ее основе прогнозы.

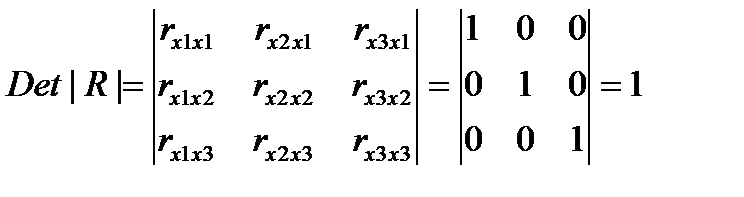

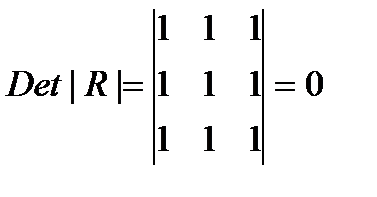

Для оценки мультиколлинеарности факторов может использоваться определитель матрицы парных Коэффициентов корреляции между факторами.

Если бы факторы не коррелировали между собой, то матрица парных коэффициентов корреляции между ними была бы единичной, т.к. все элементы не находящиеся на диагоналях равны 0. Для уравнения включающее три объясняющих переменных,

у = а + b1 * х1 + b2 * х2 + b3 * х3 +ε, при этом матрица коэффициентов корреляции между факторами имела определитель равный единице.

Если же между факторами существует полная линейная зависимость и все Коэффициенты корреляции равны единице, то определитель такой матрицы равен нулю.

Чем ближе к — нулю определитель матрицы межфакторной корреляции тем сильнее мультиколлинеарность факторов и ненадежнее результаты множествснной регрессии. Наоборот чем ближе к единице определитель матрицы межфакторной корреляции тем меньше мультиколлинеарность факторов.

30. Методы устранения мультиколлинеарности

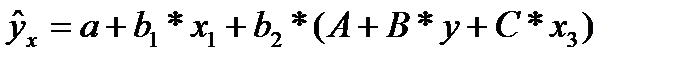

Устраняя мультиколлинеарность факторов чаще всего используют приведенную форму. Для этого в уравнение регрессии подставляют рассматриваемый фактор, выраженный из другого уравнения.

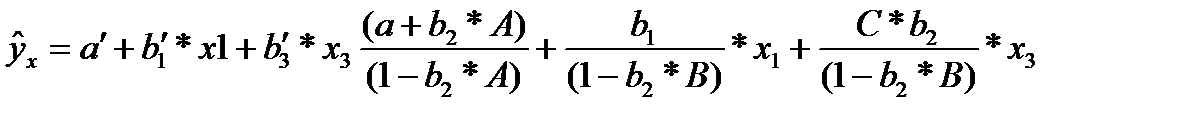

В двухфакторной регрессии вида

сделав предобразования получим:

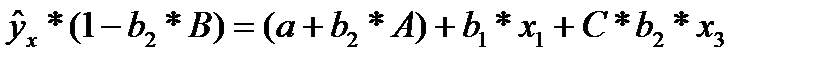

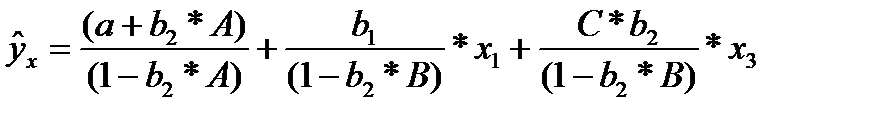

Если исключить один из факторов, то мы придем к уравнению парной регрессии. Вместе с тем, можно оставить факторы в модели, но исследовать данное двух факторное уравнение регрессии совместно с другим уравнением, в котором фактор рассматривается как зависимая переменная. При (1-b2*В) ≠ 0, делим первую и вторую части уравнения на (1-b2*В), получаем:

Получили приведенную форму уравнения для определения результативного признака у. Это уравнение может быть представлено в виде (32.4)

К нему для оценки параметров может быть применен метод наименьших квадратов.

Отбор факторов, включаемых в регрессию -основной этап практического использования методов регрессии. Подходы к отбору факторов на основе показателей корреляции могут различны. Они приводят построение уравнение множественной регрессии соответственно к разным методикам.

Наиболее распространены методы построения уравнения множественной регрессии:

• шаговый регрессионный анализ.

Каждый метод помогает устранить мультиколлинеарность позволяя производить отсев факторов из полного его набора (метод исключения), дополнительное введение фактора (метод включения), исключение ранее введенного фактора (шаговый регрессионный анализ).

На первый Взгляд может показаться, что матрица парных коэффициентов корреляции играет главную роль в отборе факторов. Вместе с тем вследствие взаимодействия факторов парные коэффициенты корреляции не могут полностью решать вопрос целесообразности включения в модель того определенного фактора. Эту роль выполняют показатели частной корреляции, оценивающие в чистом виде тесноту связи фактора с результатом. Матрица частных коэффициентов корреляции наиболее широко используется в процедуре отсева факторов. Отсев факторов можно проводить и по t-критерию Стьюдента для коэффициентов регрессии: из уравнения исключаются факторы с величиной t-критерия меньше табличного.

В заключении следует уточнить: число включаемых факторов обычно в 6—7 раз меньше объема совокупности, по которой строится регрессия. Если это соотношение нарушено, то число степеней свободы остаточной вариации очень мало. Это приводит к тому, что пара метры уравнения регрессии оказываются статистически незначимыми, а Р-критерий меньше табличного значения.

31. Модели регрессии, нелинейные по факторным переменным

Если между экономическими явлениями существуют нелинейные соотношения, то они выражаются с помощью соответствующих нелинейных функций: например, равносторонней гиперболы

Различают два класса нелинейных регрессий:

• регрессии, нелинейные относительно включенных в анализ объясняющих переменных, но линейные по оцениваемым параметрам;

• регрессии, нелинейные по оцениваемым параметрам.

Примером нелинейной регрессии по включаемым в нее объясняющим переменным могут служить следующие функции:

• полиномы разных степеней

К нелинейным регрессиям по оцениваемым параметрам относятся функции:

http://pandia.ru/text/78/146/82802.php

http://helpiks.org/3-55675.html