Уравнение регрессии

Вместе с этим калькулятором также используют следующие:

Уравнение множественной регрессии

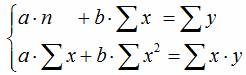

В сервисе для нахождения параметров регрессии используется МНК. Система нормальных уравнений для линейной регрессии:

Уравнение парной регрессии относится к уравнению регрессии первого порядка. Если эконометрическая модель содержит только одну объясняющую переменную, то она имеет название парной регрессии. Уравнение регрессии второго порядка и уравнение регрессии третьего порядка относятся к нелинейным уравнениям регрессии.

Пример . Осуществите выбор зависимой (объясняемой) и объясняющей переменной для построения парной регрессионной модели. Дайте графическое изображение регрессионной зависимости. Определите теоретическое уравнение парной регрессии. Оцените адекватность построенной модели (интерпретируйте R-квадрат, показатели t-статистики, F-статистики).

Решение будем проводить на основе процесса эконометрического моделирования.

1-й этап (постановочный) – определение конечных целей моделирования, набора участвующих в модели факторов и показателей, их роли.

Спецификация модели — определение цели исследования и выбор экономических переменных модели.

Ситуационная (практическая) задача. По 10 предприятиям региона изучается зависимость выработки продукции на одного работника y (тыс. руб.) от удельного веса рабочих высокой квалификации в общей численности рабочих x (в %).

2-й этап (априорный) – предмодельный анализ экономической сущности изучаемого явления, формирование и формализация априорной информации и исходных допущений, в частности относящейся к природе и генезису исходных статистических данных и случайных остаточных составляющих в виде ряда гипотез.

Уже на этом этапе можно говорить о явной зависимости уровня квалификации рабочего и его выработкой, ведь чем опытней работник, тем выше его производительность. Но как эту зависимость оценить?

Парная регрессия представляет собой регрессию между двумя переменными – y и x , т. е. модель вида:

Парная линейная регрессия. Задачи регрессионного анализа

Будут и задачи для самостоятельного решения, к которым можно посмотреть ответы.

Понятие линейной регрессии. Парная линейная регрессия

Линейная регрессия — выраженная в виде прямой зависимость среднего значения какой-либо величины от некоторой другой величины. В отличие от функциональной зависимости y = f(x) , когда каждому значению независимой переменной x соответствует одно определённое значение величины y, при линейной регрессии одному и тому же значению x могут соответствовать в зависимости от случая различные значения величины y.

Если в результате наблюдения установлено, что при каждом определённом значении x существует сколько-то (n) значений переменной y, то зависимость средних арифметических значений y от x и является регрессией в статистическом понимании.

Если установленная зависимость может быть записана в виде уравнения прямой

то эта регрессионная зависимость называется линейной регрессией.

О парной линейной регрессии говорят, когда установлена зависимость между двумя переменными величинами (x и y). Парная линейная регрессия называется также однофакторной линейной регрессией, так как один фактор (независимая переменная x) влияет на результирующую переменную (зависимую переменную y).

В уроке о корреляционной зависимости были разобраны примеры того, как цена на квартиры зависит от общей площади квартиры и от площади кухни (две различные независимые переменные) и о том, что результаты наблюдений расположены в некотором приближении к прямой, хотя и не на самой прямой. Если точки корреляционной диаграммы соединить ломанной линией, то будет получена линия эмпирической регрессии. А если эта линия будет выровнена в прямую, то полученная прямая будет прямой теоретической регрессии. На рисунке ниже она красного цвета (для увеличения рисунка щёлкнуть по нему левой кнопкой мыши).

По этой прямой теоретической регрессии может быть сделан прогноз или восстановление неизвестных значений зависимой переменной по заданным значениям независимой переменной.

В случае парной линейной регрессии для данных генеральной совокупности связь между независимой переменной (факториальным признаком) X и зависимой переменной (результативным признаком) Y описывает модель

N — число элементов генеральной совокупности.

Уравнение парной линейной регрессии для генеральной совокупности можно построить, если доступны данные обо всех элементах генеральной совокупности. На практике данные всей генеральной совокупности недоступны, но доступны данные об элементах некоторой выборки.

Поэтому параметры генеральной совокупности оценивают при помощи соответствующих параметров соответствующей выборки: свободный член прямой парной линейной регрессии генеральной совокупности

В результате получаем уравнение парной линейной регрессии выборки

n — размер выборки.

Чтобы уравнение парной линейной регрессии было более похоже на привычное уравнение прямой, его часто также записывают в виде

Уравнение парной линейной регрессии и метод наименьших квадратов

Определение коэффициентов уравнения парной линейной регрессии

Если заранее известно, что зависимость между факториальным признаком x и результативным признаком y должна быть линейной, выражающейся в виде уравнения типа

Если через

- прямая парной линейной регрессии проходит через точку

;

- среднее значение отклонений равна нулю:

;

- значения

и

не связаны:

.

Условие метода наименьших квадратов выполняется, если значения коэффициентов равны:

Пример 1. Найти уравнение парной линейной регрессии зависимости между валовым внутренним продуктом (ВВП) и частным потреблением на основе данных примера урока о корреляционной зависимости (эта ссылка, которая откроется в новом окне, потребуется и при разборе следующих примеров).

Решение. Используем рассчитанные в решении названного выше примера суммы:

Используя эти суммы, вычислим коэффициенты:

Таким образом получили уравнение прямой парной линейной регрессии:

Составить уравнение парной линейной регрессии самостоятельно, а затем посмотреть решение

Пример 2. Найти уравнение парной линейной регрессии для выборки из 6 наблюдений, если уже вычислены следующие промежуточные результаты:

Анализ качества модели линейной регрессии

Метод наименьших квадратов имеет по меньшей мере один существенный недостаток: с его помощью можно найти уравнение линейной регрессии и в тех случаях, когда данные наблюдений значительно рассеяны вокруг прямой регрессии, то есть находятся на значительном расстоянии от этой прямой. В таких случаях за точность прогноза значений зависимой переменной ручаться нельзя. Существуют показатели, которые позволяют оценить качество уравнения линейной регрессии прежде чем использовать модели линейной регрессии для практических целей. Разберём важнейшие из этих показателей.

Коэффициент детерминации

Коэффициент детерминации

Пример 3. Даны сумма квадратов отклонений, объясняемых моделью линейной регрессии (3500), общая сумма квадратов отклонений (5000) и сумма квадратов отклонений ошибки (1500). Найти коэффициент детерминации двумя способами.

F-статистика (статистика Фишера) для проверки качества модели линейной регрессии

Минимальное возможное значение F-статистики — 0. Чем выше значение статистики Фишера, тем качественнее модель линейной регрессии. Этот показатель представляет собой отношение объясненной суммы квадратов (в расчете на одну независимую переменную) к остаточной сумме квадратов (в расчете на одну степень свободы):

где m — число объясняющих переменных.

Сумма квадратов остатков

Сумма квадратов остатков (RSS) измеряет необъясненную часть дисперсии зависимой переменной:

остатки — разности между реальными значениями зависимой переменной и значениями, оценёнными уравнением линейной регрессии.

В случае качественной модели линейной регрессии сумма квадратов остатков стремится к нулю.

Стандартная ошибка регрессии

Стандартная ошибка регрессии (SEE) измеряет величину квадрата ошибки, приходящейся на одну степень свободы модели:

Чем меньше значение SEE, тем качественнее модель.

Пример 4. Рассчитать коэффициент детерминации для данных из примера 1.

Решение. На основании данных таблицы (она была приведена в примере урока о корреляционной зависимости) получаем, что SST = 63 770,593 , SSE = 10 459,587 , SSR = 53 311,007 .

Можем убедиться, что выполняется закономерность SSR = SST — SSE :

Получаем коэффициент детерминации:

Таким образом, 83,6% изменений частного потребления можно объяснить моделью линейной регресии.

Интерпретация коэффициентов уравнения парной линейной регрессии и прогноз значений зависимой переменной

Итак, уравнение парной линейной регрессии:

В этом уравнении a — свободный член, b — коэффициент при независимой переменной.

Интерпретация свободного члена: a показывает, на сколько единиц график регрессии смещён вверх при x=0, то есть значение переменной y при нулевом значении переменной x.

Интерпретация коэффициента при независимой переменной: b показывает, на сколько единиц изменится значение зависимой переменной y при изменении x на одну единицу.

Пример 5. Зависимость частного потребления граждан от ВВП (истолкуем это просто: от дохода) описывается уравнением парной линейной регрессии

Решение. Подставляем в уравнение парной линейной регрессии x i = 20000 и получаем прогноз потребления при доходе в 20 000 у.е. y i = 17036,4662 .

Подставляем в уравнение парной линейной регрессии x i = 5000 и получаем прогноз увеличения потребления при увеличении дохода на 5000 у.е. y i = 4161,9662 .

Если доход не меняется, то x i = 0 и получаем, что потребление уменьшается на 129,5338 у.е.

Задачи регрессионного анализа

Регрессионный анализ — раздел математической статистики, объединяющий практические методы исследования регрессионной зависимости между величинами по статистическим данным.

Наиболее частые задачи регрессионного анализа:

- установление факта наличия или отсутствия статистических зависимостей между переменными величинами;

- выявление причинных связей между переменными величинами;

- прогноз или восстановление неизвестных значений зависимых переменных по заданным значениям независимых переменных.

Также делаются проверки статистических гипотез о регрессии. Кроме того, при изучении связи между двумя величинами по результатам наблюдений в соответствии с теорией регрессии предполагается, что зависимая переменная имеет некоторое распределение вероятностей при фиксированном значении независимой переменной.

В исследованиях поведения человека, чтобы они претендовали на объективность, важно не только установить зависимость между факторами, но и получить все необходимые статистические показатели для результата проверки соответствующей гипотезы.

Проверка гипотезы о равенстве нулю коэффициента направления прямой парной линейной регрессии

Одна из важнейших гипотез в регрессионном анализе — гипотеза о том, что коэффициент направления прямой регрессии генеральной совокупности

Если это предположение верно, то изменения независимой переменной X не влияют на изменения зависимой переменной Y: переменные X и Y не коррелированы, то есть линейной зависимости Y от X нет.

рассматривают во взаимосвязи с альтернативной гипотезой

Статистика коэффициента направления

соответствует распределению Стьюдента с числом степеней свободы v = n — 2 ,

где

Доверительный интервал коэффициента направления прямой линейной регрессии:

Критическая область, в которой с вероятностью P = 1 — α отвергают нулевую гипотезу и принимают альтернативную гипотезу:

Пример 6. На основе данных из предыдущих примеров (о ВВП и частном потреблении) определить доверительный интервал коэффициента направления прямой линейной регресии 95% и проверить гипотезу о равенстве нулю коэффициента направления прямой парной линейной регрессии.

Можем рассчитать, что

Таким образом, стандартная погрешность коэффициента направления прямой линейной регресии b 1 :

Так как

Так как гипотетическое значение коэффициента — нуль — не принадлежит доверительному интервалу, с вероятностью 95% можем отвергнуть основную гипотезу и принять альтернативную гипотезу, то есть считать, что зависимая переменная Y линейно зависит от независимой переменной X.

Оценка значимости параметров уравнения парной линейной регрессии

Парная регрессия представляет собой регрессию между двумя переменными

—у и х, т.е. модель вида

, где у — результативный признак,т.е зависимая переменная; х — признак-фактор.

Линейная регрессия сводится к нахождению уравнения вида

Уравнение вида

Построение линейной регрессии сводится к оценке ее параметров а и в.

Оценки параметров линейной регрессии могут быть найдены разными методами.

1.

2.

Параметр b называется коэффициентом регрессии. Его величина показывает

среднее изменение результата с изменением фактора на одну единицу.

Формально а — значение у при х = 0. Если признак-фактор

не имеет и не может иметь нулевого значения, то вышеуказанная

трактовка свободного члена, а не имеет смысла. Параметр, а может

не иметь экономического содержания. Попытки экономически

интерпретировать параметр, а могут привести к абсурду, особенно при а 0,

то относительное изменение результата происходит медленнее, чем изменение

проверка качества найденных параметров и всей модели в целом:

-Оценка значимости коэффициента регрессии (b) и коэффициента корреляции

-Оценка значимости всего уравнения регрессии. Коэффициент детерминации

Уравнение регрессии всегда дополняется показателем тесноты связи. При

использовании линейной регрессии в качестве такого показателя выступает

линейный коэффициент корреляции rxy. Существуют разные

модификации формулы линейного коэффициента корреляции.

Линейный коэффициент корреляции находится и границах: -1≤.rxy

≤ 1. При этом чем ближе r к 0 тем слабее корреляция и наоборот чем

ближе r к 1 или -1, тем сильнее корреляция, т.е. зависимость х и у близка к

линейной. Если r в точности =1или -1 все точки лежат на одной прямой.

Если коэф. регрессии b>0 то 0 ≤.rxy ≤ 1 и

в модели факторов.

МНК позволяет получить такие оценки параметров а и b, которых

сумма квадратов отклонений фактических значений результативного признака

(у) от расчетных (теоретических)

всего множества линий линия регрессии на графике выбирается так, чтобы сумма

квадратов расстояний по вертикали между точками и этой линией была бы

минимальной.

Решается система нормальных уравнений

ОЦЕНКА СУЩЕСТВЕННОСТИ ПАРАМЕТРОВ ЛИНЕЙНОЙ РЕГРЕССИИ.

Оценка значимости уравнения регрессии в целом дается с помощью F-критерия

Фишера. При этом выдвигается нулевая гипотеза, что коэффициент регрессии равен

нулю, т. е. b = 0, и следовательно, фактор х не оказывает

влияния на результат у.

Непосредственному расчету F-критерия предшествует анализ дисперсии.

Центральное место в нем занимает разложение общей суммы квадратов отклонений

переменной у от средне го значения у на две части —

«объясненную» и «необъясненную»:

отклонения объясненная регрессией

— остаточная сумма квадратов отклонения.

Любая сумма квадратов отклонений связана с числом степеней свободы, т.

е. с числом свободы независимого варьирования признака. Число степеней свободы связано с числом единиц совокупности nис числом определяемых по ней констант. Применительно к исследуемой проблеме число cтепеней свободы должно показать, сколько независимых отклонений из п возможных требуется для

образования данной суммы квадратов.

Дисперсия на одну степень свободы D.

F-отношения (F-критерий):

Ecли нулевая гипотеза справедлива, то факторная и остаточная дисперсии не

отличаются друг от друга. Для Н0 необходимо опровержение, чтобы

факторная дисперсия превышала остаточную в несколько раз. Английским

статистиком Снедекором разработаны таблицы критических значений F-отношений

при разных уровнях существенности нулевой гипотезы и различном числе степеней

свободы. Табличное значение F-критерия — это максимальная величина отношения

дисперсий, которая может иметь место при случайном их расхождении для данного

уровня вероятности наличия нулевой гипотезы. Вычисленное значение F-отношения

признается достоверным, если о больше табличного. В этом случае нулевая

гипотеза об отсутствии связи признаков отклоняется и делается вывод о

существенности этой связи: Fфакт > Fтабл Н0

Если же величина окажется меньше табличной Fфакт ‹, Fтабл

, то вероятность нулевой гипотезы выше заданного уровня и она не может быть

отклонена без серьезного риска сделать неправильный вывод о наличии связи. В

этом случае уравнение регрессии считается статистически незначимым. Но

http://function-x.ru/statistics_regression1.html

http://lektsii.org/6-29199.html

;

; ;

; и

и  не связаны:

не связаны:  .

.