Регрессионный анализ

Методы корреляционного анализа, позволяющего решать задачи определения тесноты и направления связи, существующей между изучаемыми величинами. Регрессионный анализ представляет собой следующий этап статистического анализа и позволяет предсказать значения случайной величины на основании значений одной или нескольких независимых случайных величин. Достижение этой цели оказывается возможным за счет определения вида аналитического выражения, описывающего связь зависимой случайной величины Y (которую в этом случае называют результативным признаком) с независимыми случайными величинами Х1 ,Х2 , . Хm (которые называют факторами).

Основной задачей регрессионного анализа является установление формы линии регрессии и изучение зависимости между переменными. Основной задачей корреляционного анализа — выявление связи между случайными переменными и оценка ее тесноты.

Форма связи результативного признака Y с факторами Х1 ,Х2 , . Хm называется уравнением регрессии. В зависимости от типа выбранного уравнения различают линейную и нелинейную регрессию (например, квадратичную, логарифмическую, экспоненциальную и т. д.).

Регрессия может быть парная (простая) и множественная, что определяется числом взаимосвязанных признаков. Если исследуется связь между двумя признаками (результативным и факторным), то регрессия называется парной (простой); к этому типу относится, например, исследование зависимости между продажами и затратами на рекламу. Если исследуется связь между тремя и более признаками, то регрессия называется множественной (многофакторной) — например, если исследуется связь между уровнем потребления, доходом, финансовым состоянием и размером семьи.

На этапе регрессионного анализа решаются следующие основные задачи.

1. Выбор общего вида уравнения регрессии и определение параметров регрессии.

2. Определение в регрессии степени взаимосвязи результативного признака и факторов, проверка общего качества уравнения регрессии.

3. Проверка статистической значимости каждого коэффициента уравнения регрессии и определение их доверительных интервалов.

Простая линейная регрессия

Выбор общего вида уравнения регрессии является важной задачей, поскольку форма связи выявляет механизм получения значений зависимой случайной переменной Y. Форма связи может быть линейной или нелинейной. Линейная связь описывается линейным уравнением. Уравнение простой линейной регрессии имеет вид:

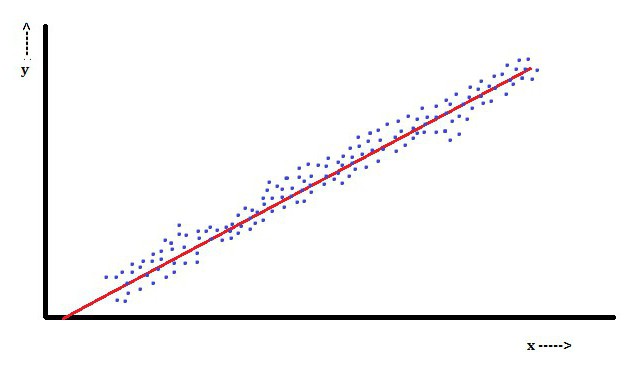

График этой функции называется линией регрессии. Линия регрессии точнее всего отражает распределение экспериментальных значений на диаграмме рассеяния, а угол ее наклона характеризует степень зависимости между двумя переменными.

Параметры уравнения регрессии могут быть определены с помощью метода наименьших квадратов (именно этот метод и используется в Microsoft Excel). При определении параметров модели методом наименьших квадратов минимизируется сумма квадратов остатков.

Для нахождения оценок параметров b0 и b1 доставляющих минимум функции Qocm, вычисляются и приравниваются к нулю частные производные этой функции, откуда система нормальных уравнении принимает следующий вид:

После простых преобразований имеем:

Тогда коэффициент наклона прямой регрессии равен:

а свободный член регрессии:

Для свободного члена последнее равенство можно переписать следующим образом:

откуда

Отсюда следует, что для определения линии регрессии достаточно знать лишь ее коэффициент наклона b1. Равенство для b1. можно упростить, если использовать найденное значение выборочного коэффициента корреляции г:

где

Из последнего выражения для b1, ясно виден общий смысл коэффициента корреляции: чем меньше г, тем ближе линия регрессии к горизонтальному положению, т. е. тем ближе будут средние значения уi,- к состоянию неизменяемости.

Для анализа общего качества уравнения линейной регрессии используется обычно коэффициент детерминации R2, который получается посредством простого возведения в квадрат коэффициента корреляции. Коэффициент детерминации показывает, в какой мере изменчивость величины Y объясняется поведением величины X. Например, если коэффициент корреляции совокупных данных, относящихся к производственным затратам, равняется 0,8, то коэффициент детерминации R2 = 0,82 = 0,64 или 64%. Это значение говорит о том, что 64% вариации (изменчивости) недельных затрат объясняется количеством изделий, выпущенных за неделю. Остальная часть (36%) вариации общих затрат объясняется другими причинами.

Так как в большинстве случаев уравнение регрессии приходится строить на основе выборочных данных, то возникает вопрос об адекватности построения уравнения данным генеральной совокупности. Для этого проводится проверка статистической значимости коэффициента детерминации R2 на основе F-критерия Фишера:

где n — число наблюдений, a m — число факторов в уравнении регрессии.

В математической статистике доказывается, что если гипотеза Н0: R2 = 0 выполняется, то величина F имеет F-распределение с k = m и l=п-ш-1 степенями свободы, т. е.

Гипотеза Н0: R2 = 0 о незначимости коэффициента детерминации R2 отвергается, если FP > Fкр, а принимается альтернативная гипотеза — о значимости R2 .При значениях

Возможна ситуация, когда часть вычисленных коэффициентов регрессии не обладает необходимой степенью значимости, т. е. значения данных коэффициентов будут меньше их стандартной ошибки. В этом случае такие коэффициенты должны быть исключены из уравнения регрессии. Поэтому проверка адекватности построенного уравнения регрессии наряду с проверкой значимости коэффициента детерминации R2 включает в себя также и проверку значимости каждого коэффициента регрессии.

Значимость коэффициентов регрессии проверяется с помощью t-критерия Стьюдента:

где

В математической статистике доказывается, что если гипотеза

1 степенями свободы, т. е.

Гипотеза Н0: Ь1 = 0 о незначимости коэффициента регрессии отвергается, если │tp│> │tкр│, а принимается альтернативная о значимости Ь1. Кроме того, зная значение tкр можно найти границы доверительных интервалов для коэффициентов регрессии.

Пусть имеется корреляционное поле производства пшеницы (обозначено точками на графике) для 50-ти сельхоз предприятий. Здесь Y-годовой сбор пшеницы, X-площади посевов.

Регрессионный анализ позволяет определить аналитическое выражение для уравнения линии регрессии оценить значимость коэффициентов этого уравнения.

Задача. На рис. 2 представлены данные о суточном объеме производства и количестве занятых работников для некоторой совокупности дней. По представленным данным необходимо определить параметры уравнения линейной регрессии и выполнить его анализ.

Для расчета параметров уравнения линейной регрессии и проверки его адекватности исследуемому процессу, Microsoft Excel располагает функцией Регрессия. Для вызова этой функций необходимо выбрать команду меню Сервис→Анализ данных (Tools→Data Analysis). На экране раскроется диалоговое окно Анализ данных (Data Analysis), в котором следует выбрать значение Regression, в результате чего на экране появится диалоговое окно Regression, представленное на рис. 1

В диалоговом окне Regression задаются следующие параметры.

1. В поле Input Y Range (Входные данные У) вводится диапазон ячеек, содержащих исходные данные по результативному признаку. Диапазон должен состоять из одного столбца.

2. В поле Input X Range (Входные данные X) вводится диапазон ячеек, содержащих исходные данные факторного признака. Максимальное число входных диапазонов (столбцов) равно 16.

3. Флажок опции Labels (Метки) устанавливается в том случае, если первая строка/столбец во входном диапазоне содержит заголовок. Если заголовок отсутствует, этот флажок следует сбросить. В последнем случае для данных выходного диапазона будут автоматически созданы стандартные названия.

4. Флажок опции Confidence Level (Уровень надежности) устанавливается в том случае, если в расположенное рядом с флажком поле необходимо ввести уровень надежности, отличный от уровня 95%, применяемого по умолчанию. Установленный в данном поле уровень надежности используется для проверки значимости коэффициента детерминации и коэффициентов регрессии. Если данный флажок опции сброшен, в таблице параметров уравнения регрессии генерируются две одинаковые пары столбцов для границ доверительных интервалов.

5. Флажок опции Константа — нуль (Constant is Zero) устанавливается в том случае, когда требуется, чтобы линия регрессии прошла через начало координат (т. е. Ь0 = 0).

6. Переключатель в группе Output options (Режимы вывода) может быть установлен в одно из трех положений, определяющих, где должны быть размещены результаты расчета: Output Range (Выходной интервал), New Worksheet Ply (Новый рабочий лист) или New Workbook (Новая рабочая книга).

7. Флажок опции Residuals (Остатки) устанавливается в том случае, если в диапазон ячеек с выходными данными требуется включить столбец остатков.

8. Флажок опции Standardized Residuals (Стандартизованные остатки) устанавливается в том случае, если в диапазон ячеек с выходными данными требуется включить столбец стандартизованных остатков.

9. Флажок опции Residual Plots (График остатков) должен быть установлен, если на рабочий лист требуется вывести точечные графики зависимости остатков от факторных признаков xt.

10. Флажок опции Line Fit Plots (График подбора) должен быть установлен, если на рабочий лист требуется вывести точечные графики зависимости теоретических результативных значений у от факторных признаков х.

11. Флажок опции Normal Probability Plots (График вероятности нормального распределения) должен быть установлен, если на рабочий лист требуется вывести точечный график зависимости наблюдаемых значений у от автоматически формируемых интервалов персентелей.

Результаты решения данной задачи с помощью функции Regression представлены на рисунках 3-7.

На рисунке 3 представлены результаты расчета регрессионной статистики. Эти результаты соответствуют следующим статистическим показателям:

• Множественный R — коэффициент корреляции R;

• R-квадрат — коэффициент детерминации R2 (квадрат коэффициента корреляции);

• Нормированный R — нормированное значение коэффициента корреляции; •Стандартная ошибка — стандартное отклонение для остатков;

• Наблюдения — это число исходных наблюдений.

На рисунке 4 представлены результаты дисперсионного анализа, которые используются для проверки значимости коэффициента детерминации R2.

Значения в столбцах на рисунке. 4 имеют следующую интерпретацию.

• Столбец df — это число степеней свободы. Для строки Регрессия число степеней свободы определяется количеством факторных признаков m, для строки Остаток — числом наблюдений n и количеством переменных в уравнении регрессии m+1: п -(m + 1), а для строки Итого — суммой степеней свободы для строк Регрессия и Остаток и, следовательно, равно п — 1.

• Столбец SS — это сумма квадратов отклонений. Для строки Регрессия значение определяется как сумма квадратов отклонений теоретических данных от среднего:

Для строки Остаток это сумма квадратов отклонений эмпирических данных от теоретических:

•Для строки Итого это сумма квадратов отклонений эмпирических данных от среднего:

• Столбец MS содержит значения дисперсии, которые рассчитываются по формуле:

Для строки Регрессия это факторная дисперсия

•Для строки Остаток это остаточная дисперсия

• Столбец F содержит расчетное значение F-критерия Фишера Fp вычисляемое по формуле:

• Столбец Значимость F содержит значение уровня значимости, соответствующее вычисленному значению Fр.

На рисунке 5 представлены полученные значения коэффициентов регрессии Ь1, и их статистические оценки.

Столбцы на рисунке 5 содержат следующие значения.

• Стандартная ошибка — стандартные ошибки коэффициентов Ь1 и и b0 .

Погрешность линейного коэффициента уравнения равная 7,44 и ошибка свободного члена равная 59,5 вполне приемлемы по отношению к величинам данных коэффициентов. уравнения 23 статистически велика, так как превосходит значение свободного члена. Поэтому ошибки не должны значительно влиять на эффективность описания входных данных полученным регрессионным уравнением.

• t-статистика — расчетные значения t-критерия, вычисляемые по формуле:

Чем больше отличается от нуля величина t-статистики, тем статистически лучше.

• Р-значение — значения уровней значимости, соответствующие вычисленным значениям tp . Оно характеризует насколько стандартную погрешность можно считать статистически значимой

• Нижние 95% и Верхние 95% — нижние и верхние границы доверительных интервалов для коэффициентов регрессии Ь1. и b0.

На рисунке 6 представлены теоретические значения

Наконец, на рисунке 7 показаны вычисленные интервалы перцентилей и соответствующие им эмпирические значения у.

Перцентили — это характеристики набора данных, которые выражают ранги элементов в виде процентов от 0 до 100%, а не в виде чисел от 1 до n, таким образом, что наименьшему значению соответствует нулевой перцентиль, наибольшему — 100-й, медиане — 50-й и т. д.

Перцентили можно рассматривать как показатели, разбивающие наборы количественных и порядковых данных на определенные части. Например, 70-й перцентиль эффективности продаж может быть равен 60

Под рангом (R) понимают номер (порядковое место) значения случайной величины в наборе данных

Переходя к анализу полученных расчетных данных, можно построить уравнение регрессии с вычисленными коэффициентами, которое будет выражать зависимость объема производства от количества работников.

Значение множественного коэффициента детерминации R2= 0,79 (рис. 10.3) показывает, что 79% общей вариации результативного признака объясняется вариацией факторного признака X. Значит, выбранный фактор существенно влияет на объем производства, что подтверждает правильность включения его в построенную модель.

Рассчитанный уровень значимости (показатель Значимость F на рисунке 4)

Проверка значимости коэффициента детерминации R2 и коэффициентов регрессии Ь0 и b1, при факторном признаке подтверждает адекватность полученного уравнения.

Корреляция и регрессия

Линейное уравнение регрессии имеет вид y=bx+a+ε

Здесь ε — случайная ошибка (отклонение, возмущение).

Причины существования случайной ошибки:

1. Невключение в регрессионную модель значимых объясняющих переменных;

2. Агрегирование переменных. Например, функция суммарного потребления – это попытка общего выражения совокупности решений отдельных индивидов о расходах. Это лишь аппроксимация отдельных соотношений, которые имеют разные параметры.

3. Неправильное описание структуры модели;

4. Неправильная функциональная спецификация;

5. Ошибки измерения.

Так как отклонения εi для каждого конкретного наблюдения i – случайны и их значения в выборке неизвестны, то:

1) по наблюдениям xi и yi можно получить только оценки параметров α и β

2) Оценками параметров α и β регрессионной модели являются соответственно величины а и b, которые носят случайный характер, т.к. соответствуют случайной выборке;

Тогда оценочное уравнение регрессии (построенное по выборочным данным) будет иметь вид y = bx + a + ε, где ei – наблюдаемые значения (оценки) ошибок εi, а и b соответственно оценки параметров α и β регрессионной модели, которые следует найти.

Для оценки параметров α и β — используют МНК (метод наименьших квадратов).

Система нормальных уравнений.

Для наших данных система уравнений имеет вид:

10a + 356b = 49

356a + 2135b = 9485

Из первого уравнения выражаем а и подставим во второе уравнение

Получаем b = 68.16, a = 11.17

Уравнение регрессии:

y = 68.16 x — 11.17

1. Параметры уравнения регрессии.

Выборочные средние.

1.1. Коэффициент корреляции

Рассчитываем показатель тесноты связи. Таким показателем является выборочный линейный коэффициент корреляции, который рассчитывается по формуле:

Линейный коэффициент корреляции принимает значения от –1 до +1.

Связи между признаками могут быть слабыми и сильными (тесными). Их критерии оцениваются по шкале Чеддока:

0.1 Y фактором X весьма высокая и прямая.

1.2. Уравнение регрессии (оценка уравнения регрессии).

Линейное уравнение регрессии имеет вид y = 68.16 x -11.17

Коэффициентам уравнения линейной регрессии можно придать экономический смысл. Коэффициент уравнения регрессии показывает, на сколько ед. изменится результат при изменении фактора на 1 ед.

Коэффициент b = 68.16 показывает среднее изменение результативного показателя (в единицах измерения у ) с повышением или понижением величины фактора х на единицу его измерения. В данном примере с увеличением на 1 единицу y повышается в среднем на 68.16.

Коэффициент a = -11.17 формально показывает прогнозируемый уровень у , но только в том случае, если х=0 находится близко с выборочными значениями.

Но если х=0 находится далеко от выборочных значений x , то буквальная интерпретация может привести к неверным результатам, и даже если линия регрессии довольно точно описывает значения наблюдаемой выборки, нет гарантий, что также будет при экстраполяции влево или вправо.

Подставив в уравнение регрессии соответствующие значения x , можно определить выровненные (предсказанные) значения результативного показателя y(x) для каждого наблюдения.

Связь между у и x определяет знак коэффициента регрессии b (если > 0 – прямая связь, иначе — обратная). В нашем примере связь прямая.

1.3. Коэффициент эластичности.

Коэффициенты регрессии (в примере b) нежелательно использовать для непосредственной оценки влияния факторов на результативный признак в том случае, если существует различие единиц измерения результативного показателя у и факторного признака х.

Для этих целей вычисляются коэффициенты эластичности и бета — коэффициенты. Коэффициент эластичности находится по формуле:

Он показывает, на сколько процентов в среднем изменяется результативный признак у при изменении факторного признака х на 1%. Он не учитывает степень колеблемости факторов.

В нашем примере коэффициент эластичности больше 1. Следовательно, при изменении Х на 1%, Y изменится более чем на 1%. Другими словами — Х существенно влияет на Y.

Бета – коэффициент показывает, на какую часть величины своего среднего квадратичного отклонения изменится в среднем значение результативного признака при изменении факторного признака на величину его среднеквадратического отклонения при фиксированном на постоянном уровне значении остальных независимых переменных:

Т.е. увеличение x на величину среднеквадратического отклонения этого показателя приведет к увеличению среднего Y на 0.9796 среднеквадратичного отклонения этого показателя.

1.4. Ошибка аппроксимации.

Оценим качество уравнения регрессии с помощью ошибки абсолютной аппроксимации.

Поскольку ошибка больше 15%, то данное уравнение не желательно использовать в качестве регрессии.

1.6. Коэффициент детерминации.

Квадрат (множественного) коэффициента корреляции называется коэффициентом детерминации, который показывает долю вариации результативного признака, объясненную вариацией факторного признака.

Чаще всего, давая интерпретацию коэффициента детерминации, его выражают в процентах.

R 2 = 0.98 2 = 0.9596, т.е. в 95.96 % случаев изменения x приводят к изменению у . Другими словами — точность подбора уравнения регрессии — высокая. Остальные 4.04 % изменения Y объясняются факторами, не учтенными в модели.

| x | y | x 2 | y 2 | x·y | y(x) | (yi— y ) 2 | (y-y(x)) 2 | (xi— x ) 2 | |y — yx|:y |

| 0.371 | 15.6 | 0.1376 | 243.36 | 5.79 | 14.11 | 780.89 | 2.21 | 0.1864 | 0.0953 |

| 0.399 | 19.9 | 0.1592 | 396.01 | 7.94 | 16.02 | 559.06 | 15.04 | 0.163 | 0.1949 |

| 0.502 | 22.7 | 0.252 | 515.29 | 11.4 | 23.04 | 434.49 | 0.1176 | 0.0905 | 0.0151 |

| 0.572 | 34.2 | 0.3272 | 1169.64 | 19.56 | 27.81 | 87.32 | 40.78 | 0.0533 | 0.1867 |

| 0.607 | 44.5 | .3684 | 1980.25 | 27.01 | 30.2 | 0.9131 | 204.49 | 0.0383 | 0.3214 |

| 0.655 | 26.8 | 0.429 | 718.24 | 17.55 | 33.47 | 280.38 | 44.51 | 0.0218 | 0.2489 |

| 0.763 | 35.7 | 0.5822 | 1274.49 | 27.24 | 40.83 | 61.54 | 26.35 | 0.0016 | 0.1438 |

| 0.873 | 30.6 | 0.7621 | 936.36 | 26.71 | 48.33 | 167.56 | 314.39 | 0.0049 | 0.5794 |

| 2.48 | 161.9 | 6.17 | 26211.61 | 402 | 158.07 | 14008.04 | 14.66 | 2.82 | 0.0236 |

| 7.23 | 391.9 | 9.18 | 33445.25 | 545.2 | 391.9 | 16380.18 | 662.54 | 3.38 | 1.81 |

2. Оценка параметров уравнения регрессии.

2.1. Значимость коэффициента корреляции.

По таблице Стьюдента с уровнем значимости α=0.05 и степенями свободы k=7 находим tкрит:

tкрит = (7;0.05) = 1.895

где m = 1 — количество объясняющих переменных.

Если tнабл > tкритич, то полученное значение коэффициента корреляции признается значимым (нулевая гипотеза, утверждающая равенство нулю коэффициента корреляции, отвергается).

Поскольку tнабл > tкрит, то отклоняем гипотезу о равенстве 0 коэффициента корреляции. Другими словами, коэффициент корреляции статистически — значим

В парной линейной регрессии t 2 r = t 2 b и тогда проверка гипотез о значимости коэффициентов регрессии и корреляции равносильна проверке гипотезы о существенности линейного уравнения регрессии.

2.3. Анализ точности определения оценок коэффициентов регрессии.

Несмещенной оценкой дисперсии возмущений является величина:

S 2 y = 94.6484 — необъясненная дисперсия (мера разброса зависимой переменной вокруг линии регрессии).

Sy = 9.7287 — стандартная ошибка оценки (стандартная ошибка регрессии).

S a — стандартное отклонение случайной величины a.

Sb — стандартное отклонение случайной величины b.

2.4. Доверительные интервалы для зависимой переменной.

Экономическое прогнозирование на основе построенной модели предполагает, что сохраняются ранее существовавшие взаимосвязи переменных и на период упреждения.

Для прогнозирования зависимой переменной результативного признака необходимо знать прогнозные значения всех входящих в модель факторов.

Прогнозные значения факторов подставляют в модель и получают точечные прогнозные оценки изучаемого показателя. (a + bxp ± ε) где

Рассчитаем границы интервала, в котором будет сосредоточено 95% возможных значений Y при неограниченно большом числе наблюдений и X p = 1 (-11.17 + 68.16*1 ± 6.4554)

(50.53;63.44)

С вероятностью 95% можно гарантировать, что значения Y при неограниченно большом числе наблюдений не выйдет за пределы найденных интервалов.

Индивидуальные доверительные интервалы для Y при данном значении X.

(a + bx i ± ε)

где

| xi | y = -11.17 + 68.16xi | εi | ymin | ymax |

| 0.371 | 14.11 | 19.91 | -5.8 | 34.02 |

| 0.399 | 16.02 | 19.85 | -3.83 | 35.87 |

| 0.502 | 23.04 | 19.67 | 3.38 | 42.71 |

| 0.572 | 27.81 | 19.57 | 8.24 | 47.38 |

| 0.607 | 30.2 | 19.53 | 10.67 | 49.73 |

| 0.655 | 33.47 | 19.49 | 13.98 | 52.96 |

| 0.763 | 40.83 | 19.44 | 21.4 | 60.27 |

| 0.873 | 48.33 | 19.45 | 28.88 | 67.78 |

| 2.48 | 158.07 | 25.72 | 132.36 | 183.79 |

С вероятностью 95% можно гарантировать, что значения Y при неограниченно большом числе наблюдений не выйдет за пределы найденных интервалов.

2.5. Проверка гипотез относительно коэффициентов линейного уравнения регрессии.

1) t-статистика. Критерий Стьюдента.

Проверим гипотезу H0 о равенстве отдельных коэффициентов регрессии нулю (при альтернативе H1 не равно) на уровне значимости α=0.05.

tкрит = (7;0.05) = 1.895

Поскольку 12.8866 > 1.895, то статистическая значимость коэффициента регрессии b подтверждается (отвергаем гипотезу о равенстве нулю этого коэффициента).

Поскольку 2.0914 > 1.895, то статистическая значимость коэффициента регрессии a подтверждается (отвергаем гипотезу о равенстве нулю этого коэффициента).

Доверительный интервал для коэффициентов уравнения регрессии.

Определим доверительные интервалы коэффициентов регрессии, которые с надежность 95% будут следующими:

(b — tкрит Sb; b + tкрит Sb)

(68.1618 — 1.895 • 5.2894; 68.1618 + 1.895 • 5.2894)

(58.1385;78.1852)

С вероятностью 95% можно утверждать, что значение данного параметра будут лежать в найденном интервале.

(a — ta)

(-11.1744 — 1.895 • 5.3429; -11.1744 + 1.895 • 5.3429)

(-21.2992;-1.0496)

С вероятностью 95% можно утверждать, что значение данного параметра будут лежать в найденном интервале.

2) F-статистики. Критерий Фишера.

Проверка значимости модели регрессии проводится с использованием F-критерия Фишера, расчетное значение которого находится как отношение дисперсии исходного ряда наблюдений изучаемого показателя и несмещенной оценки дисперсии остаточной последовательности для данной модели.

Если расчетное значение с lang=EN-US>n-m-1) степенями свободы больше табличного при заданном уровне значимости, то модель считается значимой.

где m – число факторов в модели.

Оценка статистической значимости парной линейной регрессии производится по следующему алгоритму:

1. Выдвигается нулевая гипотеза о том, что уравнение в целом статистически незначимо: H0: R 2 =0 на уровне значимости α.

2. Далее определяют фактическое значение F-критерия:

где m=1 для парной регрессии.

3. Табличное значение определяется по таблицам распределения Фишера для заданного уровня значимости, принимая во внимание, что число степеней свободы для общей суммы квадратов (большей дисперсии) равно 1 и число степеней свободы остаточной суммы квадратов (меньшей дисперсии) при линейной регрессии равно n-2.

4. Если фактическое значение F-критерия меньше табличного, то говорят, что нет основания отклонять нулевую гипотезу.

В противном случае, нулевая гипотеза отклоняется и с вероятностью (1-α) принимается альтернативная гипотеза о статистической значимости уравнения в целом.

Табличное значение критерия со степенями свободы k1=1 и k2=7, Fkp = 5.59

Поскольку фактическое значение F > Fkp, то коэффициент детерминации статистически значим (Найденная оценка уравнения регрессии статистически надежна).

Проверка на наличие автокорреляции остатков.

Важной предпосылкой построения качественной регрессионной модели по МНК является независимость значений случайных отклонений от значений отклонений во всех других наблюдениях. Это гарантирует отсутствие коррелированности между любыми отклонениями и, в частности, между соседними отклонениями.

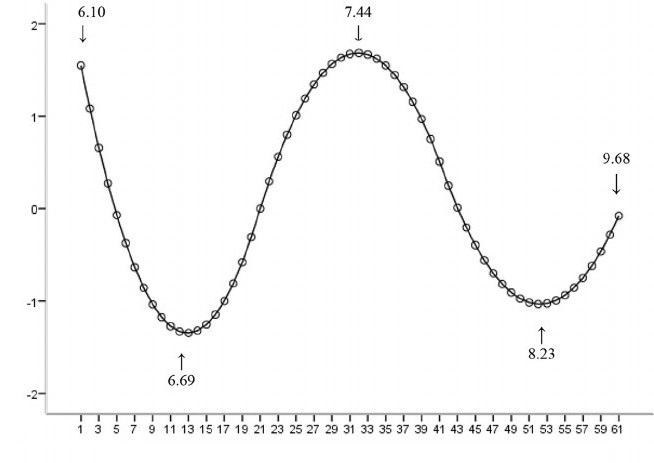

Автокорреляция (последовательная корреляция) определяется как корреляция между наблюдаемыми показателями, упорядоченными во времени (временные ряды) или в пространстве (перекрестные ряды). Автокорреляция остатков (отклонений) обычно встречается в регрессионном анализе при использовании данных временных рядов и очень редко при использовании перекрестных данных.

В экономических задачах значительно чаще встречается положительная автокорреляция, нежели отрицательная автокорреляция. В большинстве случаев положительная автокорреляция вызывается направленным постоянным воздействием некоторых неучтенных в модели факторов.

Отрицательная автокорреляция фактически означает, что за положительным отклонением следует отрицательное и наоборот. Такая ситуация может иметь место, если ту же зависимость между спросом на прохладительные напитки и доходами рассматривать по сезонным данным (зима-лето).

Среди основных причин, вызывающих автокорреляцию, можно выделить следующие:

1. Ошибки спецификации. Неучет в модели какой-либо важной объясняющей переменной либо неправильный выбор формы зависимости обычно приводят к системным отклонениям точек наблюдения от линии регрессии, что может обусловить автокорреляцию.

2. Инерция. Многие экономические показатели (инфляция, безработица, ВНП и т.д.) обладают определенной цикличностью, связанной с волнообразностью деловой активности. Поэтому изменение показателей происходит не мгновенно, а обладает определенной инертностью.

3. Эффект паутины. Во многих производственных и других сферах экономические показатели реагируют на изменение экономических условий с запаздыванием (временным лагом).

4. Сглаживание данных. Зачастую данные по некоторому продолжительному временному периоду получают усреднением данных по составляющим его интервалам. Это может привести к определенному сглаживанию колебаний, которые имелись внутри рассматриваемого периода, что в свою очередь может служить причиной автокорреляции.

Последствия автокорреляции схожи с последствиями гетероскедастичности: выводы по t- и F-статистикам, определяющие значимость коэффициента регрессии и коэффициента детерминации, возможно, будут неверными.

Обнаружение автокорреляции

1. Графический метод

Есть ряд вариантов графического определения автокорреляции. Один из них увязывает отклонения ei с моментами их получения i. При этом по оси абсцисс откладывают либо время получения статистических данных, либо порядковый номер наблюдения, а по оси ординат – отклонения ei (либо оценки отклонений).

Естественно предположить, что если имеется определенная связь между отклонениями, то автокорреляция имеет место. Отсутствие зависимости скоре всего будет свидетельствовать об отсутствии автокорреляции.

Автокорреляция становится более наглядной, если построить график зависимости ei от ei-1.

Регрессионный анализ — статистический метод исследования зависимости случайной величины от переменных

В статистическом моделировании регрессионный анализ представляет собой исследования, применяемые с целью оценки взаимосвязи между переменными. Этот математический метод включает в себя множество других методов для моделирования и анализа нескольких переменных, когда основное внимание уделяется взаимосвязи между зависимой переменной и одной или несколькими независимыми. Говоря более конкретно, регрессионный анализ помогает понять, как меняется типичное значение зависимой переменной, если одна из независимых переменных изменяется, в то время как другие независимые переменные остаются фиксированными.

Во всех случаях целевая оценка является функцией независимых переменных и называется функцией регрессии. В регрессионном анализе также представляет интерес характеристика изменения зависимой переменной как функции регрессии, которая может быть описана с помощью распределения вероятностей.

Задачи регрессионного анализа

Данный статистический метод исследования широко используется для прогнозирования, где его использование имеет существенное преимущество, но иногда это может приводить к иллюзии или ложным отношениям, поэтому рекомендуется аккуратно его использовать в указанном вопросе, поскольку, например, корреляция не означает причинно-следственной связи.

Разработано большое число методов для проведения регрессионного анализа, такие как линейная и обычная регрессии по методу наименьших квадратов, которые являются параметрическими. Их суть в том, что функция регрессии определяется в терминах конечного числа неизвестных параметров, которые оцениваются из данных. Непараметрическая регрессия позволяет ее функции лежать в определенном наборе функций, которые могут быть бесконечномерными.

Как статистический метод исследования, регрессионный анализ на практике зависит от формы процесса генерации данных и от того, как он относится к регрессионному подходу. Так как истинная форма процесса данных, генерирующих, как правило, неизвестное число, регрессионный анализ данных часто зависит в некоторой степени от предположений об этом процессе. Эти предположения иногда проверяемы, если имеется достаточное количество доступных данных. Регрессионные модели часто бывают полезны даже тогда, когда предположения умеренно нарушены, хотя они не могут работать с максимальной эффективностью.

В более узком смысле регрессия может относиться конкретно к оценке непрерывных переменных отклика, в отличие от дискретных переменных отклика, используемых в классификации. Случай непрерывной выходной переменной также называют метрической регрессией, чтобы отличить его от связанных с этим проблем.

История

Самая ранняя форма регрессии — это всем известный метод наименьших квадратов. Он был опубликован Лежандром в 1805 году и Гауссом в 1809. Лежандр и Гаусс применили метод к задаче определения из астрономических наблюдений орбиты тел вокруг Солнца (в основном кометы, но позже и вновь открытые малые планеты). Гаусс опубликовал дальнейшее развитие теории наименьших квадратов в 1821 году, включая вариант теоремы Гаусса-Маркова.

Термин «регресс» придумал Фрэнсис Гальтон в XIX веке, чтобы описать биологическое явление. Суть была в том, что рост потомков от роста предков, как правило, регрессирует вниз к нормальному среднему. Для Гальтона регрессия имела только этот биологический смысл, но позже его работа была продолжена Удни Йолей и Карлом Пирсоном и выведена к более общему статистическому контексту. В работе Йоля и Пирсона совместное распределение переменных отклика и пояснительных считается гауссовым. Это предположение было отвергнуто Фишером в работах 1922 и 1925 годов. Фишер предположил, что условное распределение переменной отклика является гауссовым, но совместное распределение не должны быть таковым. В связи с этим предположение Фишера ближе к формулировке Гаусса 1821 года. До 1970 года иногда уходило до 24 часов, чтобы получить результат регрессионного анализа.

Методы регрессионного анализа продолжают оставаться областью активных исследований. В последние десятилетия новые методы были разработаны для надежной регрессии; регрессии с участием коррелирующих откликов; методы регрессии, вмещающие различные типы недостающих данных; непараметрической регрессии; байесовские методов регрессии; регрессии, в которых переменные прогнозирующих измеряются с ошибкой; регрессии с большей частью предикторов, чем наблюдений, а также причинно-следственных умозаключений с регрессией.

Регрессионные модели

Модели регрессионного анализа включают следующие переменные:

- Неизвестные параметры, обозначенные как бета, которые могут представлять собой скаляр или вектор.

- Независимые переменные, X.

- Зависимые переменные, Y.

В различных областях науки, где осуществляется применение регрессионного анализа, используются различные термины вместо зависимых и независимых переменных, но во всех случаях регрессионная модель относит Y к функции X и β.

Приближение обычно оформляется в виде E (Y | X) = F (X, β). Для проведения регрессионного анализа должен быть определен вид функции f. Реже она основана на знаниях о взаимосвязи между Y и X, которые не полагаются на данные. Если такое знание недоступно, то выбрана гибкая или удобная форма F.

Зависимая переменная Y

Предположим теперь, что вектор неизвестных параметров β имеет длину k. Для выполнения регрессионного анализа пользователь должен предоставить информацию о зависимой переменной Y:

- Если наблюдаются точки N данных вида (Y, X), где N точки к данным. В этом случае имеется достаточно информации в данных, чтобы оценить уникальное значение для β, которое наилучшим образом соответствует данным, и модель регрессии, когда применение к данным можно рассматривать как переопределенную систему в β.

В последнем случае регрессионный анализ предоставляет инструменты для:

- Поиска решения для неизвестных параметров β, которые будут, например, минимизировать расстояние между измеренным и предсказанным значением Y.

- При определенных статистических предположениях, регрессионный анализ использует избыток информации для предоставления статистической информации о неизвестных параметрах β и предсказанные значения зависимой переменной Y.

Необходимое количество независимых измерений

Рассмотрим модель регрессии, которая имеет три неизвестных параметра: β0, β1 и β2. Предположим, что экспериментатор выполняет 10 измерений в одном и том же значении независимой переменной вектора X. В этом случае регрессионный анализ не дает уникальный набор значений. Лучшее, что можно сделать, оценить среднее значение и стандартное отклонение зависимой переменной Y. Аналогичным образом измеряя два различных значениях X, можно получить достаточно данных для регрессии с двумя неизвестными, но не для трех и более неизвестных.

Если измерения экспериментатора проводились при трех различных значениях независимой переменной вектора X, то регрессионный анализ обеспечит уникальный набор оценок для трех неизвестных параметров в β.

В случае общей линейной регрессии приведенное выше утверждение эквивалентно требованию, что матрица X Т X обратима.

Статистические допущения

Когда число измерений N больше, чем число неизвестных параметров k и погрешности измерений εi, то, как правило, распространяется затем избыток информации, содержащейся в измерениях, и используется для статистических прогнозов относительно неизвестных параметров. Этот избыток информации называется степенью свободы регрессии.

Основополагающие допущения

Классические предположения для регрессионного анализа включают в себя:

- Выборка является представителем прогнозирования логического вывода.

- Ошибка является случайной величиной со средним значением нуля, который является условным на объясняющих переменных.

- Независимые переменные измеряются без ошибок.

- В качестве независимых переменных (предикторов) они линейно независимы, то есть не представляется возможным выразить любой предсказатель в виде линейной комбинации остальных.

- Ошибки являются некоррелированными, то есть ковариационная матрица ошибок диагоналей и каждый ненулевой элемент являются дисперсией ошибки.

- Дисперсия ошибки постоянна по наблюдениям (гомоскедастичности). Если нет, то можно использовать метод взвешенных наименьших квадратов или другие методы.

Эти достаточные условия для оценки наименьших квадратов обладают требуемыми свойствами, в частности эти предположения означают, что оценки параметров будут объективными, последовательными и эффективными, в особенности при их учете в классе линейных оценок. Важно отметить, что фактические данные редко удовлетворяют условиям. То есть метод используется, даже если предположения не верны. Вариация из предположений иногда может быть использована в качестве меры, показывающей, насколько эта модель является полезной. Многие из этих допущений могут быть смягчены в более продвинутых методах. Отчеты статистического анализа, как правило, включают в себя анализ тестов по данным выборки и методологии для полезности модели.

Кроме того, переменные в некоторых случаях ссылаются на значения, измеренные в точечных местах. Там могут быть пространственные тенденции и пространственные автокорреляции в переменных, нарушающие статистические предположения. Географическая взвешенная регрессия — единственный метод, который имеет дело с такими данными.

Линейный регрессионный анализ

В линейной регрессии особенностью является то, что зависимая переменная, которой является Yi, представляет собой линейную комбинацию параметров. Например, в простой линейной регрессии для моделирования n-точек используется одна независимая переменная, xi, и два параметра, β0 и β1.

При множественной линейной регрессии существует несколько независимых переменных или их функций.

При случайной выборке из популяции ее параметры позволяют получить образец модели линейной регрессии.

В данном аспекте популярнейшим является метод наименьших квадратов. С помощью него получают оценки параметров, которые минимизируют сумму квадратов остатков. Такого рода минимизация (что характерно именно линейной регрессии) этой функции приводит к набору нормальных уравнений и набору линейных уравнений с параметрами, которые решаются с получением оценок параметров.

При дальнейшем предположении, что ошибка популяции обычно распространяется, исследователь может использовать эти оценки стандартных ошибок для создания доверительных интервалов и проведения проверки гипотез о ее параметрах.

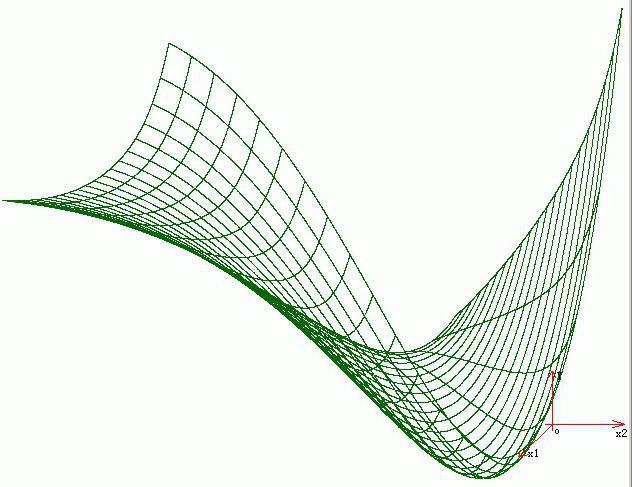

Нелинейный регрессионный анализ

Пример, когда функция не является линейной относительно параметров, указывает на то, что сумма квадратов должна быть сведена к минимуму с помощью итерационной процедуры. Это вносит много осложнений, которые определяют различия между линейными и нелинейными методами наименьших квадратов. Следовательно, и результаты регрессионного анализа при использовании нелинейного метода порой непредсказуемы.

Расчет мощности и объема выборки

Здесь, как правило, нет согласованных методов, касающихся числа наблюдений по сравнению с числом независимых переменных в модели. Первое правило было предложено Доброй и Хардином и выглядит как N = t^n, где N является размер выборки, n — число независимых переменных, а t есть числом наблюдений, необходимых для достижения желаемой точности, если модель имела только одну независимую переменную. Например, исследователь строит модель линейной регрессии с использованием набора данных, который содержит 1000 пациентов (N). Если исследователь решает, что необходимо пять наблюдений, чтобы точно определить прямую (м), то максимальное число независимых переменных, которые модель может поддерживать, равно 4.

Другие методы

Несмотря на то что параметры регрессионной модели, как правило, оцениваются с использованием метода наименьших квадратов, существуют и другие методы, которые используются гораздо реже. К примеру, это следующие методы:

- Байесовские методы (например, байесовский метод линейной регрессии).

- Процентная регрессия, использующаяся для ситуаций, когда снижение процентных ошибок считается более целесообразным.

- Наименьшие абсолютные отклонения, что является более устойчивым в присутствии выбросов, приводящих к квантильной регрессии.

- Непараметрическая регрессия, требующая большого количества наблюдений и вычислений.

- Расстояние метрики обучения, которая изучается в поисках значимого расстояния метрики в заданном входном пространстве.

Программное обеспечение

Все основные статистические пакеты программного обеспечения выполняются с помощью наименьших квадратов регрессионного анализа. Простая линейная регрессия и множественный регрессионный анализ могут быть использованы в некоторых приложениях электронных таблиц, а также на некоторых калькуляторах. Хотя многие статистические пакеты программного обеспечения могут выполнять различные типы непараметрической и надежной регрессии, эти методы менее стандартизированы; различные программные пакеты реализуют различные методы. Специализированное регрессионное программное обеспечение было разработано для использования в таких областях как анализ обследования и нейровизуализации.

http://math.semestr.ru/corel/primer.php

http://businessman.ru/new-regressionnyj-analiz-statisticheskij-metod-issledovaniya-zavisimosti-sluchajnoj-velichiny-ot-peremennyx.html