R — значит регрессия

Статистика в последнее время получила мощную PR поддержку со стороны более новых и шумных дисциплин — Машинного Обучения и Больших Данных. Тем, кто стремится оседлать эту волну необходимо подружится с уравнениями регрессии. Желательно при этом не только усвоить 2-3 приемчика и сдать экзамен, а уметь решать проблемы из повседневной жизни: найти зависимость между переменными, а в идеале — уметь отличить сигнал от шума.

Для этой цели мы будем использовать язык программирования и среду разработки R, который как нельзя лучше приспособлен к таким задачам. Заодно, проверим от чего зависят рейтинг Хабрапоста на статистике собственных статей.

Введение в регрессионный анализ

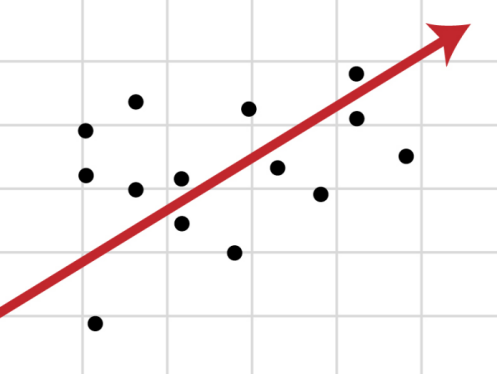

Если имеется корреляционная зависимость между переменными y и x , возникает необходимость определить функциональную связь между двумя величинами. Зависимость среднего значения

называется регрессией y по x .

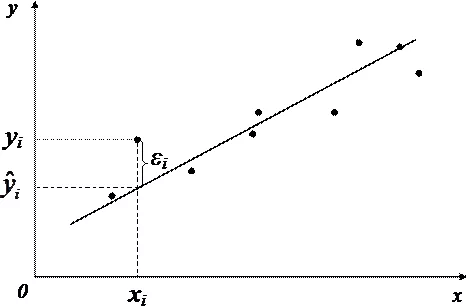

Основу регрессионного анализа составляет метод наименьших квадратов (МНК), в соответствии с которым в качестве уравнения регресии берется функция такая, что сумма квадратов разностей

минимальна.

Карл Гаусс открыл, или точнее воссоздал, МНК в возрасте 18 лет, однако впервые результаты были опубликованы Лежандром в 1805 г. По непроверенным данным метод был известен еще в древнем Китае, откуда он перекочевал в Японию и только затем попал в Европу. Европейцы не стали делать из этого секрета и успешно запустили в производство, обнаружив с его помощью траекторию карликовой планеты Церес в 1801 г.

Вид функции , как правило, определен заранее, а с помощью МНК подбираются оптимальные значения неизвестных параметров. Метрикой рассеяния значений

вокруг регрессии

является дисперсия.

- k — число коэффициентов в системе уравнений регрессии.

Чаще всего используется модель линейной регрессии, а все нелинейные зависимости приводят к линейному виду с помощью алгебраических ухищрений, различных преобразования переменных y и x .

Линейная регрессия

Уравнения линейной регрессии можно записать в виде

В матричном виде это выгладит

- y — зависимая переменная;

- x — независимая переменная;

- β — коэффициенты, которые необходимо найти с помощью МНК;

- ε — погрешность, необъяснимая ошибка и отклонение от линейной зависимости;

Случайная величина может быть интерпретирована как сумма из двух слагаемых:

— полная дисперсия (TSS).

— объясненная часть дисперсии (ESS).

— остаточная часть дисперсии (RSS).

Еще одно ключевое понятие — коэффициент корреляции R 2 .

Ограничения линейной регрессии

Для того, чтобы использовать модель линейной регрессии необходимы некоторые допущения относительно распределения и свойств переменных.

- Линейность, собственно. Увеличение, или уменьшение вектора независимых переменных в k раз, приводит к изменению зависимой переменной также в k раз.

- Матрица коэффициентов обладает полным рангом, то есть векторы независимых переменных линейно независимы.

- Экзогенность независимых переменных —

. Это требование означает, что математическое ожидание погрешности никоим образом нельзя объяснить с помощью независимых переменных.

- Однородность дисперсии и отсутствие автокорреляции. Каждая εi обладает одинаковой и конечной дисперсией σ 2 и не коррелирует с другой εi. Это ощутимо ограничивает применимость модели линейной регрессии, необходимо удостовериться в том, что условия соблюдены, иначе обнаруженная взаимосвязь переменных будет неверно интерпретирована.

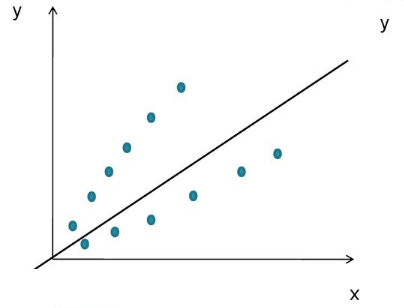

Как обнаружить, что перечисленные выше условия не соблюдены? Ну, во первых довольно часто это видно невооруженным глазом на графике.

Неоднородность дисперсии

При возрастании дисперсии с ростом независимой переменной имеем график в форме воронки.

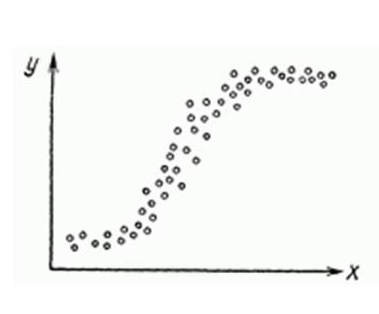

Нелинейную регрессии в некоторых случая также модно увидеть на графике довольно наглядно.

Тем не менее есть и вполне строгие формальные способы определить соблюдены ли условия линейной регрессии, или нарушены.

- Автокорреляция проверяется статистикой Дарбина-Уотсона (0 ≤ d ≤ 4). Если автокорреляции нет, то значения критерия d≈2, при позитивной автокорреляции d≈0, при отрицательной — d≈4.

- Неоднородность дисперсии — Тест Уайта,

, при

\chi<^2>_<\alpha;m-1>$» data-tex=»inline»/> нулевая гипотеза отвергается и констатируется наличие неоднородной дисперсии. Используя ту же

можно еще применить тест Бройша-Пагана.

- Мультиколлинеарность — нарушения условия об отсутствии взаимной линейной зависимости между независимыми переменными. Для проверки часто используют VIF-ы (Variance Inflation Factor).

В этой формуле — коэффициент взаимной детерминации между

и остальными факторами. Если хотя бы один из VIF-ов > 10, вполне резонно предположить наличие мультиколлинеарности.

Почему нам так важно соблюдение всех выше перечисленных условий? Все дело в Теореме Гаусса-Маркова, согласно которой оценка МНК является точной и эффективной лишь при соблюдении этих ограничений.

Как преодолеть эти ограничения

Нарушения одной или нескольких ограничений еще не приговор.

- Нелинейность регрессии может быть преодолена преобразованием переменных, например через функцию натурального логарифма ln .

- Таким же способом возможно решить проблему неоднородной дисперсии, с помощью ln , или sqrt преобразований зависимой переменной, либо же используя взвешенный МНК.

- Для устранения проблемы мультиколлинеарности применяется метод исключения переменных. Суть его в том, что высоко коррелированные объясняющие переменные устраняются из регрессии, и она заново оценивается. Критерием отбора переменных, подлежащих исключению, является коэффициент корреляции. Есть еще один способ решения данной проблемы, который заключается в замене переменных, которым присуща мультиколлинеарность, их линейной комбинацией. Этим весь список не исчерпывается, есть еще пошаговая регрессия и другие методы.

К сожалению, не все нарушения условий и дефекты линейной регрессии можно устранить с помощью натурального логарифма. Если имеет место автокорреляция возмущений к примеру, то лучше отступить на шаг назад и построить новую и лучшую модель.

Линейная регрессия плюсов на Хабре

Итак, довольно теоретического багажа и можно строить саму модель.

Мне давно было любопытно от чего зависит та самая зелененькая цифра, что указывает на рейтинг поста на Хабре. Собрав всю доступную статистику собственных постов, я решил прогнать ее через модель линейно регрессии.

Загружает данные из tsv файла.

- points — Рейтинг статьи

- reads — Число просмотров.

- comm — Число комментариев.

- faves — Добавлено в закладки.

- fb — Поделились в социальных сетях (fb + vk).

- bytes — Длина в байтах.

Вопреки моим ожиданиям наибольшая отдача не от количества просмотров статьи, а от комментариев и публикаций в социальных сетях. Я также полагал, что число просмотров и комментариев будет иметь более сильную корреляцию, однако зависимость вполне умеренная — нет надобности исключать ни одну из независимых переменных.

Теперь собственно сама модель, используем функцию lm .

В первой строке мы задаем параметры линейной регрессии. Строка points

. определяет зависимую переменную points и все остальные переменные в качестве регрессоров. Можно определить одну единственную независимую переменную через points

reads , набор переменных — points

Перейдем теперь к расшифровке полученных результатов.

- Intercept — Если у нас модель представлена в виде

, то тогда

— точка пересечения прямой с осью координат, или intercept .

- R-squared — Коэффициент детерминации указывает насколько тесной является связь между факторами регрессии и зависимой переменной, это соотношение объясненных сумм квадратов возмущений, к необъясненным. Чем ближе к 1, тем ярче выражена зависимость.

- Adjusted R-squared — Проблема с

в том, что он по любому растет с числом факторов, поэтому высокое значение данного коэффициента может быть обманчивым, когда в модели присутствует множество факторов. Для того, чтобы изъять из коэффициента корреляции данное свойство был придуман скорректированный коэффициент детерминации .

- F-statistic — Используется для оценки значимости модели регрессии в целом, является соотношением объяснимой дисперсии, к необъяснимой. Если модель линейной регрессии построена удачно, то она объясняет значительную часть дисперсии, оставляя в знаменателе малую часть. Чем больше значение параметра — тем лучше.

- t value — Критерий, основанный на t распределении Стьюдента . Значение параметра в линейной регрессии указывает на значимость фактора, принято считать, что при t > 2 фактор является значимым для модели.

- p value — Это вероятность истинности нуль гипотезы, которая гласит, что независимые переменные не объясняют динамику зависимой переменной. Если значение p value ниже порогового уровня (.05 или .01 для самых взыскательных), то нуль гипотеза ложная. Чем ниже — тем лучше.

Можно попытаться несколько улучшить модель, сглаживая нелинейные факторы: комментарии и посты в социальных сетях. Заменим значения переменных fb и comm их степенями.

Проверим значения параметров линейной регрессии.

Как видим в целом отзывчивость модели возросла, параметры подтянулись и стали более шелковистыми , F-статистика выросла, так же как и скорректированный коэффициент детерминации .

Проверим, соблюдены ли условия применимости модели линейной регрессии? Тест Дарбина-Уотсона проверяет наличие автокорреляции возмущений.

И напоследок проверка неоднородности дисперсии с помощью теста Бройша-Пагана.

В заключение

Конечно наша модель линейной регрессии рейтинга Хабра-топиков получилось не самой удачной. Нам удалось объяснить не более, чем половину вариативности данных. Факторы надо чинить, чтобы избавляться от неоднородной дисперсии, с автокорреляцией тоже непонятно. Вообще данных маловато для сколь-нибудь серьезной оценки.

Но с другой стороны, это и хорошо. Иначе любой наспех написанный тролль-пост на Хабре автоматически набирал бы высокий рейтинг, а это к счастью не так.

Регрессионный анализ в Microsoft Excel

Регрессионный анализ является одним из самых востребованных методов статистического исследования. С его помощью можно установить степень влияния независимых величин на зависимую переменную. В функционале Microsoft Excel имеются инструменты, предназначенные для проведения подобного вида анализа. Давайте разберем, что они собой представляют и как ими пользоваться.

Подключение пакета анализа

Но, для того, чтобы использовать функцию, позволяющую провести регрессионный анализ, прежде всего, нужно активировать Пакет анализа. Только тогда необходимые для этой процедуры инструменты появятся на ленте Эксель.

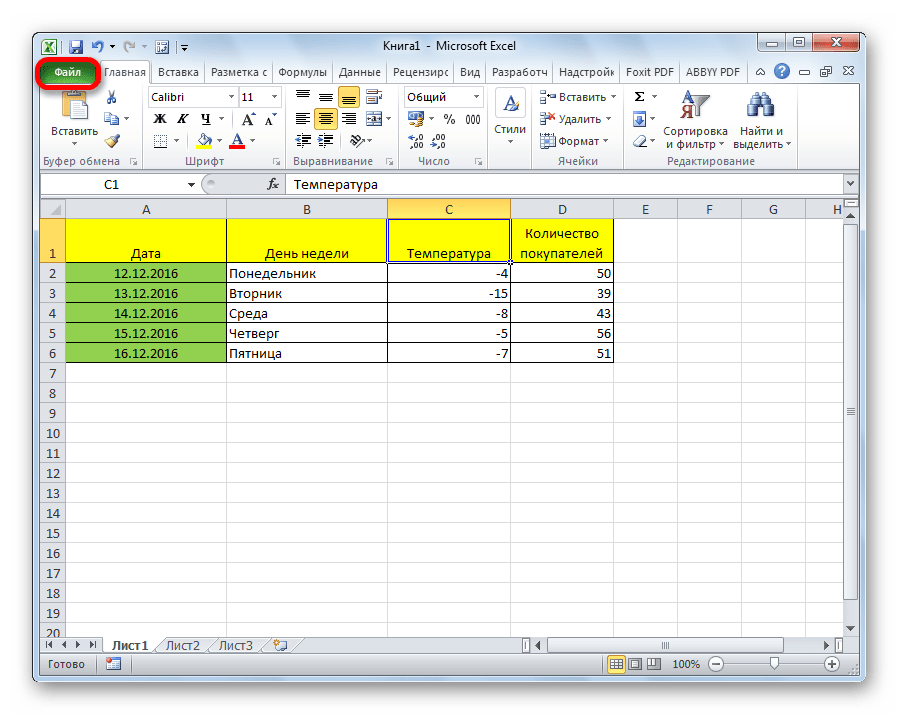

- Перемещаемся во вкладку «Файл».

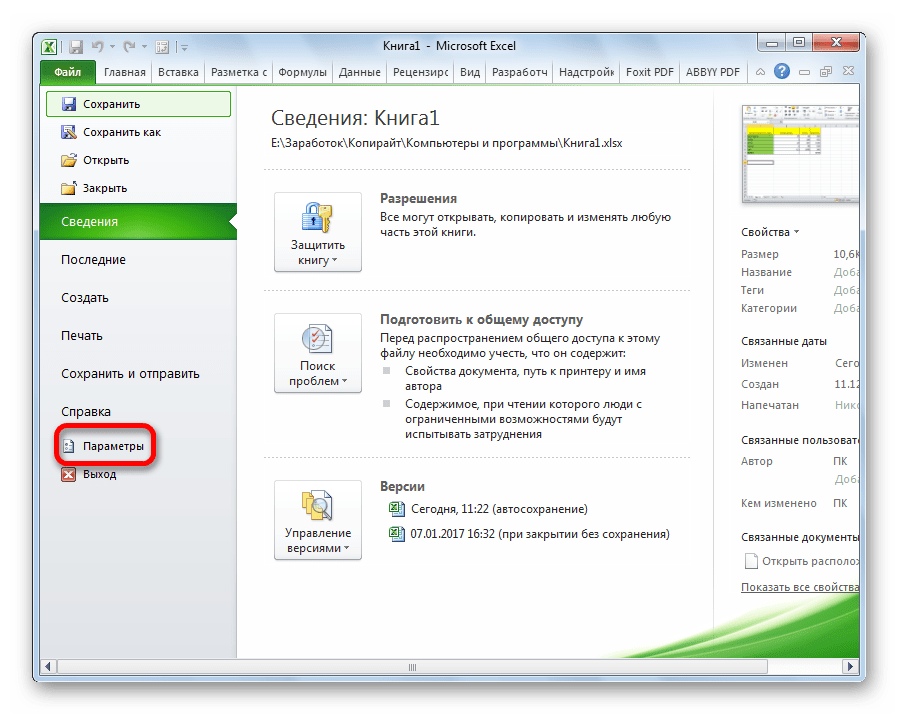

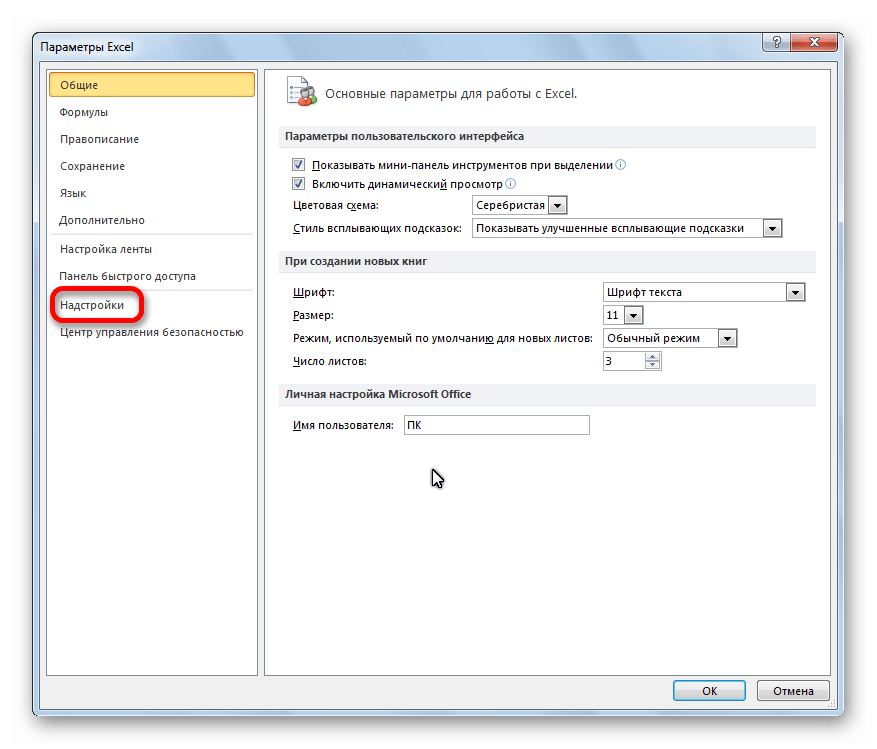

Открывается окно параметров Excel. Переходим в подраздел «Надстройки».

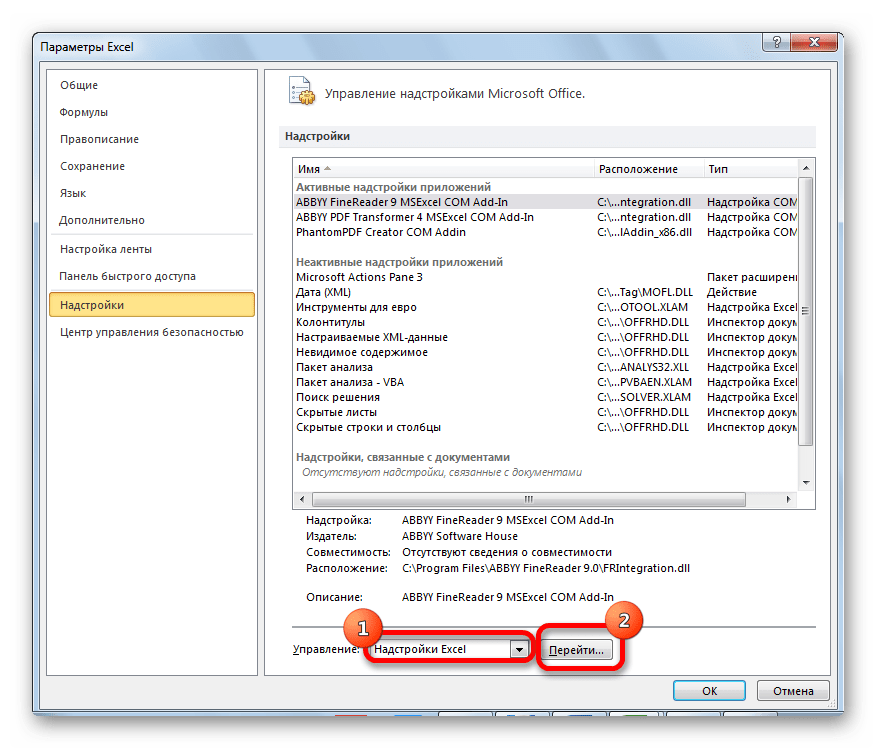

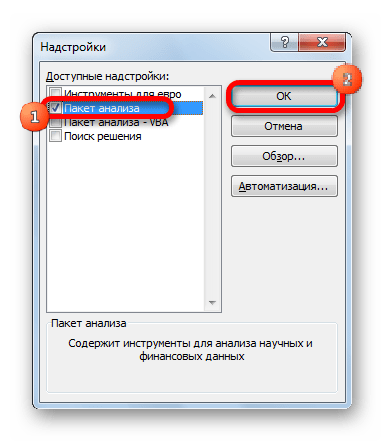

В самой нижней части открывшегося окна переставляем переключатель в блоке «Управление» в позицию «Надстройки Excel», если он находится в другом положении. Жмем на кнопку «Перейти».

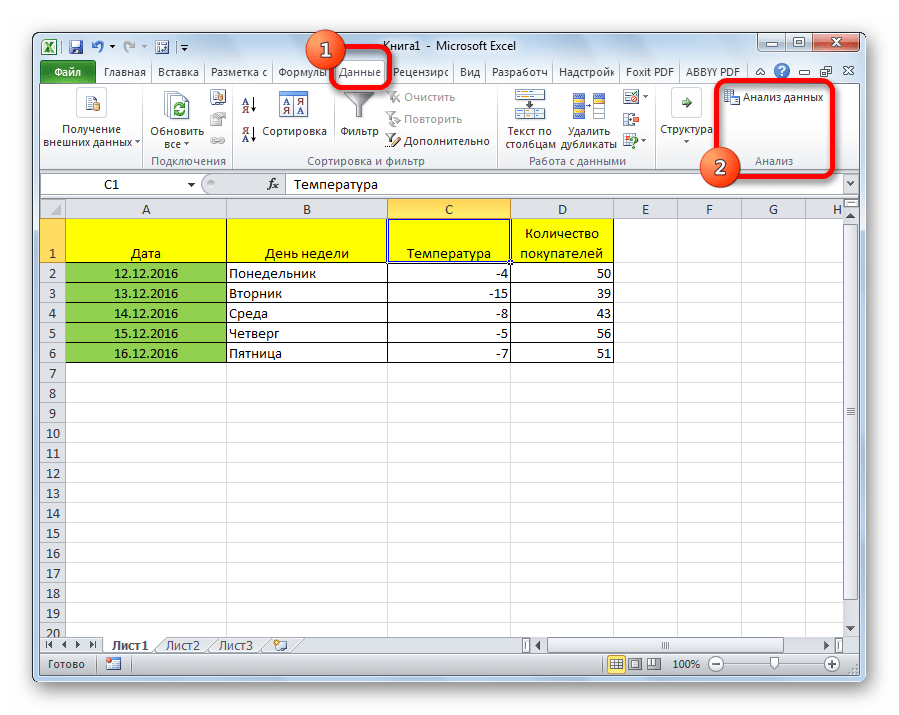

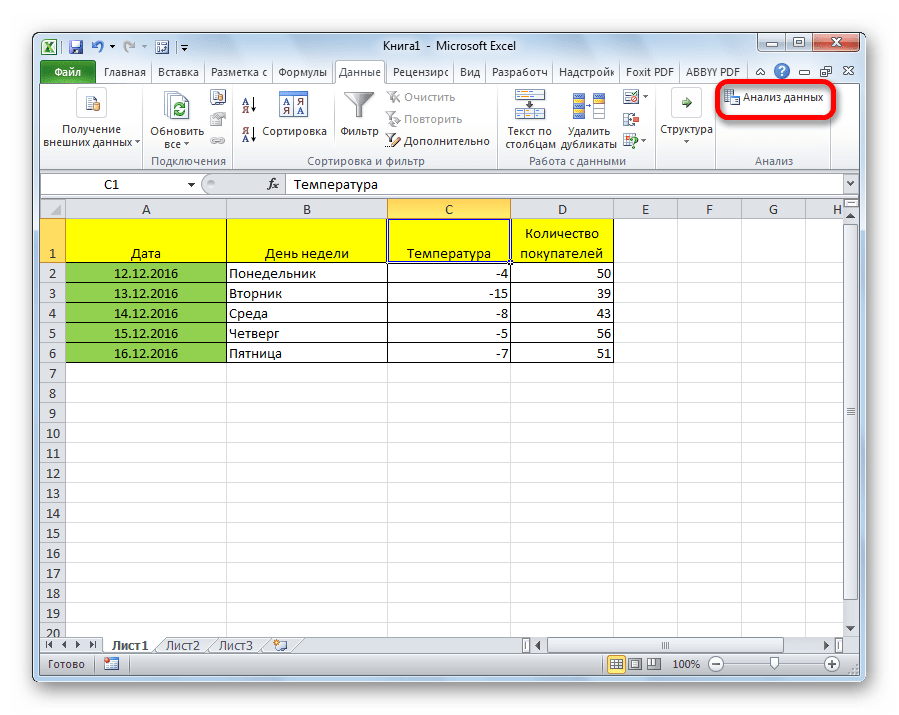

Теперь, когда мы перейдем во вкладку «Данные», на ленте в блоке инструментов «Анализ» мы увидим новую кнопку – «Анализ данных».

Виды регрессионного анализа

Существует несколько видов регрессий:

- параболическая;

- степенная;

- логарифмическая;

- экспоненциальная;

- показательная;

- гиперболическая;

- линейная регрессия.

О выполнении последнего вида регрессионного анализа в Экселе мы подробнее поговорим далее.

Линейная регрессия в программе Excel

Внизу, в качестве примера, представлена таблица, в которой указана среднесуточная температура воздуха на улице, и количество покупателей магазина за соответствующий рабочий день. Давайте выясним при помощи регрессионного анализа, как именно погодные условия в виде температуры воздуха могут повлиять на посещаемость торгового заведения.

Общее уравнение регрессии линейного вида выглядит следующим образом: У = а0 + а1х1 +…+акхк . В этой формуле Y означает переменную, влияние факторов на которую мы пытаемся изучить. В нашем случае, это количество покупателей. Значение x – это различные факторы, влияющие на переменную. Параметры a являются коэффициентами регрессии. То есть, именно они определяют значимость того или иного фактора. Индекс k обозначает общее количество этих самых факторов.

- Кликаем по кнопке «Анализ данных». Она размещена во вкладке «Главная» в блоке инструментов «Анализ».

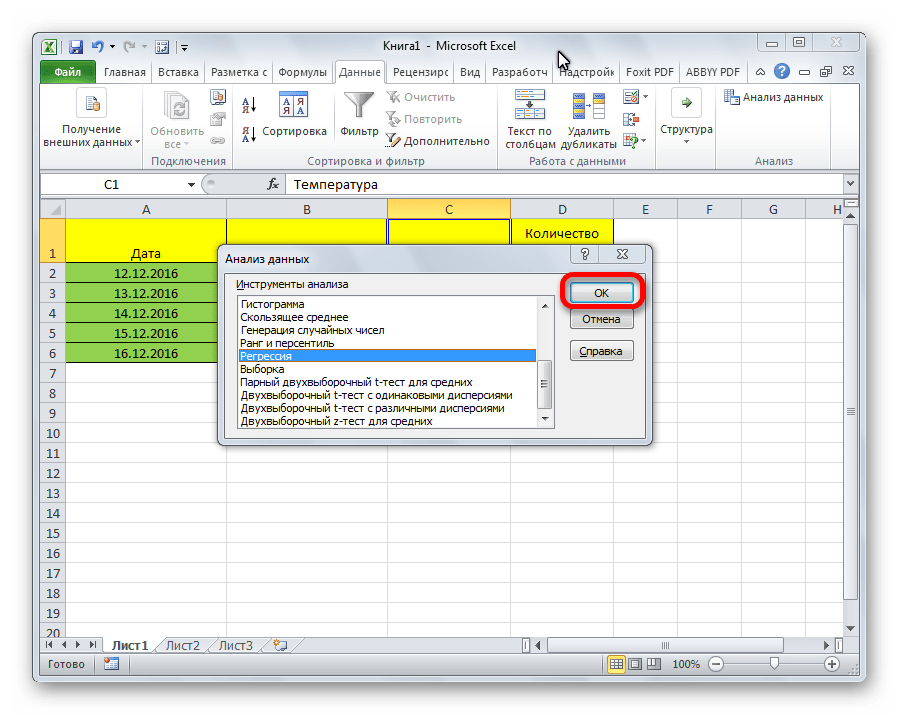

Открывается небольшое окошко. В нём выбираем пункт «Регрессия». Жмем на кнопку «OK».

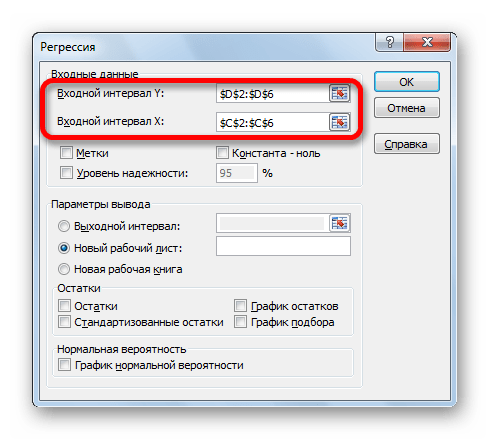

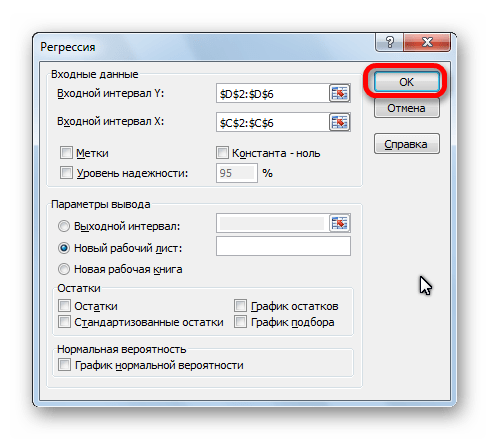

Открывается окно настроек регрессии. В нём обязательными для заполнения полями являются «Входной интервал Y» и «Входной интервал X». Все остальные настройки можно оставить по умолчанию.

В поле «Входной интервал Y» указываем адрес диапазона ячеек, где расположены переменные данные, влияние факторов на которые мы пытаемся установить. В нашем случае это будут ячейки столбца «Количество покупателей». Адрес можно вписать вручную с клавиатуры, а можно, просто выделить требуемый столбец. Последний вариант намного проще и удобнее.

В поле «Входной интервал X» вводим адрес диапазона ячеек, где находятся данные того фактора, влияние которого на переменную мы хотим установить. Как говорилось выше, нам нужно установить влияние температуры на количество покупателей магазина, а поэтому вводим адрес ячеек в столбце «Температура». Это можно сделать теми же способами, что и в поле «Количество покупателей».

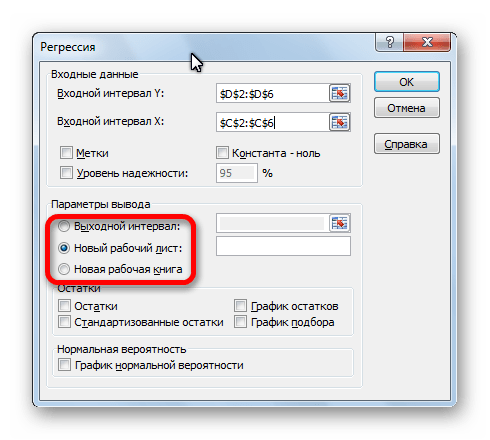

С помощью других настроек можно установить метки, уровень надёжности, константу-ноль, отобразить график нормальной вероятности, и выполнить другие действия. Но, в большинстве случаев, эти настройки изменять не нужно. Единственное на что следует обратить внимание, так это на параметры вывода. По умолчанию вывод результатов анализа осуществляется на другом листе, но переставив переключатель, вы можете установить вывод в указанном диапазоне на том же листе, где расположена таблица с исходными данными, или в отдельной книге, то есть в новом файле.

После того, как все настройки установлены, жмем на кнопку «OK».

Разбор результатов анализа

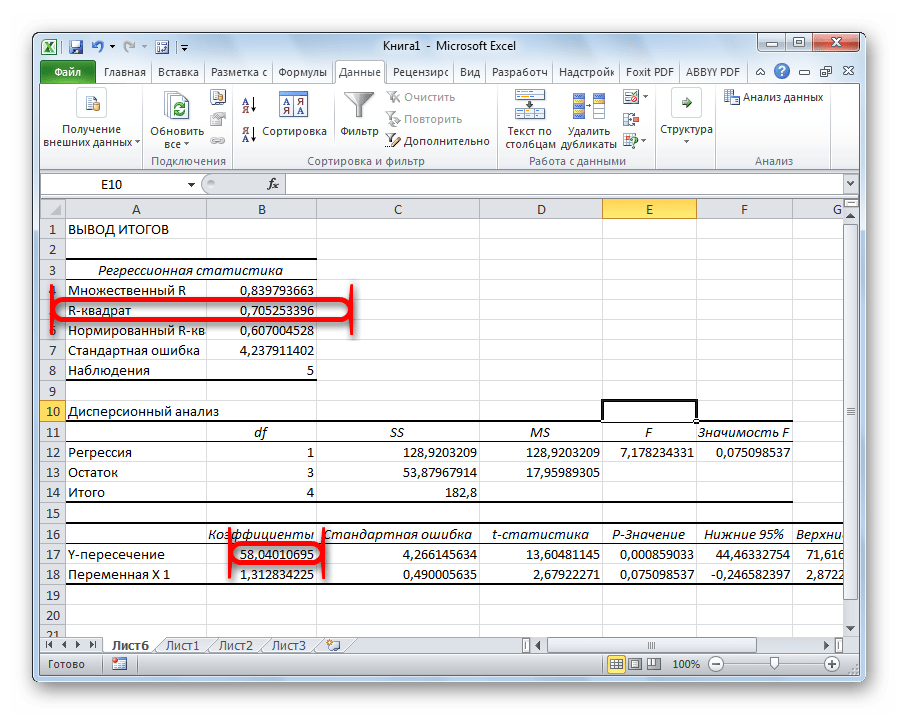

Результаты регрессионного анализа выводятся в виде таблицы в том месте, которое указано в настройках.

Одним из основных показателей является R-квадрат. В нем указывается качество модели. В нашем случае данный коэффициент равен 0,705 или около 70,5%. Это приемлемый уровень качества. Зависимость менее 0,5 является плохой.

Ещё один важный показатель расположен в ячейке на пересечении строки «Y-пересечение» и столбца «Коэффициенты». Тут указывается какое значение будет у Y, а в нашем случае, это количество покупателей, при всех остальных факторах равных нулю. В этой таблице данное значение равно 58,04.

Значение на пересечении граф «Переменная X1» и «Коэффициенты» показывает уровень зависимости Y от X. В нашем случае — это уровень зависимости количества клиентов магазина от температуры. Коэффициент 1,31 считается довольно высоким показателем влияния.

Как видим, с помощью программы Microsoft Excel довольно просто составить таблицу регрессионного анализа. Но, работать с полученными на выходе данными, и понимать их суть, сможет только подготовленный человек.

Помимо этой статьи, на сайте еще 12698 инструкций.

Добавьте сайт Lumpics.ru в закладки (CTRL+D) и мы точно еще пригодимся вам.

Отблагодарите автора, поделитесь статьей в социальных сетях.

Регрессионный анализ

Методы корреляционного анализа, позволяющего решать задачи определения тесноты и направления связи, существующей между изучаемыми величинами. Регрессионный анализ представляет собой следующий этап статистического анализа и позволяет предсказать значения случайной величины на основании значений одной или нескольких независимых случайных величин. Достижение этой цели оказывается возможным за счет определения вида аналитического выражения, описывающего связь зависимой случайной величины Y (которую в этом случае называют результативным признаком) с независимыми случайными величинами Х1 ,Х2 , . Хm (которые называют факторами).

Основной задачей регрессионного анализа является установление формы линии регрессии и изучение зависимости между переменными. Основной задачей корреляционного анализа — выявление связи между случайными переменными и оценка ее тесноты.

Форма связи результативного признака Y с факторами Х1 ,Х2 , . Хm называется уравнением регрессии. В зависимости от типа выбранного уравнения различают линейную и нелинейную регрессию (например, квадратичную, логарифмическую, экспоненциальную и т. д.).

Регрессия может быть парная (простая) и множественная, что определяется числом взаимосвязанных признаков. Если исследуется связь между двумя признаками (результативным и факторным), то регрессия называется парной (простой); к этому типу относится, например, исследование зависимости между продажами и затратами на рекламу. Если исследуется связь между тремя и более признаками, то регрессия называется множественной (многофакторной) — например, если исследуется связь между уровнем потребления, доходом, финансовым состоянием и размером семьи.

На этапе регрессионного анализа решаются следующие основные задачи.

1. Выбор общего вида уравнения регрессии и определение параметров регрессии.

2. Определение в регрессии степени взаимосвязи результативного признака и факторов, проверка общего качества уравнения регрессии.

3. Проверка статистической значимости каждого коэффициента уравнения регрессии и определение их доверительных интервалов.

Простая линейная регрессия

Выбор общего вида уравнения регрессии является важной задачей, поскольку форма связи выявляет механизм получения значений зависимой случайной переменной Y. Форма связи может быть линейной или нелинейной. Линейная связь описывается линейным уравнением. Уравнение простой линейной регрессии имеет вид:

График этой функции называется линией регрессии. Линия регрессии точнее всего отражает распределение экспериментальных значений на диаграмме рассеяния, а угол ее наклона характеризует степень зависимости между двумя переменными.

Параметры уравнения регрессии могут быть определены с помощью метода наименьших квадратов (именно этот метод и используется в Microsoft Excel). При определении параметров модели методом наименьших квадратов минимизируется сумма квадратов остатков.

Для нахождения оценок параметров b0 и b1 доставляющих минимум функции Qocm, вычисляются и приравниваются к нулю частные производные этой функции, откуда система нормальных уравнении принимает следующий вид:

После простых преобразований имеем:

Тогда коэффициент наклона прямой регрессии равен:

а свободный член регрессии:

Для свободного члена последнее равенство можно переписать следующим образом:

откуда

Отсюда следует, что для определения линии регрессии достаточно знать лишь ее коэффициент наклона b1. Равенство для b1. можно упростить, если использовать найденное значение выборочного коэффициента корреляции г:

где

Из последнего выражения для b1, ясно виден общий смысл коэффициента корреляции: чем меньше г, тем ближе линия регрессии к горизонтальному положению, т. е. тем ближе будут средние значения уi,- к состоянию неизменяемости.

Для анализа общего качества уравнения линейной регрессии используется обычно коэффициент детерминации R2, который получается посредством простого возведения в квадрат коэффициента корреляции. Коэффициент детерминации показывает, в какой мере изменчивость величины Y объясняется поведением величины X. Например, если коэффициент корреляции совокупных данных, относящихся к производственным затратам, равняется 0,8, то коэффициент детерминации R2 = 0,82 = 0,64 или 64%. Это значение говорит о том, что 64% вариации (изменчивости) недельных затрат объясняется количеством изделий, выпущенных за неделю. Остальная часть (36%) вариации общих затрат объясняется другими причинами.

Так как в большинстве случаев уравнение регрессии приходится строить на основе выборочных данных, то возникает вопрос об адекватности построения уравнения данным генеральной совокупности. Для этого проводится проверка статистической значимости коэффициента детерминации R2 на основе F-критерия Фишера:

где n — число наблюдений, a m — число факторов в уравнении регрессии.

В математической статистике доказывается, что если гипотеза Н0: R2 = 0 выполняется, то величина F имеет F-распределение с k = m и l=п-ш-1 степенями свободы, т. е.

Гипотеза Н0: R2 = 0 о незначимости коэффициента детерминации R2 отвергается, если FP > Fкр, а принимается альтернативная гипотеза — о значимости R2 .При значениях

Возможна ситуация, когда часть вычисленных коэффициентов регрессии не обладает необходимой степенью значимости, т. е. значения данных коэффициентов будут меньше их стандартной ошибки. В этом случае такие коэффициенты должны быть исключены из уравнения регрессии. Поэтому проверка адекватности построенного уравнения регрессии наряду с проверкой значимости коэффициента детерминации R2 включает в себя также и проверку значимости каждого коэффициента регрессии.

Значимость коэффициентов регрессии проверяется с помощью t-критерия Стьюдента:

где

В математической статистике доказывается, что если гипотеза

1 степенями свободы, т. е.

Гипотеза Н0: Ь1 = 0 о незначимости коэффициента регрессии отвергается, если │tp│> │tкр│, а принимается альтернативная о значимости Ь1. Кроме того, зная значение tкр можно найти границы доверительных интервалов для коэффициентов регрессии.

Пусть имеется корреляционное поле производства пшеницы (обозначено точками на графике) для 50-ти сельхоз предприятий. Здесь Y-годовой сбор пшеницы, X-площади посевов.

Регрессионный анализ позволяет определить аналитическое выражение для уравнения линии регрессии оценить значимость коэффициентов этого уравнения.

Задача. На рис. 2 представлены данные о суточном объеме производства и количестве занятых работников для некоторой совокупности дней. По представленным данным необходимо определить параметры уравнения линейной регрессии и выполнить его анализ.

Для расчета параметров уравнения линейной регрессии и проверки его адекватности исследуемому процессу, Microsoft Excel располагает функцией Регрессия. Для вызова этой функций необходимо выбрать команду меню Сервис→Анализ данных (Tools→Data Analysis). На экране раскроется диалоговое окно Анализ данных (Data Analysis), в котором следует выбрать значение Regression, в результате чего на экране появится диалоговое окно Regression, представленное на рис. 1

В диалоговом окне Regression задаются следующие параметры.

1. В поле Input Y Range (Входные данные У) вводится диапазон ячеек, содержащих исходные данные по результативному признаку. Диапазон должен состоять из одного столбца.

2. В поле Input X Range (Входные данные X) вводится диапазон ячеек, содержащих исходные данные факторного признака. Максимальное число входных диапазонов (столбцов) равно 16.

3. Флажок опции Labels (Метки) устанавливается в том случае, если первая строка/столбец во входном диапазоне содержит заголовок. Если заголовок отсутствует, этот флажок следует сбросить. В последнем случае для данных выходного диапазона будут автоматически созданы стандартные названия.

4. Флажок опции Confidence Level (Уровень надежности) устанавливается в том случае, если в расположенное рядом с флажком поле необходимо ввести уровень надежности, отличный от уровня 95%, применяемого по умолчанию. Установленный в данном поле уровень надежности используется для проверки значимости коэффициента детерминации и коэффициентов регрессии. Если данный флажок опции сброшен, в таблице параметров уравнения регрессии генерируются две одинаковые пары столбцов для границ доверительных интервалов.

5. Флажок опции Константа — нуль (Constant is Zero) устанавливается в том случае, когда требуется, чтобы линия регрессии прошла через начало координат (т. е. Ь0 = 0).

6. Переключатель в группе Output options (Режимы вывода) может быть установлен в одно из трех положений, определяющих, где должны быть размещены результаты расчета: Output Range (Выходной интервал), New Worksheet Ply (Новый рабочий лист) или New Workbook (Новая рабочая книга).

7. Флажок опции Residuals (Остатки) устанавливается в том случае, если в диапазон ячеек с выходными данными требуется включить столбец остатков.

8. Флажок опции Standardized Residuals (Стандартизованные остатки) устанавливается в том случае, если в диапазон ячеек с выходными данными требуется включить столбец стандартизованных остатков.

9. Флажок опции Residual Plots (График остатков) должен быть установлен, если на рабочий лист требуется вывести точечные графики зависимости остатков от факторных признаков xt.

10. Флажок опции Line Fit Plots (График подбора) должен быть установлен, если на рабочий лист требуется вывести точечные графики зависимости теоретических результативных значений у от факторных признаков х.

11. Флажок опции Normal Probability Plots (График вероятности нормального распределения) должен быть установлен, если на рабочий лист требуется вывести точечный график зависимости наблюдаемых значений у от автоматически формируемых интервалов персентелей.

Результаты решения данной задачи с помощью функции Regression представлены на рисунках 3-7.

На рисунке 3 представлены результаты расчета регрессионной статистики. Эти результаты соответствуют следующим статистическим показателям:

• Множественный R — коэффициент корреляции R;

• R-квадрат — коэффициент детерминации R2 (квадрат коэффициента корреляции);

• Нормированный R — нормированное значение коэффициента корреляции; •Стандартная ошибка — стандартное отклонение для остатков;

• Наблюдения — это число исходных наблюдений.

На рисунке 4 представлены результаты дисперсионного анализа, которые используются для проверки значимости коэффициента детерминации R2.

Значения в столбцах на рисунке. 4 имеют следующую интерпретацию.

• Столбец df — это число степеней свободы. Для строки Регрессия число степеней свободы определяется количеством факторных признаков m, для строки Остаток — числом наблюдений n и количеством переменных в уравнении регрессии m+1: п -(m + 1), а для строки Итого — суммой степеней свободы для строк Регрессия и Остаток и, следовательно, равно п — 1.

• Столбец SS — это сумма квадратов отклонений. Для строки Регрессия значение определяется как сумма квадратов отклонений теоретических данных от среднего:

Для строки Остаток это сумма квадратов отклонений эмпирических данных от теоретических:

•Для строки Итого это сумма квадратов отклонений эмпирических данных от среднего:

• Столбец MS содержит значения дисперсии, которые рассчитываются по формуле:

Для строки Регрессия это факторная дисперсия

•Для строки Остаток это остаточная дисперсия

• Столбец F содержит расчетное значение F-критерия Фишера Fp вычисляемое по формуле:

• Столбец Значимость F содержит значение уровня значимости, соответствующее вычисленному значению Fр.

На рисунке 5 представлены полученные значения коэффициентов регрессии Ь1, и их статистические оценки.

Столбцы на рисунке 5 содержат следующие значения.

• Стандартная ошибка — стандартные ошибки коэффициентов Ь1 и и b0 .

Погрешность линейного коэффициента уравнения равная 7,44 и ошибка свободного члена равная 59,5 вполне приемлемы по отношению к величинам данных коэффициентов. уравнения 23 статистически велика, так как превосходит значение свободного члена. Поэтому ошибки не должны значительно влиять на эффективность описания входных данных полученным регрессионным уравнением.

• t-статистика — расчетные значения t-критерия, вычисляемые по формуле:

Чем больше отличается от нуля величина t-статистики, тем статистически лучше.

• Р-значение — значения уровней значимости, соответствующие вычисленным значениям tp . Оно характеризует насколько стандартную погрешность можно считать статистически значимой

• Нижние 95% и Верхние 95% — нижние и верхние границы доверительных интервалов для коэффициентов регрессии Ь1. и b0.

На рисунке 6 представлены теоретические значения

Наконец, на рисунке 7 показаны вычисленные интервалы перцентилей и соответствующие им эмпирические значения у.

Перцентили — это характеристики набора данных, которые выражают ранги элементов в виде процентов от 0 до 100%, а не в виде чисел от 1 до n, таким образом, что наименьшему значению соответствует нулевой перцентиль, наибольшему — 100-й, медиане — 50-й и т. д.

Перцентили можно рассматривать как показатели, разбивающие наборы количественных и порядковых данных на определенные части. Например, 70-й перцентиль эффективности продаж может быть равен 60

Под рангом (R) понимают номер (порядковое место) значения случайной величины в наборе данных

Переходя к анализу полученных расчетных данных, можно построить уравнение регрессии с вычисленными коэффициентами, которое будет выражать зависимость объема производства от количества работников.

Значение множественного коэффициента детерминации R2= 0,79 (рис. 10.3) показывает, что 79% общей вариации результативного признака объясняется вариацией факторного признака X. Значит, выбранный фактор существенно влияет на объем производства, что подтверждает правильность включения его в построенную модель.

Рассчитанный уровень значимости (показатель Значимость F на рисунке 4)

Проверка значимости коэффициента детерминации R2 и коэффициентов регрессии Ь0 и b1, при факторном признаке подтверждает адекватность полученного уравнения.

http://lumpics.ru/regression-analysis-in-excel/

http://pandia.ru/text/78/208/79466.php