Регрессия: понятие, виды и уравнение

Содержание статьи:

- Уравнение регрессии

- Линейное уравнение

- Нелинейное уравнение

- Виды регрессии

- Парная регрессия

- Множественная регрессия

Регрессия. Многие из нас слышали это слово, но немногие знают, что же это такое на самом деле. Попробуем разобраться. Регрессия — это зависимость между определёнными переменными, с помощью которой можно спрогнозировать будущее поведение данных переменных. Причём, под переменными подразумеваются всевозможные периодические явления вплоть до человеческого поведения.

Уравнение регрессии

Зачастую, регрессия подаётся в виде простого уравнения, которое раскрывает зависимость и силу связи между двумя группами числовых переменных, одна из которых называется зависимой (эндогенной), а вторая — независимой (экзогенной или фактором). Если есть группа взаимосвязанных показателей, то зависимая переменная выбирается логическими размышлениями, а остальные выступают независимыми. То есть, если у нас есть расстояние между городами и затраты на путешествие, то вполне ясно, что затраты будут зависеть от расстояния. Уравнения бывают двух видов: линейные и нелинейные (это уже чистая математика). Стоит рассмотреть каждый из видов.

Линейное уравнение

Линейное уравнение иллюстрирует строго линейную связь между переменными, то есть в нём отсутствуют степени, дроби, тригонометрические функции. Решается стандартными математическими способами.

Нелинейное уравнение

Логично предположить, что в нелинейный класс уравнений входит всё то, что не вошло в линейный. Решаются такие уравнения сведением к линейному типу, а дальше – по накатанной дорожке.

Виды регрессии

Регрессия бывает двух видов: парная (линейная и нелинейная) и множественная (линейная и нелинейная). Разница между ними в виде уравнения и количестве независимых переменных. Логично, что парная регрессия — это когда одна зависимая переменная и одна независимая, в множественной — независимых переменных несколько. В природе имеет место исключительно множественная регрессия, так как нельзя ограничить внешнее влияние на какое-то явление строго одним фактором. Рассмотрим оба вида регрессий детальнее.

Парная регрессия

Парная (её ещё называют двухфакторной) модель проста в использовании, так как у нас всего две переменные: эндогенная и экзогенная, а значит будет просто решить уравнение и провести анализ. А это значит, что и применять на практике такую модель очень легко.

Множественная регрессия

Множественная (многофакторная) модель намного сложнее, так как мы имеем уравнение с большим количеством переменных, для решения которого существуют определённые математические способы (метод наименьших квадратов например).

Итоги

Немного разобравшись в этой теме, приходишь к выводу, что регрессия очень необходимое понятие, помогающее предугадать поведение многих явлений. Его используют в экономике, психологии, химии, биологии, метеорологии и во многих других науках, причём существует множество программ, которые проводят все необходимые расчёты автоматически и сами выводят результаты и графики для анализа. Пользователю остаётся только считать результаты и правильно расшифровать их. А уж найти им применение вообще не проблема. Поэтому, я считаю, что необходимо иметь хотя бы малейшее понятие о том, что же такое эта пресловутая регрессия и где её использовать.

Видео про линейную регрессию и корреляцию:

5 видов регрессии и их свойства

Линейная и логистическая регрессии обычно являются первыми видами регрессии, которые изучают в таких областях, как машинное обучение и наука о данных. Оба метода считаются эффективными, так как их легко понять и использовать. Однако, такая простота также имеет несколько недостатков, и во многих случаях лучше выбирать другую регрессионную модель. Существует множество видов регрессии, каждый из которых имеет свои достоинства и недостатки.

Мы познакомимся с 7 наиболее распространенными алгоритмами регрессии и опишем их свойства. Также мы узнаем, в каких ситуация и с какими видами данных лучше использовать тот или иной алгоритм. В конце мы расскажем о некоторых инструментах для построения регрессии и поможем лучше разобраться в регрессионных моделях в целом!

Линейная регрессия

Регрессия — это метод, используемый для моделирования и анализа отношений между переменными, а также для того, чтобы увидеть, как эти переменные вместе влияют на получение определенного результата. Линейная регрессия относится к такому виду регрессионной модели, который состоит из взаимосвязанных переменных. Начнем с простого. Парная (простая) линейная регрессия — это модель, позволяющая моделировать взаимосвязь между значениями одной входной независимой и одной выходной зависимой переменными с помощью линейной модели, например, прямой.

Более распространенной моделью является множественная линейная регрессия, которая предполагает установление линейной зависимости между множеством входных независимых и одной выходной зависимой переменных. Такая модель остается линейной по той причине, что выход является линейной комбинацией входных переменных. Мы можем построить модель множественной линейной регрессии следующим образом:

Y = a_1*X_1 + a_2*X_2 + a_3*X_3 ……. a_n*X_n + b

Где a_n — это коэффициенты, X_n — переменные и b — смещение . Как видим, данная функция не содержит нелинейных коэффициентов и, таким образом, подходит только для моделирования линейных сепарабельных данных. Все очень просто: мы взвешиваем значение каждой переменной X_n с помощью весового коэффициента a_n. Данные весовые коэффициенты a_n, а также смещение b вычисляются с применением стохастического градиентного спуска. Посмотрите на график ниже в качестве иллюстрации!

Несколько важных пунктов о линейной регрессии:

- Она легко моделируется и является особенно полезной при создании не очень сложной зависимости, а также при небольшом количестве данных.

- Обозначения интуитивно-понятны.

- Чувствительна к выбросам.

Полиномиальная регрессия

Для создания такой модели, которая подойдет для нелинейно разделяемых данных, можно использовать полиномиальную регрессию. В данном методе проводится кривая линия, зависимая от точек плоскости. В полиномиальной регрессии степень некоторых независимых переменных превышает 1. Например, получится что-то подобное:

Y = a_1*X_1 + (a_2)²*X_2 + (a_3)⁴*X_3 ……. a_n*X_n + b

У некоторых переменных есть степень, у других — нет. Также можно выбрать определенную степень для каждой переменной, но для этого необходимы определенные знания о том, как входные данные связаны с выходными. Сравните линейную и полиномиальную регрессии ниже.

Несколько важных пунктов о полиномиальной регрессии:

- Моделирует нелинейно разделенные данные (чего не может линейная регрессия). Она более гибкая и может моделировать сложные взаимосвязи.

- Полный контроль над моделированием переменных объекта (выбор степени).

- Необходимо внимательно создавать модель. Необходимо обладать некоторыми знаниями о данных, для выбора наиболее подходящей степени.

- При неправильном выборе степени, данная модель может быть перенасыщена.

Гребневая (ридж) регрессия

В случае высокой коллинеарности переменных стандартная линейная и полиномиальная регрессии становятся неэффективными. Коллинеарность — это отношение независимых переменных, близкое к линейному. Наличие высокой коллинеарности можно определить несколькими путями:

- Коэффициент регрессии не важен, несмотря на то, что, теоретически, переменная должна иметь высокую корреляцию с Y.

- При добавлении или удалении переменной из матрицы X, коэффициент регрессии сильно изменяется.

- Переменные матрицы X имеют высокие попарные корреляции (посмотрите корреляционную матрицу).

Сначала можно посмотреть на функцию оптимизации стандартной линейной регрессии для лучшего понимания того, как может помочь гребневая регрессия:

Где X — это матрица переменных, w — веса, y — достоверные данные. Гребневая регрессия — это корректирующая мера для снижения коллинеарности среди предикторных переменных в регрессионной модели. Коллинеарность — это явление, в котором одна переменная во множественной регрессионной модели может быть предсказано линейно, исходя из остальных свойств со значительной степенью точности. Таким образом, из-за высокой корреляции переменных, конечная регрессионная модель сведена к минимальным пределам приближенного значения, то есть она обладает высокой дисперсией.

Гребневая регрессия добавляет небольшой фактор квадратичного смещения для уменьшения дисперсии:

min || Xw — y ||² + z|| w ||²

Такой фактор смещения выводит коэффициенты переменных из строгих ограничений, вводя в модель небольшое смещение, но при этом значительно снижая дисперсию.

Несколько важных пунктов о гребневой регрессии:

- Допущения данной регрессии такие же, как и в методе наименьших квадратов, кроме того факта, что нормальное распределение в гребневой регрессии не предполагается.

- Это уменьшает значение коэффициентов, оставляя их ненулевыми, что предполагает отсутствие отбора признаков.

Регрессия по методу «лассо»

В регрессии лассо, как и в гребневой, мы добавляем условие смещения в функцию оптимизации для того, чтобы уменьшить коллинеарность и, следовательно, дисперсию модели. Но вместо квадратичного смещения, мы используем смещение абсолютного значения:

min || Xw — y ||² + z|| w ||

Существует несколько различий между гребневой регрессией и лассо, которые восстанавливают различия в свойствах регуляризаций L2 и L1:

- Встроенный отбор признаков — считается полезным свойством, которое есть в норме L1, но отсутствует в норме L2. Отбор признаков является результатом нормы L1, которая производит разреженные коэффициенты. Например, предположим, что модель имеет 100 коэффициентов, но лишь 10 из них имеют коэффициенты отличные от нуля. Соответственно, «остальные 90 предикторов являются бесполезными в прогнозировании искомого значения». Норма L2 производит неразряженные коэффициенты и не может производить отбор признаков. Таким образом, можно сказать, что регрессия лассо производит «выбор параметров», так как не выбранные переменные будут иметь общий вес, равный 0.

- Разряженность означает, что незначительное количество входных данных в матрице (или векторе) имеют значение, отличное от нуля. Норма L1 производит большое количество коэффициентов с нулевым значением или очень малые значения с некоторыми большими коэффициентами. Это связано с предыдущим пунктом, в котором указано, что лассо исполняет выбор свойств.

- Вычислительная эффективность: норма L1 не имеет аналитического решения в отличие от нормы L2. Это позволяет эффективно вычислять решения нормы L2. Однако, решения нормы L1 не обладают свойствами разряженности, что позволяет использовать их с разряженными алгоритмами для более эффективных вычислений.

Регрессия «эластичная сеть»

Эластичная сеть — это гибрид методов регрессии лассо и гребневой регрессии. Она использует как L1, так и L2 регуляризации, учитывая эффективность обоих методов.

min || Xw — y ||² + z_1|| w || + z_2|| w ||²

Практическим преимуществом использования регрессии лассо и гребневой регрессии является то, что это позволяет эластичной сети наследовать некоторую стабильность гребневой регрессии при вращении.

Несколько важных пунктов о регрессии эластичной сети:

- Она создает условия для группового эффекта при высокой корреляции переменных, а не обнуляет некоторые из них, как метод лассо.

- Нет ограничений по количеству выбранных переменных.

Вывод

Вот и все! 5 распространенных видов регрессии и их свойства. Все данные методы регуляризации регрессии (лассо, гребневая и эластичной сети) хорошо функционирует при высокой размерности и мультиколлинеарности среди переменных в наборе данных.

Интерпретация уравнения регрессии

Интерпретация уравнения регрессии

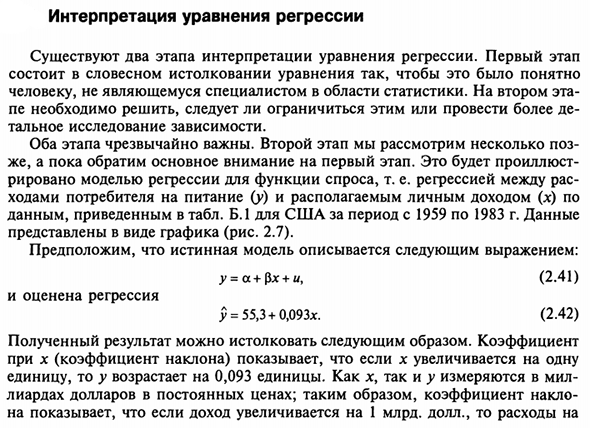

- Интерпретация регрессионных уравнений Существует два этапа интерпретации уравнения регрессии. Первый этап Уточнить, потому что уравнения интерпретируются устно Тот, кто не является статистиком. Во вторых это Нет необходимости решать, делать это или больше. Тщательное исследование зависимости. Оба этапа очень важны.

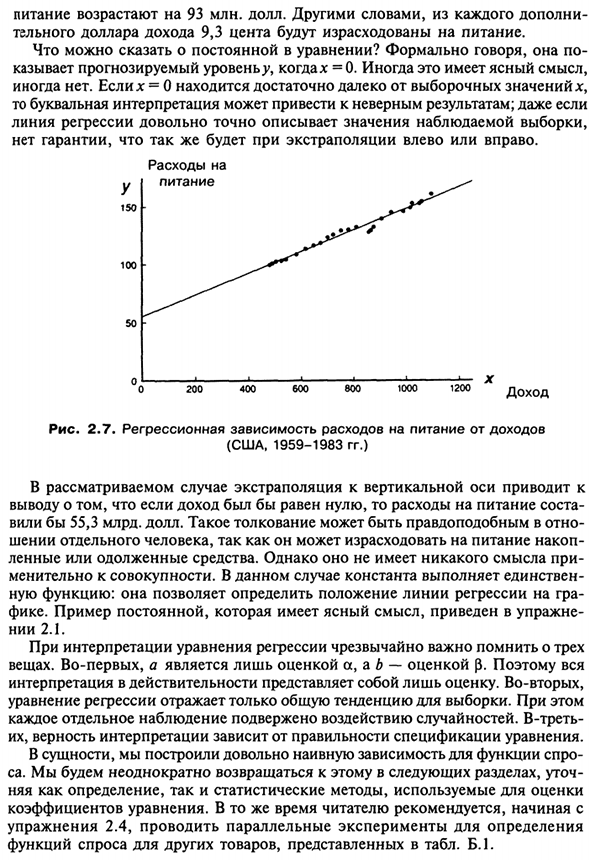

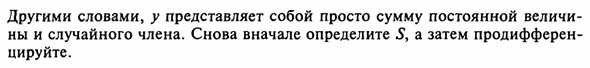

- На втором этапе мы рассмотрим несколько поз А пока давайте обратим основное внимание на первый этап. Это объясняет Определяется регрессионной моделью функции спроса, то есть регрессией между расами Потребители переходят на еду (у) и располагаемый личный доход (х) Данные Отображается в графическом формате (рисунок 2.7). Предположим, что истинная модель описывается y = a + $ x + u, (2,41) И регрессионная оценка £ = 55,3 + 0,093 *. (2,42)

Данные приведены в таблице. Б.1 в США за период с 1959 по 1983 год. Людмила Фирмаль

Полученные результаты можно интерпретировать следующим образом: коэффициент в х (коэффициент градиента) Единица у увеличивается на 0,093 единицы. х и у оба измеряются в мил Миллиарды долларов по фиксированной цене. Поэтому склон Если выручка увеличится на 1 миллиард долларов, 64 Питательные вещества увеличились на 93 миллиона долларов.

Это значит Из реальных долларовых доходов 9,3 цента тратятся на еду. Как насчет констант уравнения? Формально она Если x = 0, указывает уровень прогнозирования ^. Это ясно имеет смысл. Иногда нет. Если х = 0 достаточно далеко от значения выборки х, В этом случае буквальная интерпретация может привести к неверным результатам.

Даже если Линия регрессии является очень точным представлением наблюдаемого значения выборки. Нет гарантии, что то же самое произойдет с экстраполяцией влево или вправо. в 150 грамм 100 грамм 50 Стоимость пища 200 400 600 800 —100 • ”0 120—0 X доходов Рисунок 2.7. Зависимость расходов на питание от дохода (США, 1959-1983).

В рассматриваемом случае путем экстраполяции на вертикальную ось Если доход равен нулю, стоимость еды Сделал бы 55,3 миллиарда долларов. Такое толкование может быть правдоподобным в отношении Лица, которые могут тратить накопления пищи Кредиты или заемные средства. Тем не менее, это не имеет смысла, если По отношению ко всему.

В этом случае константа сделает единственное Функция: может определить положение линии регрессии на графике Поддельный. Примеры констант с ясным значением приведены в упражнении. Институт 2.1. При интерпретации уравнений регрессии очень важно помнить три Вещь. Во-первых, a является только оценкой a, а a b является оценкой (3. Интерпретация на самом деле просто оценка.

Во-вторых Уравнение регрессии отражает только общую тенденцию выборки. В то же время Индивидуальные наблюдения подвержены случайности. третий В этих случаях точность интерпретации зависит от точности спецификации уравнения. По сути, мы построили довольно простую зависимость от функции спроса Мы вернемся к этому в следующем разделе и уточнить.

- Определяя как определения, так и статистические методы, используемые при измерении Коэффициент уравнения. В то же время читателям рекомендуется начать с Упражнение 2.4, определить путем проведения параллельных экспериментов Функция спроса на другие товары приведена в таблице. B.1. После оценки регрессии возникают следующие вопросы:

Есть ли способ определить точность оценки? Это очень важно Рост будет обсуждаться в следующем разделе. Сначала рассмотрим дальше Подробно объясните роль остаточного члена и его влияние на оценки a и p. Интерпретация уравнений линейной регрессии.

Представьте себе простой способ интерпретации линейных коэффициентов. Людмила Фирмаль

Уравнение регрессии у = а + бх Если есть простая естественная единичная переменная Измерение. Сначала увеличим х на 1 единицу ( Единица переменной х) увеличивается у в б (единица переменной у). Второй этап Проверка того, что собой представляет хна на самом деле, Замените слово «единица измерения» на фактическое количество.

Третий этап Проверка возможности более простого выражения результата Это может быть не очень удобно. В примере В этом разделе указана единица измерения для х и у Потому что миллиарды долларов были потрачены, Замечательное упрощение. Константа а дает предсказанное значение у (единица ^). х = 0 Это может иметь или не иметь смысла в зависимости от значения Конкретная ситуация. Упражнение 1 2.1.

Регрессия стоимости продуктов питания (на основе того же Данные, для которых уже описана функция спроса, описанная в тексте) Меню определено как f = 1 в 1959 году, t = 2 в 1960 году и т. Д. Нини: у = 95,3 + 2,53 /. Интерпретация в Сравнение результатов оценки регрессии с аналогом Аналогичные результаты для модели регрессии функции спроса Пожалуйста, смотрите текст.

В этом случае постоянная Есть простая интерпретация. 2.2. Регрессивная зависимость от одноразовой зависимости стоимости жилья 1 Упражнение 2.4 особенно важно в том смысле, что оно запускает серию регрессий для развлечения. Общий спрос. Это оценивается читателем на протяжении всей книги.

Если это упражнение Если это делается группой студентов, учитель должен дать студентам задания Товарные. Более подробная информация о доступных данных доступна в Приложении B.go Личный доход в соответствии с таблицей. B.1, оба количества Можно оформить миллиарды долларов с 1959 по 1983 В следующем формате: j> = -27,6 + 0,178х.

Регрессивная зависимость и определение стоимости жилья с течением времени То же самое, что и упражнение 2.1, можно выразить как: f = 48,9 + 4,84 г. Вот экономическая интерпретация этих регрессий. У них разные предложения Описание тех же данных в переменной y. Сколько они Вы можете согласиться? 2,3.

Создайте уравнение регрессии между p и e из данных упражнения 1.3, сначала используйте все 12 наблюдений, затем исключите наблюдения 1. Дает экономическую интерпретацию для Японии. 2,4. В таблице. B.1 — потребительские расходы США располагаемый личный доход за период 1959-1983 гг. Назовите один продукт — не еду, а не домашнюю Пропустите регрессию между y и x. х — располагаемый личный доход, использующий Данные за 25 лет.

Интерпретация коэффициентов регрессии 2.5. Таким образом, регрессия между характеристиками продукта и временем Мы сделаем это в упражнении 2.1. Правильная интерпретация и сравнение У нее есть интерпретация регрессии, полученная в упражнении 2.4. 2.6. Два человека строят один и тот же набор временных тенденций 25 наблюдений за переменной y с использованием модели: у = а + р / + и

Где t — время (принимает значения непрерывно от 1 до 25), а -case Член чаепития. Получите первое уравнение: j> = 6,70 + 1,79 /. Вторая по ошибке оценивает регрессию между / и у и этим уравнением По мнению: t = -0,25 + 0,44 >>. Из этого уравнения он получает: у = 0,57 + 2,27 /. Объясните это уравнение и несоответствие между уравнениями, Получено первым исследователем. 2,7.

Как изменяется регрессионный балл в упражнении 2.1 Фактическая дата (1959-1983) используется как / вместо числа из 1 до 25? 2,8. Исследователи, 1 Не начинайте сначала вычислять коэффициент регрессии. Заполнены большинство арифметических расчетов в упражнении 1.3. 2 Учителя являются учениками, если это групповое занятие.

Удар, чтобы дать задачу оценки регрессии различных видов товаров в дополнение к еде жилья.люги, основанные на данных АМЕ (у) и общем располагаемом личном доходе (х) Риканская экономика (обе измеряются в миллиардах долларов) Фиксированная цена) с использованием данных и модели временных рядов за год: y = a + px + u. 1.

Исследователь выполняет регрессионный анализ, чтобы получить уравнение. Используйте обычный метод наименьших квадратов. Если предположить, что Обе ценности могут быть значительно недооценены внутренней системой Личные счета за желание людей не платить налоги Правительство, исследователи принимают два альтернативных улучшения Недооцененная оценка. 2.

Исследователи добавляют $ 90 млрд к показателю каждый год >> и Показатель х 200 миллиардов долларов. 3. Исследователь увеличивает x и y на 10% Каждый год. Оценить влияние корректировок (2) и (3) на результаты рег. ressii. 2.9. Исследователи имеют общие годовые данные временных рядов.

Заработная плата (W), валовой доход (P) и валовой доход (Y) Для страны сроком на n лет. По определению Y = W + T1. Получите регулярное уравнение, используя метод наименьших квадратов Рссии: fr = a0 + aiY; ft = Z> 0 + bxY. Указывает, что коэффициент регрессии автоматически удовлетворяет Следующее уравнение: но х + * я = 1; * o + K = 0. Интуитивно объясните, почему так должно быть. 2.10.

Исследователи не имеют нестохастической части истинной модели у пропорционально х. y = $ x + u. Исходя из исходного принципа, выведите формулу b, оценка МНК б. В этом случае (2.31) указывает, что это можно записать следующим образом. S = bj] + b2J, xj -2 £ Xx,. > 7 Для этого b = 2, xiyi / Zxf. 2,11. Выведите оценку наименьших квадратов модели из первого предположения. у = а + у. 68 То есть у это просто сумма констант Случайные участники с нами. Сначала переопределите 5, а затем дифференцируйте Цитирование.

Образовательный сайт для студентов и школьников

Копирование материалов сайта возможно только с указанием активной ссылки «www.lfirmal.com» в качестве источника.

© Фирмаль Людмила Анатольевна — официальный сайт преподавателя математического факультета Дальневосточного государственного физико-технического института

http://nuancesprog.ru/p/2922/

http://lfirmal.com/interpretaciya-uravneniya-regressii/