уравнения множественной регрессии

Построение уравнения множественной регрессии начинается с решения вопроса о спецификации модели. Он включает в себя два круга вопросов: отбор факторов и выбор вида уравнения регрессии.

Включение в уравнение множественной регрессии того или иного набора факторов связано прежде всего с представлением исследователя о природе взаимосвязи моделируемого показателя с другими экономическими явлениями. Факторы, включаемые во множественную регрессию, должны отвечать следующим требованиям.

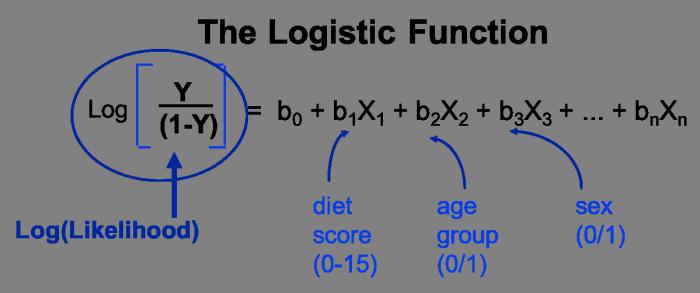

1. Они должны быть количественно измеримы. Если необходимо включить в модель качественный фактор, не имеющий количественного измерения, то ему нужно придать количественную определенность.

2. Факторы не должны быть интеркоррелированы и тем более находиться в точной функциональной связи.

Включение в модель факторов с высокой интеркорреляцией, может привести к нежелательным последствиям – система нормальных уравнений может оказаться плохо обусловленной и повлечь за собой неустойчивость и ненадежность оценок коэффициентов регрессии.

Если между факторами существует высокая корреляция, то нельзя определить их изолированное влияние на результативный показатель и параметры уравнения регрессии оказываются неинтерпретируемыми.

Включаемые во множественную регрессию факторы должны объяснить вариацию независимой переменной. Если строится модель с набором

При дополнительном включении в регрессию

Если же этого не происходит и данные показатели практически не отличаются друг от друга, то включаемый в анализ фактор

Насыщение модели лишними факторами не только не снижает величину остаточной дисперсии и не увеличивает показатель детерминации, но и приводит к статистической незначимости параметров регрессии по критерию Стьюдента.

Таким образом, хотя теоретически регрессионная модель позволяет учесть любое число факторов, практически в этом нет необходимости. Отбор факторов производится на основе качественного теоретико-экономического анализа. Однако теоретический анализ часто не позволяет однозначно ответить на вопрос о количественной взаимосвязи рассматриваемых признаков и целесообразности включения фактора в модель. Поэтому отбор факторов обычно осуществляется в две стадии: на первой подбираются факторы исходя из сущности проблемы; на второй – на основе матрицы показателей корреляции определяют статистики для параметров регрессии.

Коэффициенты интеркорреляции (т.е. корреляции между объясняющими переменными) позволяют исключать из модели дублирующие факторы. Считается, что две переменные явно коллинеарны, т.е. находятся между собой в линейной зависимости, если

Пусть, например, при изучении зависимости

Таблица 2.1

|  |  |  |

| 0,8 | 0,7 | 0,6 |

| 0,8 | 0,8 | 0,5 |

| 0,7 | 0,8 | 0,2 |

| 0,6 | 0,5 | 0,2 |

Очевидно, что факторы

По величине парных коэффициентов корреляции обнаруживается лишь явная коллинеарность факторов. Наибольшие трудности в использовании аппарата множественной регрессии возникают при наличии мультиколлинеарности факторов, когда более чем два фактора связаны между собой линейной зависимостью, т.е. имеет место совокупное воздействие факторов друг на друга. Наличие мультиколлинеарности факторов может означать, что некоторые факторы будут всегда действовать в унисон. В результате вариация в исходных данных перестает быть полностью независимой и нельзя оценить воздействие каждого фактора в отдельности.

Включение в модель мультиколлинеарных факторов нежелательно в силу следующих последствий:

1. Затрудняется интерпретация параметров множественной регрессии как характеристик действия факторов в «чистом» виде, ибо факторы коррелированы; параметры линейной регрессии теряют экономический смысл.

2. Оценки параметров ненадежны, обнаруживают большие стандартные ошибки и меняются с изменением объема наблюдений (не только по величине, но и по знаку), что делает модель непригодной для анализа и прогнозирования.

Для оценки мультиколлинеарности факторов может использоваться определитель матрицы парных коэффициентов корреляции между факторами.

Если бы факторы не коррелировали между собой, то матрица парных коэффициентов корреляции между факторами была бы единичной матрицей, поскольку все недиагональные элементы

матрица коэффициентов корреляции между факторами имела бы определитель, равный единице:

Если же, наоборот, между факторами существует полная линейная зависимость и все коэффициенты корреляции равны единице, то определитель такой матрицы равен нулю:

Чем ближе к нулю определитель матрицы межфакторной корреляции, тем сильнее мультиколлинеарность факторов и ненадежнее результаты множественной регрессии. И, наоборот, чем ближе к единице определитель матрицы межфакторной корреляции, тем меньше мультиколлинеарность факторов.

Существует ряд подходов преодоления сильной межфакторной корреляции. Самый простой путь устранения мультиколлинеарности состоит в исключении из модели одного или нескольких факторов. Другой подход связан с преобразованием факторов, при котором уменьшается корреляция между ними.

Одним из путей учета внутренней корреляции факторов является переход к совмещенным уравнениям регрессии, т.е. к уравнениям, которые отражают не только влияние факторов, но и их взаимодействие. Так, если

Рассматриваемое уравнение включает взаимодействие первого порядка (взаимодействие двух факторов). Возможно включение в модель и взаимодействий более высокого порядка, если будет доказана их статистическая значимость по

Отбор факторов, включаемых в регрессию, является одним из важнейших этапов практического использования методов регрессии. Подходы к отбору факторов на основе показателей корреляции могут быть разные. Они приводят построение уравнения множественной регрессии соответственно к разным методикам. В зависимости от того, какая методика построения уравнения регрессии принята, меняется алгоритм ее решения на ЭВМ.

Наиболее широкое применение получили следующие методы построения уравнения множественной регрессии:

1. Метод исключения – отсев факторов из полного его набора.

2. Метод включения – дополнительное введение фактора.

3. Шаговый регрессионный анализ – исключение ранее введенного фактора.

При отборе факторов также рекомендуется пользоваться следующим правилом: число включаемых факторов обычно в 6–7 раз меньше объема совокупности, по которой строится регрессия. Если это соотношение нарушено, то число степеней свободы остаточной дисперсии очень мало. Это приводит к тому, что параметры уравнения регрессии оказываются статистически незначимыми, а

2.2. Метод наименьших квадратов (МНК).

Свойства оценок на основе МНК

Возможны разные виды уравнений множественной регрессии: линейные и нелинейные.

Ввиду четкой интерпретации параметров наиболее широко используется линейная функция. В линейной множественной регрессии

Рассмотрим линейную модель множественной регрессии

Классический подход к оцениванию параметров линейной модели множественной регрессии основан на методе наименьших квадратов (МНК). МНК позволяет получить такие оценки параметров, при которых сумма квадратов отклонений фактических значений результативного признака

Как известно из курса математического анализа, для того чтобы найти экстремум функции нескольких переменных, надо вычислить частные производные первого порядка по каждому из параметров и приравнять их к нулю.

Итак. Имеем функцию

Находим частные производные первого порядка:

После элементарных преобразований приходим к системе линейных нормальных уравнений для нахождения параметров линейного уравнения множественной регрессии (2.1):

Для двухфакторной модели данная система будет иметь вид:

Метод наименьших квадратов применим и к уравнению множественной регрессии в стандартизированном масштабе:

где

Стандартизованные коэффициенты регрессии показывают, на сколько единиц изменится в среднем результат, если соответствующий фактор

Применяя МНК к уравнению множественной регрессии в стандартизированном масштабе, получим систему нормальных уравнений вида

где

Коэффициенты «чистой» регрессии

Поэтому можно переходить от уравнения регрессии в стандартизованном масштабе (2.4) к уравнению регрессии в натуральном масштабе переменных (2.1), при этом параметр

Рассмотренный смысл стандартизованных коэффициентов регрессии позволяет их использовать при отсеве факторов – из модели исключаются факторы с наименьшим значением

На основе линейного уравнения множественной регрессии

могут быть найдены частные уравнения регрессии:

т.е. уравнения регрессии, которые связывают результативный признак с соответствующим фактором

При подстановке в эти уравнения средних значений соответствующих факторов они принимают вид парных уравнений линейной регрессии, т.е. имеем

В отличие от парной регрессии частные уравнения регрессии характеризуют изолированное влияние фактора на результат, ибо другие факторы закреплены на неизменном уровне. Эффекты влияния других факторов присоединены в них к свободному члену уравнения множественной регрессии. Это позволяет на основе частных уравнений регрессии определять частные коэффициенты эластичности:

где

Наряду с частными коэффициентами эластичности могут быть найдены средние по совокупности показатели эластичности:

которые показывают на сколько процентов в среднем изменится результат, при изменении соответствующего фактора на 1%. Средние показатели эластичности можно сравнивать друг с другом и соответственно ранжировать факторы по силе их воздействия на результат.

Рассмотрим пример[4] (для сокращения объема вычислений ограничимся только десятью наблюдениями). Пусть имеются следующие данные (условные) о сменной добыче угля на одного рабочего

Таблица 2.2

| № |

|

|

|

Предполагая, что между переменными

Для удобства дальнейших вычислений составляем таблицу (

Таблица 2.3

| № |  |  |  |  |  |  |  |  |  |  |  |

| 5,13 | 0,016 | ||||||||||

| 8,79 | 1,464 | ||||||||||

| 9,64 | 0,127 | ||||||||||

| 5,98 | 1,038 | ||||||||||

| 5,86 | 0,741 | ||||||||||

| 6,23 | 0,052 | ||||||||||

| 6,35 | 0,121 | ||||||||||

| 5,61 | 0,377 | ||||||||||

| 5,13 | 0,762 | ||||||||||

| 9,28 | 1,631 | ||||||||||

| Сумма | 6,329 | ||||||||||

| Среднее значение | 9,4 | 6,3 | 6,8 | 90,8 | 41,7 | 49,6 | 60,3 | 66,4 | 44,5 | – | – |

| 2,44 | 2,01 | 3,36 | – | – | – | – | – | – | – | – |

| 1,56 | 1,42 | 1,83 | – | – | – | – | – | – | – | – |

Для нахождения параметров уравнения регрессии в данном случае необходимо решить следующую систему нормальных уравнений:

Откуда получаем, что

Оно показывает, что при увеличении только мощности пласта

Найдем уравнение множественной регрессии в стандартизованном масштабе:

при этом стандартизованные коэффициенты регрессии будут

Т.е. уравнение будет выглядеть следующим образом:

Так как стандартизованные коэффициенты регрессии можно сравнивать между собой, то можно сказать, что мощность пласта оказывает большее влияние на сменную добычу угля, чем уровень механизации работ.

Сравнивать влияние факторов на результат можно также при помощи средних коэффициентов эластичности (2.11):

Т.е. увеличение только мощности пласта (от своего среднего значения) или только уровня механизации работ на 1% увеличивает в среднем сменную добычу угля на 1,18% или 0,34% соответственно. Таким образом, подтверждается большее влияние на результат

2.3. Проверка существенности факторов

Проблема выбора факторов для множественной регрессии

Тема № 3. Множественная корреляция и регрессия.

Проблема выбора факторов для множественной регрессии

2. Способы линеаризации связей фактора с результативным признаком

3. Уравнение многофакторной регрессии, его построение и интерпретация

Стандартизированные коэффициенты регрессии и коэффициенты эластичности и их интерпретация

Система показателей тесноты многофакторной связи

Методы оценки степени надежности многофакторной регрессии

Корреляционно-регрессивные модели и их применение в анализе и прогнозе социально-экономических явлений.

Измерение связи неколичественных признаков. Фиктивные переменные

Предпосылки метода наименьших квадратов при нахождении параметров уравнения множественной регрессии

Проблема выбора факторов для множественной регрессии

В реальной жизни, социальных и экономических системах на результативный признак всегда влияет множество факторных признаков. Кроме того, ввиду математических свойств МНК в уравнение регрессии нельзя включать число факторов ≥ (n — 1), где n число наблюдений. А для надлежащих оценок параметров число фактов должно быть в 5 – 6 раз меньше числа наблюдений. Т.к. между самими факторами существует связь, то парная корреляция и регрессия измеряют не чистое влияние каждого фактора, но и часть влияния других факторов, не включенных в модель, но связанных с данными.

Парная регрессия может дать хороший результат, если влиянием других факторов, не включенных в модель, можно пренебречь. Однако исследователь никогда не может быть уверен в справедливости данного предположения. Поэтому, как правило, в эконометрических исследованиях для более полной и точной оценки применяется модель множественной регрессии

Множественная регрессия используется для решения проблем спроса, доходности акций при изучении функций издержек. Основная цель множественной регрессии – построить модель с большим числом факторов, определив при этом влияние каждого из них в отдельности, а также их совокупное влияние на моделируемый показатель. Построение модели начинают с решения вопроса о спецификации модели. Во множественной регрессии спецификация модели включает в себя решение двух вопросов:

1. отбор факторов

2. выбор вида уравнения.

Включение в уравнение множественной регрессии того или иного набора факторов связано, прежде всего, с представлением исследователя о природе взаимосвязи моделируемого показателя с другими жизненными явлениями.

Факторы включенные в модель должны отвечать следующим требованиям:

1. должны быть количественно измеримы; если необходимо включать качественный фактор, то ему необходимо придать количественное определение.

2. не должны быть интеркоррелированны (т.е. факторные признаки не должны находится в тесной зависимости между собой) и находится в точной функциональной связи. При включении в модель факторов с высокой интеркорреляцией (

Факторы множественной регрессии должны объяснять вариацию зависимой переменной. Если строится модель с набором факторов P, то для нее рассчитывается показатель множественной детерминации R 2 , который фиксирует долю объяснений вариации результативного признака за счет рассмотрения в регрессии P — факторов. Влияние неучтенных факторов оценивается как 1 – R 2 с соответствующей остаточной дисперсией.

При дополнительном включении в регрессию (P+1) – го фактора R 2 должен возрастать, Docm уменьшаться. Если этого не происходит и данные показатели мало отличаются друг от друга, то включенный в анализ (P+1) – фактор не улучшает модель и является практически лишним фактором.

Пример. Допустим, для множественной регрессии, включающей 5 факторов, R 2 = 0,85, а при включении 6-го фактора ® R 2 = 0,786. Значит включение 6-го фактора нецелесообразно.

Насыщение модели лишними факторами не только не снижает величину остаточной дисперсии, но и приводит к статической незначимости параметров регрессии по t – критерию Стьюдента. Таким образом, хотя теоретически регрессионная модель позволяет учесть любое число факторов, но практически – в этом нет необходимости.

Отбор факторов производится на основе качественного теоретико-жизненного анализа и проходит в 2 стадии:

1. подбираются факторы, исходя из сущности проблемы,

2. на основе матрицы показателей корреляции определяют t–статистики для параметров регрессии. Коэффициенты интеркорреляции (т.е. корреляции между факторными признаками) позволяют исключить из модели факторы, дублирующие друг друга.

Считается, что 2 переменные являются коллинеарными, т.е. находятся между собой в линейной зависимости, если коэффициент

Поскольку одним из условий построения уравнения множественной регрессии является независимость действия факторов (в идеале коэффициент

Если факторы явно коллинеарны, то они дублируют друг друга и один из них необходимо исключить из модели.

Правило: предпочтение отдается не фактору, который более тесно связан с результатом, а тому фактору, который при достаточной связи с результатом имеет номинальную тесноту связи с другими факторами.

Пример. Изучается зависимость между

Построим матрицу парных коэффициентов корреляции

| y | x | z | V |

| y | |||

| x | 0,9 | ||

| z | 0,8 | 0,9 | |

| v | 0,7 | 0,6 | 0,3 |

Факторы X и Z явно коллинеарны, т.е. дублируют друг друга

В модели оставляем фактор Z, т.к. несмотря на то, что коэффициенты парной корреляции

По величине парных коэффициентов корреляции обнаруживается лишь явная коллинеарность факторов. Наибольшие трудности в использовании множественной регрессии возникают при наличии мультиколлинеарности факторов, когда более чем 2 фактора связаны между собой линейной зависимостью, т.е. наблюдается совокупность воздействия факторов друг на друга. Наличие мультиколлинеарности факторов может означать, что некоторые факторы будут всегда действовать в унисон. В результате вариация в исходных данных перестает быть полностью независимой и нельзя оценивать влияние каждого фактора в отдельности. Чем сильнее мультиколлинеарность факторов, тем менее надежна оценка параметров с помощью МНК.

Включение в модель мультиколлинеарных факторов нежелательно в силу следующих последствий:

1. затрудняется интерпретация параметров множественной регрессии как характеристик действия факторов «в чистом» виде, т.к. факторы интерколлинеарны. Параметры линейной регрессии теряют жизненный смысл.

2. оценки параметров ненадежны, обнаруживаются большие стандартные ошибки и меняют с изменением объема наблюдений не только по величине, но и по знаку, что делает модель непригодной для анализа и прогноза.

2. Способы линеаризации связей фактора с результативным признаком

Для оценки параметров нелинейных уравнений используют 2 подхода:

1. основан на линеаризации модели и заключается в том, что с помощью подходящих преобразований исходных переменный исследуемую зависимость представляют в виде линейного соотношения между преобразованными переменными.

2. обычно применяют в случае, когда подобрать соответствующее линеаризационное преобразование невозможно. В этом случае применяют методы нелинейной оптимизации на основе исходных переменных.

По аналогии с парной корреляцией.

3. Уравнение многофакторной регрессии, его построение и интерпретация

Как и в парной зависимости возможны различные виды множественной регрессии: линейные и нелинейные. В виду четной интерпретации параметров наиболее широко используются линейная и степенные функции.

В уравнении множественной регрессии:

Коэффициенты при х называются коэффициентами «чистой» регрессии. Они показывают среднее изменение результата с изменением соответствующего фактора на единицу при неизменном значении других факторов, закрепленных на среднем уровне.

Параметр а не подлежит экономической интерпретации.

Параметры уравнения множественной регрессии оцениваются как в парной регрессии МНК, при котором строится система нормальных уравнений, решение которой позволяет получить оценки параметров регрессии.

Т. о. для уравнения

Система нормальных уравнений будет иметь следующий вид:

Ее решение может быть осуществлено методом определителей

Где Δа, Δb – частные определители системы, при этом

Δа, Δb, … , Δbр получаются путем замены соответствующего столбца матрицы общего определителя данной системы данными левой части системы.

у – отношение прибыли ко всем активам банка, %

х1 – Доля ГКО в активах, %

х2 – отношение непроцентных доходов к процентным доходам деятельности банка, %

х3 – коэффициент полной ликвидности банка

Построить множественную модель

Таблица 1. Исходные данные и расчетные величины для анализа.

| № банк | у,% | х1,% | х2,% | х3,% |  |  |  |

| 13,5 | 24,0 | 2,5 | 1,27 | 8,1 | 5,4 | 29,16 | |

| 25,5 | 51,0 | 4,5 | 1,97 | 20,1 | 5,4 | 29,16 | |

| 1,2 | 10,4 | 2,5 | 2,15 | 7,8 | -6,6 | 43,56 | |

| 1,3 | 14,1 | 1,6 | 1,27 | 4,8 | -3,5 | 12,25 | |

| 4,5 | 4,7 | 0,3 | 1,34 | 1,9 | 2,6 | 6,76 | |

| 2,7 | 15,8 | 0,5 | 0,97 | 3,8 | -1,1 | 1,21 | |

| 12,2 | 29,2 | 0,5 | 1,15 | 9,4 | 2,8 | 7,84 | |

| 4,2 | 31,0 | 6,6 | 1,07 | 10,1 | -5,9 | 34,81 | |

| 4,4 | 13,5 | 1,0 | 1,08 | 3,7 | 0,7 | 0,49 | |

| 2,8 | 2,2 | 0,6 | 1,36 | 1,3 | 0,8 | 0,64 | |

| 7,5 | 50,3 | 2,1 | 1,11 | 15,7 | -8,2 | 67,24 | |

| 14,4 | 28,3 | 7,2 | 1,18 | 9,7 | 4,7 | 22,09 | |

| 11,4 | 30,4 | 1,2 | 1,10 | 9,2 | 2,2 | 4,84 | |

| S | 10,49 | 304,9 | 31,1 | 1,7,02 | 105,6 | х | 260,05 |

| ср | 8,1 | 23,5 | 2,39 | 1,31 |

1. Рассчитать по всем показателям среднее значение ( и V. Результат занесем в таблицу 2.

Таблица 2. Характеристики ряда распределения

| Факторы | Среднее значение | Среднее квадратное отклонение | Коэффициент вариации |

| х1 | 23,5 | 14,83 | 0,632 |

| х2 | 2,39 | 2,22 | 0,929 |

| х3 | 1,31 | 0,34 | 0,261 |

| у | 8,1 | 6,80 | 0,843 |

Получим, что х1, х2, и у совокупность неоднородно, следовательно, должны исключить аномальные наблюдения

Не исключаем, т.к. важна методика .

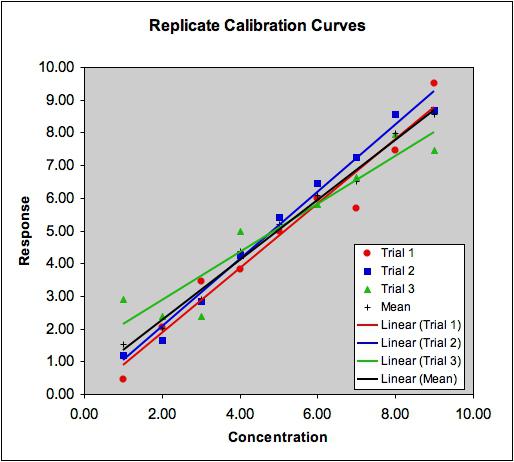

2. Рассчитаем уравнение парной регрессии между результатом и каждым из факторных признаков.

Установим коэффициенты парной корреляции и детерминации (они характеризуют изолированное влияние каждого фактора на результат, т.к. другие факторы применяются на неизменном уровне).

Парные уравнения регрессии

Уравнение регрессии позволяет сделать вывод, что с увеличением доли ГКО в активах на 1% пункт, доля прибыли по всем активам увеличивается в среднем на 0,329 % пунктов.

ryx1 = 0,718 – связь прямая и достаточно сильная

r 2 yx1 = 0,516 – при условии др. не считается

2)

с увеличением отношения непроцентных доходов к процентным доходам на 1% пунктов, доля прибыли по всем активам увеличивается в среднем на 1,215%

3)

ryx3 = 0,241 – связь непрямая и слабая

С увеличением коэффициента полной ликвидности банка на 1 % доля прибыли по всем активам увеличивается в среднем на 4,788%

Вариация х3 объясняет вариацию у на 5,8 %

3. Построим матрицу парных коэффициентов вариации для выявления явно коллинеарных факторов.

Таблица 3. Матрица парных коэффициентов корреляции.

| Признаки | у | х1 | х2 | х3 |

| у | ||||

| х1 | 0,718 | |||

| х2 | 0,516 | 0,462 | ||

| х3 | 0,241 | 0,0053 | 0,134 |

Явно коллинеарных факторов нет, т.к. коэффициенты парной корреляции между факторными признаками не превышают 0,7.

Способы определения коэффициентов условно чистой регрессии.

Для определения данных коэффициентов рассчитаем определители

i – номер наблюдения,

j – номер фактора.

Результаты занесем в вспомогательную таблицу.

Таблица 4. Расчет многофакторной регрессии.

| № банк | Dх1 | Dх2 | Dх3 | Dу | D 2 х1 | D 2 х2 | D 2 х3 | D 2 у | DуDх1 | DуDх2 | DуDх3 | Dх1Dх2 | Dх1Dх3 | Dх2Dх3 |

| 0,5 | -0,04 | |||||||||||||

| 27,5 | 0,66 | |||||||||||||

| -13,1 | 0,84 | |||||||||||||

| -9,4 | -0,04 | |||||||||||||

| -18,1 | 0,03 | |||||||||||||

| -7,7 | -0,34 | |||||||||||||

| 5,7 | -0,16 | |||||||||||||

| 7,5 | -0,24 | |||||||||||||

| -10,0 | -0,23 | |||||||||||||

| -21,3 | 0,05 | |||||||||||||

| -26,9 | -0,20 | |||||||||||||

| 4,8 | -0,13 | |||||||||||||

| 6,9 | -0,23 | |||||||||||||

| å | — | 64,11 | 1,52 | 77,92 | 7,277 | 197,82 | 0,55 | 1,320 |

Для определения коэффициентов условно чистой регрессии рассчитаем систему нормальных уравнений

Из вспомогательной таблицы № 4 подставляем необходимые данные

Уравнение многофакторной регрессии примет вид

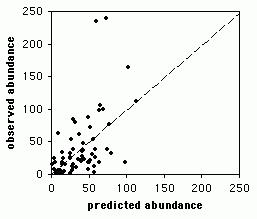

Подставляя в данное уравнение значение факторов х1, х2, х3 получим теоретическое значение результативного признака.

Т.о. в отличии от коэффициентов парной регрессии, коэффициенты условно чистой регрессии измеряют влияние фактора, абстрагируясь от связей вариации этого фактора с вариациями другого фактора, включенных в модель.

Коэффициенты условно чистой регрессии, т.е. bj являются именованными числами, выраженными в различных единицах измерения, в тех же единицах, что и соответствующие им факторы. Поэтому они не сравнимы друг с другом, т.е. по их величине нельзя сделать вывод, какой из факторов в наибольшей степени влияет на результат. Для приведения их в сравнимый вид применяется то же преобразование, что и для получения парных коэффициентов. Полученную величину называют стандартизированным коэффициентом регрессии.

Уравнение регрессии. Уравнение множественной регрессии

Во время учебы студенты очень часто сталкиваются с разнообразными уравнениями. Одно из них – уравнение регрессии — рассмотрено в данной статье. Такой тип уравнения применяется специально для описания характеристики связи между математическими параметрами. Данный вид равенств используют в статистике и эконометрике.

Определение понятия регрессии

В математике под регрессией подразумевается некая величина, описывающая зависимость среднего значения совокупности данных от значений другой величины. Уравнение регрессии показывает в качестве функции определенного признака среднее значение другого признака. Функция регрессии имеет вид простого уравнения у = х, в котором у выступает зависимой переменной, а х – независимой (признак-фактор). Фактически регрессия выражаться как у = f (x).

Какие бывают типы связей между переменными

В общем, выделяется два противоположных типа взаимосвязи: корреляционная и регрессионная.

Первая характеризуется равноправностью условных переменных. В данном случае достоверно не известно, какая переменная зависит от другой.

Если же между переменными не наблюдается равноправности и в условиях сказано, какая переменная объясняющая, а какая – зависимая, то можно говорить о наличии связи второго типа. Для того чтобы построить уравнение линейной регрессии, необходимо будет выяснить, какой тип связи наблюдается.

Виды регрессий

На сегодняшний день выделяют 7 разнообразных видов регрессии: гиперболическая, линейная, множественная, нелинейная, парная, обратная, логарифмически линейная.

Гиперболическая, линейная и логарифмическая

Уравнение линейной регрессии применяют в статистике для четкого объяснения параметров уравнения. Оно выглядит как у = с+т*х+Е. Гиперболическое уравнение имеет вид правильной гиперболы у = с + т / х + Е. Логарифмически линейное уравнение выражает взаимосвязь с помощью логарифмической функции: In у = In с + т* In x + In E.

Множественная и нелинейная

Два более сложных вида регрессии – это множественная и нелинейная. Уравнение множественной регрессии выражается функцией у = f(х1 , х2 . хс)+E. В данной ситуации у выступает зависимой переменной, а х – объясняющей. Переменная Е — стохастическая, она включает влияние других факторов в уравнении. Нелинейное уравнение регрессии немного противоречиво. С одной стороны, относительно учтенных показателей оно не линейное, а с другой стороны, в роли оценки показателей оно линейное.

Обратные и парные виды регрессий

Обратная – это такой вид функции, который необходимо преобразовать в линейный вид. В самых традиционных прикладных программах она имеет вид функции у = 1/с + т*х+Е. Парное уравнение регрессии демонстрирует взаимосвязь между данными в качестве функции у = f (x) + Е. Точно так же, как и в других уравнениях, у зависит от х, а Е — стохастический параметр.

Понятие корреляции

Это показатель, демонстрирующий существование взаимосвязи двух явлений или процессов. Сила взаимосвязи выражается в качестве коэффициента корреляции. Его значение колеблется в рамках интервала [-1;+1]. Отрицательный показатель говорит о наличии обратной связи, положительный – о прямой. Если коэффициент принимает значение, равное 0, то взаимосвязи нет. Чем ближе значение к 1 – тем сильнее связь между параметрами, чем ближе к 0 – тем слабее.

Методы

Корреляционные параметрические методы могут оценить тесноту взаимосвязи. Их используют на базе оценки распределения для изучения параметров, подчиняющихся закону нормального распределения.

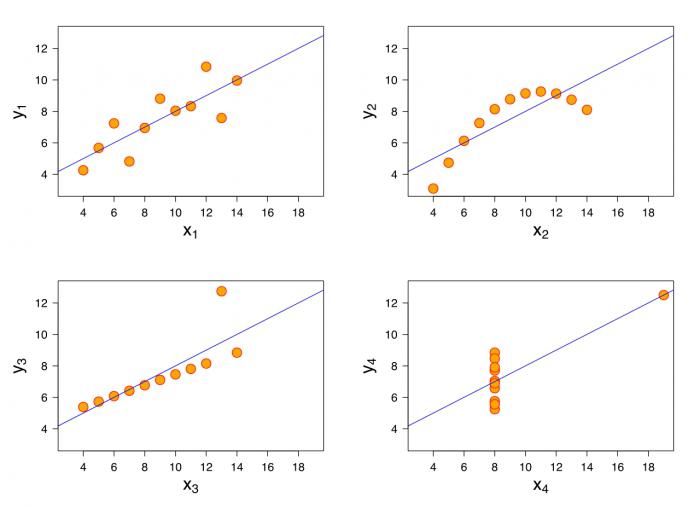

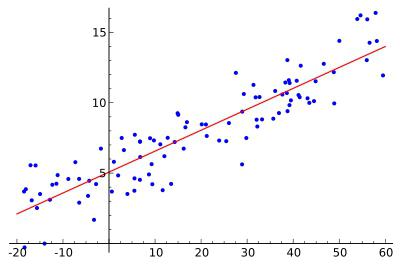

Параметры уравнения линейной регрессии необходимы для идентификации вида зависимости, функции регрессионного уравнения и оценивания показателей избранной формулы взаимосвязи. В качестве метода идентификации связи используется поле корреляции. Для этого все существующие данные необходимо изобразить графически. В прямоугольной двухмерной системе координат необходимо нанести все известные данные. Так образуется поле корреляции. Значение описывающего фактора отмечаются вдоль оси абсцисс, в то время как значения зависимого – вдоль оси ординат. Если между параметрами есть функциональная зависимость, они выстраиваются в форме линии.

В случае если коэффициент корреляции таких данных будет менее 30 %, можно говорить о практически полном отсутствии связи. Если он находится между 30 % и 70 %, то это говорит о наличии связей средней тесноты. 100 % показатель – свидетельство функциональной связи.

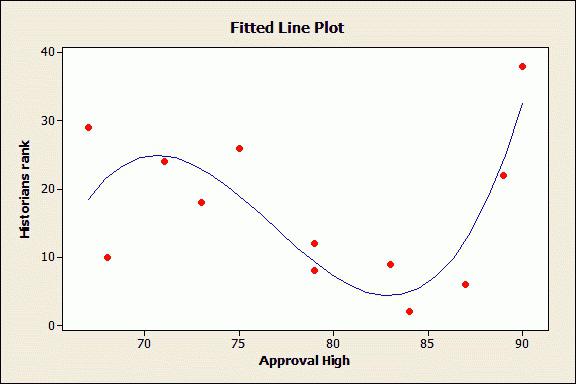

Нелинейное уравнение регрессии так же, как и линейное, необходимо дополнять индексом корреляции (R).

Корреляция для множественной регрессии

Коэффициент детерминации является показателем квадрата множественной корреляции. Он говорит о тесноте взаимосвязи представленного комплекса показателей с исследуемым признаком. Он также может говорить о характере влияния параметров на результат. Уравнение множественной регрессии оценивают с помощью этого показателя.

Для того чтобы вычислить показатель множественной корреляции, необходимо рассчитать его индекс.

Метод наименьших квадратов

Данный метод является способом оценивания факторов регрессии. Его суть заключается в минимизировании суммы отклонений в квадрате, полученных вследствие зависимости фактора от функции.

Парное линейное уравнение регрессии можно оценить с помощью такого метода. Этот тип уравнений используют в случае обнаружения между показателями парной линейной зависимости.

Параметры уравнений

Каждый параметр функции линейной регрессии несет определенный смысл. Парное линейное уравнение регрессии содержит два параметра: с и т. Параметр т демонстрирует среднее изменение конечного показателя функции у, при условии уменьшения (увеличения) переменной х на одну условную единицу. Если переменная х – нулевая, то функция равняется параметру с. Если же переменная х не нулевая, то фактор с не несет в себе экономический смысл. Единственное влияние на функцию оказывает знак перед фактором с. Если там минус, то можно сказать о замедленном изменении результата по сравнению с фактором. Если там плюс, то это свидетельствует об ускоренном изменении результата.

Каждый параметр, изменяющий значение уравнения регрессии, можно выразить через уравнение. Например, фактор с имеет вид с = y – тх.

Сгруппированные данные

Бывают такие условия задачи, в которых вся информация группируется по признаку x, но при этом для определенной группы указываются соответствующие средние значения зависимого показателя. В таком случае средние значения характеризуют, каким образом изменяется показатель, зависящий от х. Таким образом, сгруппированная информация помогает найти уравнение регрессии. Ее используют в качестве анализа взаимосвязей. Однако у такого метода есть свои недостатки. К сожалению, средние показатели достаточно часто подвергаются внешним колебаниям. Данные колебания не являются отображением закономерности взаимосвязи, они всего лишь маскируют ее «шум». Средние показатели демонстрируют закономерности взаимосвязи намного хуже, чем уравнение линейной регрессии. Однако их можно применять в виде базы для поиска уравнения. Перемножая численность отдельной совокупности на соответствующую среднюю можно получить сумму у в пределах группы. Далее необходимо подбить все полученные суммы и найти конечный показатель у. Чуть сложнее производить расчеты с показателем суммы ху. В том случае если интервалы малы, можно условно взять показатель х для всех единиц (в пределах группы) одинаковым. Следует перемножить его с суммой у, чтобы узнать сумму произведений x на у. Далее все суммы подбиваются вместе и получается общая сумма ху.

Множественное парное уравнение регрессии: оценка важности связи

Как рассматривалось ранее, множественная регрессия имеет функцию вида у = f (x1,x2,…,xm)+E. Чаще всего такое уравнение используют для решения проблемы спроса и предложения на товар, процентного дохода по выкупленным акциям, изучения причин и вида функции издержек производства. Ее также активно применяют в самых разнообразным макроэкономических исследованиях и расчетах, а вот на уровне микроэкономики такое уравнение применяют немного реже.

Основной задачей множественной регрессии является построение модели данных, содержащих огромное количество информации, для того чтобы в дальнейшем определить, какое влияние имеет каждый из факторов по отдельности и в их общей совокупности на показатель, который необходимо смоделировать, и его коэффициенты. Уравнение регрессии может принимать самые разнообразные значения. При этом для оценки взаимосвязи обычно используется два типа функций: линейная и нелинейная.

Линейная функция изображается в форме такой взаимосвязи: у = а0 + a1х1 + а2х2,+ . + amxm. При этом а2, am, считаются коэффициентами «чистой» регрессии. Они необходимы для характеристики среднего изменения параметра у с изменением (уменьшением или увеличением) каждого соответствующего параметра х на одну единицу, с условием стабильного значения других показателей.

Нелинейные уравнения имеют, к примеру, вид степенной функции у=ах1 b1 х2 b2 . xm bm . В данном случае показатели b1, b2. bm – называются коэффициентами эластичности, они демонстрируют, каким образом изменится результат (на сколько %) при увеличении (уменьшении) соответствующего показателя х на 1 % и при стабильном показателе остальных факторов.

Какие факторы необходимо учитывать при построении множественной регрессии

Для того чтобы правильно построить множественную регрессию, необходимо выяснить, на какие именно факторы следует обратить особое внимание.

Необходимо иметь определенное понимание природы взаимосвязей между экономическими факторами и моделируемым. Факторы, которые необходимо будет включать, обязаны отвечать следующим признакам:

- Должны быть подвластны количественному измерению. Для того чтобы использовать фактор, описывающий качество предмета, в любом случае следует придать ему количественную форму.

- Не должна присутствовать интеркорреляция факторов, или функциональная взаимосвязь. Такие действия чаще всего приводят к необратимым последствиям – система обыкновенных уравнений становится не обусловленной, а это влечет за собой ее ненадежность и нечеткость оценок.

- В случае существования огромного показателя корреляции не существует способа для выяснения изолированного влияния факторов на окончательный результат показателя, следовательно, коэффициенты становятся неинтерпретируемыми.

Методы построения

Существует огромное количество методов и способов, объясняющих, каким образом можно выбрать факторы для уравнения. Однако все эти методы строятся на отборе коэффициентов с помощью показателя корреляции. Среди них выделяют:

- Способ исключения.

- Способ включения.

- Пошаговый анализ регрессии.

Первый метод подразумевает отсев всех коэффициентов из совокупного набора. Второй метод включает введение множества дополнительных факторов. Ну а третий – отсев факторов, которые были ранее применены для уравнения. Каждый из этих методов имеет право на существование. У них есть свои плюсы и минусы, но они все по-своему могут решить вопрос отсева ненужных показателей. Как правило, результаты, полученные каждым отдельным методом, достаточно близки.

Методы многомерного анализа

Такие способы определения факторов базируются на рассмотрении отдельных сочетаний взаимосвязанных признаков. Они включают в себя дискриминантный анализ, распознание обликов, способ главных компонент и анализ кластеров. Кроме того, существует также факторный анализ, однако он появился вследствие развития способа компонент. Все они применяются в определенных обстоятельствах, при наличии определенных условий и факторов.

http://megaobuchalka.ru/7/5029.html

http://www.syl.ru/article/178055/new_uravnenie-regressii-uravnenie-mnojestvennoy-regressii